Akt o umelej inteligencii je vôbec prvým právnym rámcom pre umelú inteligenciu, ktorý rieši riziká umelej inteligencie a stavia Európu do vedúcej úlohy na celom svete.

Akt o umelej inteligencii [nariadenie (EÚ) 2024/1689, ktorým sa stanovujú harmonizované pravidlá v oblasti umelej inteligencie] je vôbec prvým komplexným právnym rámcom pre umelú inteligenciu na celom svete. Cieľom pravidiel je podporiť dôveryhodnú umelú inteligenciu v Európe. Všetky otázky týkajúce sa aktu o umelej inteligencii nájdete na jednotnej informačnej platforme aktu o umelej inteligencii.

V akte o umelej inteligencii sa stanovujú pravidlá založené na riziku pre vývojárov a nasadzujúce subjekty umelej inteligencie, pokiaľ ide o konkrétne použitia umelej inteligencie. Akt o umelej inteligencii je súčasťou širšieho balíka politických opatrení na podporu rozvoja dôveryhodnej umelej inteligencie, ktorý zahŕňa aj akčný plán pre kontinentálnu umelú inteligenciu, inovačný balík v oblasti umelej inteligencie a spustenie tovární umelej inteligencie. Tieto opatrenia spoločne zaručujú bezpečnosť, základné práva a umelú inteligenciu zameranú na človeka a posilňujú zavádzanie, investície a inovácie v oblasti umelej inteligencie v celej EÚ.

S cieľom uľahčiť prechod na nový regulačný rámec Komisia spustila pakt o umelej inteligencii, dobrovoľnú iniciatívu, ktorej cieľom je podporiť budúce vykonávanie, spolupracovať so zainteresovanými stranami a vyzvať poskytovateľov umelej inteligencie a nasadzujúce subjekty z Európy aj mimo nej, aby včas splnili kľúčové povinnosti aktu o umelej inteligencii. Informačné stredisko pre akt o umelej inteligencii zároveň poskytuje informácie a podporu pre bezproblémové a účinné vykonávanie aktu o umelej inteligencii v celej EÚ.

Prečo potrebujeme pravidlá pre umelú inteligenciu?

Aktom o umelej inteligencii sa zabezpečuje, aby Európania mohli dôverovať tomu, čo umelá inteligencia ponúka. Hoci väčšina systémov umelej inteligencie nepredstavuje žiadne riziko a môže prispieť k riešeniu mnohých spoločenských výziev, niektoré systémy umelej inteligencie vytvárajú riziká, ktoré musíme riešiť, aby sme sa vyhli nežiaducim výsledkom.

Často napríklad nie je možné zistiť, prečo systém umelej inteligencie prijal rozhodnutie alebo predpoveď a prijal konkrétne opatrenie. Preto môže byť ťažké posúdiť, či bol niekto nespravodlivo znevýhodnený, napríklad v rozhodnutí o prijatí do zamestnania alebo v žiadosti o systém verejných dávok.

Hoci existujúce právne predpisy poskytujú určitú ochranu, nepostačujú na riešenie osobitných výziev, ktoré môžu systémy umelej inteligencie priniesť.

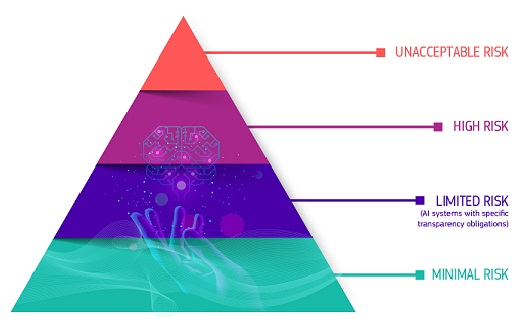

Prístup založený na riziku

V akte o umelej inteligencii sa vymedzujú štyri úrovne rizika pre systémy umelej inteligencie:

Neprijateľné riziko

Všetky systémy umelej inteligencie, ktoré sa považujú za jasnú hrozbu pre bezpečnosť, živobytie a práva ľudí, sú zakázané. V akte o umelej inteligencii sa zakazuje osem praktík, konkrétne:

- škodlivá manipulácia a klamanie založené na umelej inteligencii

- škodlivé využívanie zraniteľností založené na umelej inteligencii

- sociálne bodovanie

- Posúdenie alebo predpoveď rizika individuálneho trestného činu

- necielené škrabanie internetového materiálu alebo materiálu CCTV na vytvorenie alebo rozšírenie databáz rozpoznávania tváre

- rozpoznávanie emócií na pracoviskách a vo vzdelávacích inštitúciách

- biometrická kategorizácia na odvodenie určitých chránených charakteristík

- diaľková biometrická identifikácia v reálnom čase na účely presadzovania práva vo verejne prístupných priestoroch

Zákazy nadobudli účinnosť vo februári 2025. Komisia uverejnila dva kľúčové dokumenty na podporu praktického uplatňovania zakázaných praktík:

- Usmernenia o zakázaných praktikách umelej inteligencie podľa aktu o umelej inteligencii, ktoré ponúkajú právne vysvetlenia a praktické príklady s cieľom pomôcť zainteresovaným stranám pochopiť zákazy a dodržiavať ich.

- Usmernenia k vymedzeniu systému umelej inteligencie v akte o umelej inteligencii s cieľom pomôcť zainteresovaným stranám pri určovaní rozsahu pôsobnosti aktu o umelej inteligencii

Vysoké riziko

Prípady použitia umelej inteligencie, ktoré môžu predstavovať vážne riziká pre zdravie, bezpečnosť alebo základné práva, sa klasifikujú ako vysokorizikové. Medzi tieto vysokorizikové prípady použitia patria:

- Bezpečnostné komponenty umelej inteligencie v kritických infraštruktúrach (napr. v doprave), ktorých zlyhanie by mohlo ohroziť život a zdravie občanov

- Riešenia umelej inteligencie používané vo vzdelávacích inštitúciách, ktoré môžu určovať prístup k vzdelávaniu a priebeh profesionálneho života osoby (napr. bodovanie skúšok)

- Bezpečnostné komponenty výrobkov založené na umelej inteligencii (napr. aplikácia umelej inteligencie v robotickej chirurgii)

- Nástroje umelej inteligencie na zamestnávanie, riadenie pracovníkov a prístup k samostatnej zárobkovej činnosti (napr. softvér na triedenie životopisov na účely náboru)

- Niektoré prípady použitia umelej inteligencie využívané na poskytovanie prístupu k základným súkromným a verejným službám (napr. bodové hodnotenie úverov, ktorým sa občanom odopiera možnosť získať úver)

- systémy umelej inteligencie používané na diaľkovú biometrickú identifikáciu, rozpoznávanie emócií a biometrickú kategorizáciu (napr. systém umelej inteligencie na spätnú identifikáciu obchodníka)

- Prípady použitia umelej inteligencie pri presadzovaní práva, ktoré môžu zasahovať do základných práv ľudí (napr. hodnotenie spoľahlivosti dôkazov)

- Prípady použitia umelej inteligencie pri riadení migrácie, azylu a kontroly hraníc (napr. automatizované preskúmanie žiadostí o víza)

- Riešenia umelej inteligencie používané pri výkone spravodlivosti a demokratických procesov (napr. riešenia umelej inteligencie na prípravu súdnych rozhodnutí)

Vysokorizikové systémy umelej inteligencie podliehajú pred uvedením na trh prísnym povinnostiam:

- primerané systémy hodnotenia a zmierňovania rizika

- vysoká kvalita súborov údajov vstupujúcich do systému s cieľom minimalizovať riziká diskriminačných výsledkov

- zaznamenávanie činnosti s cieľom zabezpečiť vysledovateľnosť výsledkov

- podrobnú dokumentáciu poskytujúcu všetky potrebné informácie o systéme a jeho účele pre orgány na posúdenie jeho súladu

- jasné a primerané informácie pre nasadzujúci subjekt

- primerané opatrenia ľudského dohľadu

- vysoká úroveň spoľahlivosti, kybernetickej bezpečnosti a presnosti

Pravidlá pre vysokorizikovú umelú inteligenciu nadobudnú účinnosť v auguste 2026 a auguste 2027.

Riziko transparentnosti

Týka sa to rizík spojených s potrebou transparentnosti v súvislosti s používaním umelej inteligencie. Aktom o umelej inteligencii sa zavádzajú osobitné povinnosti zverejňovania s cieľom zabezpečiť, aby boli ľudia informovaní, keď je to potrebné na zachovanie dôvery. Napríklad pri používaní systémov umelej inteligencie, ako sú chatboty, by ľudia mali byť informovaní o tom, že komunikujú so strojom, aby mohli prijať informované rozhodnutie.

Poskytovatelia generatívnej umelej inteligencie musia okrem toho zabezpečiť, aby bol obsah vytvorený umelou inteligenciou identifikovateľný. Okrem toho by mal byť určitý obsah vytvorený umelou inteligenciou jasne a viditeľne označený, konkrétne deepfakes a text uverejnený s cieľom informovať verejnosť o záležitostiach verejného záujmu.

Pravidlá transparentnosti aktu o umelej inteligencii nadobudnú účinnosť v auguste 2026.

Minimálne alebo žiadne riziko

Aktom o umelej inteligencii sa nezavádzajú pravidlá pre umelú inteligenciu, ktorá sa považuje za minimálne alebo žiadne riziko. Do tejto kategórie patrí prevažná väčšina systémov umelej inteligencie, ktoré sa v súčasnosti používajú v EÚ. Patria sem aplikácie, ako sú videohry s podporou umelej inteligencie alebo spamové filtre.

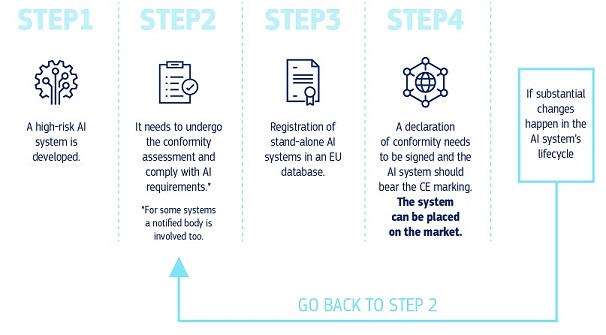

Ako to všetko funguje v praxi pre poskytovateľov vysokorizikových systémov umelej inteligencie?

Po uvedení systému umelej inteligencie na trh sú za dohľad nad trhom zodpovedné orgány, nasadzujúce subjekty zabezpečujú ľudský dohľad a monitorovanie a poskytovatelia majú zavedený systém monitorovania po uvedení na trh. Poskytovatelia a nasadzujúce subjekty budú takisto nahlasovať závažné incidenty a poruchy.

Aké sú pravidlá pre modely umelej inteligencie na všeobecné účely?

Modely umelej inteligencie na všeobecné účely (GPAI) môžu vykonávať širokú škálu úloh a stávajú sa základom mnohých systémov umelej inteligencie v EÚ. Niektoré z týchto modelov by mohli predstavovať systémové riziká, ak sú veľmi schopné alebo široko používané. S cieľom zaistiť bezpečnú a dôveryhodnú umelú inteligenciu sa v akte o umelej inteligencii zavádzajú pravidlá pre poskytovateľov takýchto modelov. To zahŕňa transparentnosť a pravidlá súvisiace s autorskými právami. V prípade modelov, ktoré môžu niesť systémové riziká, by poskytovatelia mali tieto riziká posúdiť a zmierniť. Pravidlá aktu o umelej inteligencii týkajúce sa GPAI nadobudli účinnosť v auguste 2025.

Podpora dodržiavania predpisov

V júli 2025 Komisia uverejnila tri kľúčové nástroje na podporu zodpovedného vývoja a zavádzania modelov GPAI:

- V usmerneniach k rozsahu povinností poskytovateľov modelov GPAI sa objasňuje rozsah povinností GPAI podľa aktu o umelej inteligencii, čo pomáha aktérom v celom hodnotovom reťazci umelej inteligencie pochopiť, kto musí tieto povinnosti dodržiavať.

- Kódex postupov GPAI je dobrovoľný nástroj na zabezpečenie súladu, ktorý Komisii predložili nezávislí experti a ktorý ponúka praktické usmernenia s cieľom pomôcť poskytovateľom plniť si povinnosti podľa aktu o umelej inteligencii týkajúce sa transparentnosti, autorských práv a bezpečnosti a ochrany.

- Vo vzore verejného zhrnutia obsahu odbornej prípravy modelov GPAI sa od poskytovateľov vyžaduje, aby poskytli prehľad údajov použitých na odbornú prípravu svojich modelov. Zahŕňa to zdroje, z ktorých boli údaje získané (pozostávajúce z veľkých súborov údajov a hlavných názvov domén). Vo vzore sa požadujú aj informácie o aspektoch spracúvania údajov, aby strany s oprávnenými záujmami mohli uplatňovať svoje práva podľa práva EÚ.

Tieto nástroje sú navrhnuté tak, aby pracovali ruka v ruke. Spoločne poskytujú jasný a realizovateľný rámec pre poskytovateľov modelov GPAI na dosiahnutie súladu s aktom o umelej inteligencii, zníženie administratívnej záťaže a podporu inovácií pri súčasnom zabezpečení základných práv a dôvery verejnosti.

Komisia vyvíja aj ďalšie podporné nástroje, ktoré poskytujú usmernenia o tom, ako dodržiavať pravidlá transparentnosti aktu o umelej inteligencii:

- Kódex postupov pre označovanie a etiketovanie obsahu vytvoreného umelou inteligenciou, ktorý vybral úrad pre umelú inteligenciu. Kódex bude dobrovoľným nástrojom na usmernenie poskytovateľov a subjektov nasadzujúcich generatívne systémy umelej inteligencie, aby dodržiavali povinnosti týkajúce sa transparentnosti. Patrí medzi ne označovanie obsahu vytvoreného umelou inteligenciou a zverejňovanie umelej povahy obrázkov a zvuku (vrátane deepfake), ako aj textu.

- Usmernenia o transparentných systémoch umelej inteligencie s cieľom objasniť rozsah uplatňovania, príslušné právne vymedzenia pojmov, povinnosti týkajúce sa transparentnosti, výnimky a súvisiace horizontálne otázky.

Tieto podporné nástroje sa pripravujú a uverejnia sa v druhom štvrťroku 2026. Viac informácií o tom, ako úrad pre umelú inteligenciu podporuje vykonávanie aktu o umelej inteligencii.

Riadenie a vykonávanie

Európsky úrad pre umelú inteligenciu a orgány členských štátov sú zodpovedné za vykonávanie aktu o umelej inteligencii, dohľad nad ním a jeho presadzovanie. Rada pre umelú inteligenciu, vedecká skupina a poradné fórum riadia a poskytujú poradenstvo v oblasti riadenia aktu o umelej inteligencii. Viac informácií o riadení a presadzovaní aktu o umelej inteligencii.

Harmonogram podávania prihlášok

Akt o umelej inteligencii nadobudol účinnosť 1. augusta 2024 a v plnej miere sa začne uplatňovať o dva roky neskôr, 2. augusta 2026, s niekoľkými výnimkami:

- zakázané postupy umelej inteligencie a povinnosti týkajúce sa gramotnosti v oblasti umelej inteligencie sa začali uplatňovať od 2. februára 2025

- pravidlá riadenia a povinnosti týkajúce sa modelov GPAI sa začali uplatňovať 2. augusta 2025

- pravidlá pre vysokorizikové systémy umelej inteligencie – zabudované do regulovaných výrobkov – majú predĺžené prechodné obdobie do 2. augusta 2027

Aký je návrh Komisie na zjednodušenie vykonávania aktu o umelej inteligencii?

V digitálnom balíku o zjednodušení sa navrhujú zmeny s cieľom zjednodušiť vykonávanie aktu o umelej inteligencii a zabezpečiť, aby pravidlá zostali jasné, jednoduché a priaznivé pre inovácie.

Komisia navrhuje upraviť harmonogram uplatňovania vysokorizikových pravidiel na maximálne 16 mesiacov. Tým sa zabezpečí, aby sa pravidlá uplatňovali vtedy, keď majú spoločnosti správne podporné nástroje na uľahčenie vykonávania, ako sú normy.

Komisia takisto navrhuje cielené zmeny aktu o umelej inteligencii, ktorými sa:

- posilniť právomoci úradu pre umelú inteligenciu a centralizovať dohľad nad systémami umelej inteligencie založenými na modeloch umelej inteligencie na všeobecné účely, čím sa zníži fragmentácia riadenia;

- rozšíriť určité zjednodušenia, ktoré sa poskytujú MSP a malým a stredným podnikom, vrátane zjednodušených požiadaviek na technickú dokumentáciu,

- žiada Komisiu a členské štáty, aby podporovali gramotnosť v oblasti umelej inteligencie a zabezpečili nepretržitú podporu pre spoločnosti tým, že budú stavať na existujúcom úsilí (ako je nedávno prepracovaný archív postupov úradu pre umelú inteligenciu v oblasti gramotnosti v oblasti umelej inteligencie), pričom zachovajú povinnosti v oblasti odbornej prípravy pre vysokorizikové nasadzujúce subjekty;

- rozšíriť opatrenia na podporu dodržiavania predpisov, aby viac inovátorov mohlo využívať experimentálne regulačné prostredia, ktoré sa zriadia od roku 2028, a rozšíriť možnosti testovania v reálnom svete;

- Upraviť postupy aktu o umelej inteligencii s cieľom objasniť jeho vzájomné pôsobenie s inými právnymi predpismi a zlepšiť jeho celkové vykonávanie a fungovanie.

To všetko dopĺňa opatrenia, ktoré Komisia a jej úrad pre umelú inteligenciu už prijímajú na zabezpečenie jasnosti pre podniky a vnútroštátne orgány, napríklad prostredníctvom usmernení, kódexov postupov a asistenčnej služby aktu o umelej inteligencii.

Legislatívny návrh bol prijatý 19. novembra. Európsky parlament a Rada EÚ teraz diskutujú a rokujú o digitálnom súhrnnom návrhu o umelej inteligencii.

Najnovšie správy

Politika a právne predpisy

Správa/štúdia

- 07-04-2026Umelá inteligencia v kardiovaskulárnej starostlivosti: od sľubu k praxi

- 17-03-2026Štúdia o umelej inteligencii v zdravotníctve rozoberá digitálne zdravotnícke technológie v Európe

- 01-12-2025Štúdia – ďalšia hranica údajov: generatívna umelá inteligencia, dodržiavanie právnych predpisov a medzinárodný rozmer

Prehľad/Infografika

Súvisiaci obsah

Širšia perspektíva

Hlbší pohľad

-

Európsky úrad pre umelú inteligenciu a vnútroštátne orgány dohľadu nad trhom sú zodpovedné za...

-

Cieľom Komisie je zvýšiť počet odborníkov na umelú inteligenciu odbornou prípravou a prilákaním...

-

Harmonizované normy poskytnú právnu istotu podľa aktu o umelej inteligencii, podporia inovácie a...

-

Nástroj na oznamovanie protispoločenskej činnosti v rámci aktu o umelej inteligencii umožňuje...