Akt w sprawie sztucznej inteligencji stanowi pierwsze w historii ramy prawne dotyczące sztucznej inteligencji, które odnoszą się do zagrożeń związanych ze sztuczną inteligencją i umożliwiają Europie odgrywanie wiodącej roli na świecie.

Akt w sprawie sztucznej inteligencji (rozporządzenie (UE) 2024/1689 ustanawiające zharmonizowane przepisy dotyczące sztucznej inteligencji) stanowi pierwsze w historii kompleksowe ramy prawne dotyczące sztucznej inteligencji na świecie. Celem przepisów jest wspieranie godnej zaufania sztucznej inteligencji w Europie. Wszelkie pytania dotyczące aktu w sprawie sztucznej inteligencji można znaleźć na platformie informacyjnej poświęconej aktowi w sprawie sztucznej inteligencji.

W akcie w sprawie sztucznej inteligencji określono oparte na analizie ryzyka przepisy dla podmiotów opracowujących i wdrażających sztuczną inteligencję dotyczące konkretnych zastosowań sztucznej inteligencji. Akt w sprawie sztucznej inteligencji jest częścią szerszego pakietu środków politycznych wspierających rozwój godnej zaufania sztucznej inteligencji, który obejmuje również plan działania na rzecz sztucznej inteligencji na kontynencie, pakiet na rzecz innowacji w dziedzinie sztucznej inteligencji oraz uruchomienie fabryk sztucznej inteligencji. Łącznie środki te gwarantują bezpieczeństwo, prawa podstawowe i sztuczną inteligencję ukierunkowaną na człowieka oraz zwiększają absorpcję, inwestycje i innowacje w zakresie sztucznej inteligencji w całej UE.

Aby ułatwić przejście do nowych ram regulacyjnych, Komisja uruchomiła pakt na rzecz sztucznej inteligencji, dobrowolną inicjatywę mającą na celu wspieranie przyszłego wdrażania, współpracę z zainteresowanymi stronami oraz zaproszenie dostawców i podmiotów wdrażających sztuczną inteligencję z Europy i spoza niej do wywiązania się z kluczowych obowiązków wynikających z aktu w sprawie sztucznej inteligencji z wyprzedzeniem. Jednocześnie punkt obsługi ds. aktu w sprawie sztucznej inteligencji zapewnia również informacje i wsparcie na rzecz sprawnego i skutecznego wdrożenia aktu w sprawie sztucznej inteligencji w całej UE.

Dlaczego potrzebujemy przepisów dotyczących sztucznej inteligencji?

Akt w sprawie sztucznej inteligencji zapewnia Europejczykom zaufanie do tego, co sztuczna inteligencja ma do zaoferowania. Chociaż większość systemów sztucznej inteligencji nie stwarza żadnego ryzyka i może przyczynić się do rozwiązania wielu wyzwań społecznych, niektóre systemy sztucznej inteligencji stwarzają ryzyko, któremu musimy przeciwdziałać, aby uniknąć niepożądanych wyników.

Na przykład często nie można dowiedzieć się, dlaczego system sztucznej inteligencji podjął decyzję lub prognozę i podjął konkretne działanie. W związku z tym ocena, czy dana osoba znalazła się w niesprawiedliwej sytuacji, na przykład w decyzji o zatrudnieniu lub we wniosku o przyznanie programu pożytku publicznego, może okazać się trudna.

Chociaż obowiązujące przepisy zapewniają pewną ochronę, nie są one wystarczające, aby sprostać szczególnym wyzwaniom, jakie mogą nieść ze sobą systemy sztucznej inteligencji.

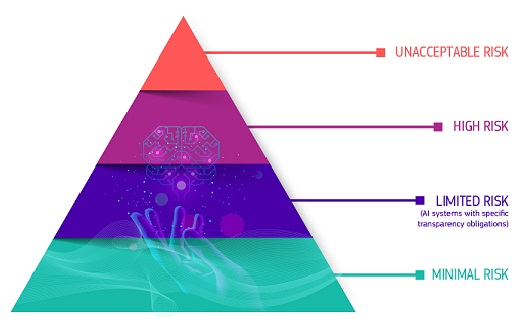

Podejście oparte na analizie ryzyka

W akcie w sprawie sztucznej inteligencji określono cztery poziomy ryzyka dla systemów sztucznej inteligencji:

Niedopuszczalne ryzyko

Wszystkie systemy sztucznej inteligencji uważane za wyraźne zagrożenie dla bezpieczeństwa, źródeł utrzymania i praw ludzi są zakazane. Akt w sprawie sztucznej inteligencji zakazuje ośmiu praktyk, a mianowicie:

- szkodliwe manipulacje i oszustwa oparte na sztucznej inteligencji

- szkodliwe wykorzystywanie słabych punktów w oparciu o sztuczną inteligencję

- punktacja społeczna

- Ocena lub przewidywanie ryzyka związanego z indywidualnym przestępstwem

- nieukierunkowane skrobanie materiałów internetowych lub CCTV w celu utworzenia lub rozszerzenia baz danych rozpoznawania twarzy

- rozpoznawanie emocji w miejscach pracy i instytucjach edukacyjnych

- kategoryzacja biometryczna w celu wydedukowania niektórych chronionych cech

- zdalna identyfikacja biometryczna w czasie rzeczywistym do celów egzekwowania prawa w przestrzeni publicznej

Zakazy weszły w życie w lutym 2025 r. Komisja opublikowała dwa kluczowe dokumenty na poparcie praktycznego stosowania zakazanych praktyk:

- Wytyczne dotyczące zakazanych praktyk w zakresie sztucznej inteligencji na podstawie aktu w sprawie sztucznej inteligencji, które zawierają wyjaśnienia prawne i praktyczne przykłady, aby pomóc zainteresowanym stronom w zrozumieniu i przestrzeganiu zakazów.

- Wytyczne dotyczące definicji systemu sztucznej inteligencji w akcie w sprawie sztucznej inteligencji, aby pomóc zainteresowanym stronom w określeniu zakresu aktu w sprawie sztucznej inteligencji

Wysokie ryzyko

Przypadki użycia sztucznej inteligencji, które mogą stanowić poważne zagrożenie dla zdrowia, bezpieczeństwa lub praw podstawowych, klasyfikuje się jako przypadki wysokiego ryzyka. Te przypadki użycia wysokiego ryzyka obejmują:

- Elementy bezpieczeństwa sztucznej inteligencji w infrastrukturze krytycznej (np. w transporcie), których awaria mogłaby zagrozić życiu i zdrowiu obywateli

- rozwiązania w zakresie sztucznej inteligencji stosowane w placówkach oświatowych, które mogą decydować o dostępie do edukacji i przebiegu życia zawodowego (np. punktacja egzaminów)

- Elementy bezpieczeństwa produktów oparte na sztucznej inteligencji (np. zastosowanie sztucznej inteligencji w chirurgii wspomaganej przez roboty)

- Narzędzia sztucznej inteligencji na potrzeby zatrudnienia, zarządzania pracownikami i dostępu do samozatrudnienia (np. oprogramowanie do sortowania CV na potrzeby rekrutacji)

- Niektóre przypadki użycia sztucznej inteligencji wykorzystywane do zapewnienia dostępu do podstawowych usług prywatnych i publicznych (np. punktowa ocena kredytowa pozbawiająca obywateli możliwości uzyskania pożyczki)

- systemy sztucznej inteligencji wykorzystywane do zdalnej identyfikacji biometrycznej, rozpoznawania emocji i kategoryzacji biometrycznej (np. system sztucznej inteligencji do identyfikacji z mocą wsteczną osoby dokonującej kradzieży w sklepie);

- Przypadki użycia sztucznej inteligencji w egzekwowaniu prawa, które mogą kolidować z prawami podstawowymi ludzi (np. ocena wiarygodności dowodów)

- Przypadki wykorzystania sztucznej inteligencji w zarządzaniu migracją, azylem i kontrolą graniczną (np. automatyczne rozpatrywanie wniosków wizowych)

- Rozwiązania w zakresie sztucznej inteligencji wykorzystywane w wymiarze sprawiedliwości i procesach demokratycznych (np. rozwiązania w zakresie sztucznej inteligencji służące przygotowywaniu orzeczeń sądowych)

Systemy sztucznej inteligencji wysokiego ryzyka podlegają rygorystycznym obowiązkom przed wprowadzeniem ich do obrotu:

- odpowiednie systemy oceny i ograniczania ryzyka

- wysoka jakość zbiorów danych zasilających system w celu zminimalizowania ryzyka dyskryminacyjnych wyników

- rejestrowanie działalności w celu zapewnienia identyfikowalności wyników

- szczegółową dokumentację zawierającą wszystkie niezbędne informacje na temat systemu i jego celu, w jakim organy mogą ocenić jego zgodność z przepisami;

- jasne i odpowiednie informacje dla podmiotu wdrażającego

- odpowiednie środki nadzoru ze strony człowieka

- wysoki poziom solidności, cyberbezpieczeństwa i dokładności

Przepisy dotyczące sztucznej inteligencji wysokiego ryzyka wejdą w życie w sierpniu 2026 r. i sierpniu 2027 r.

Ryzyko związane z przejrzystością

Odnosi się to do ryzyka związanego z potrzebą przejrzystości w zakresie stosowania sztucznej inteligencji. Akt w sprawie sztucznej inteligencji wprowadza szczegółowe obowiązki w zakresie ujawniania informacji w celu zapewnienia, aby ludzie byli informowani, gdy jest to konieczne do zachowania zaufania. Na przykład podczas korzystania z systemów sztucznej inteligencji, takich jak chatboty, należy uświadomić ludziom, że wchodzą w interakcję z maszyną, aby mogli podjąć świadomą decyzję.

Ponadto dostawcy generatywnej sztucznej inteligencji muszą zapewnić identyfikowalność treści generowanych przez sztuczną inteligencję. Ponadto niektóre treści generowane przez sztuczną inteligencję powinny być wyraźnie i widocznie oznakowane, a mianowicie treści typu deepfake i teksty publikowane w celu informowania opinii publicznej o sprawach leżących w interesie publicznym.

Przepisy dotyczące przejrzystości zawarte w akcie w sprawie sztucznej inteligencji wejdą w życie w sierpniu 2026 r.

Minimalne ryzyko lub brak ryzyka

Akt w sprawie sztucznej inteligencji nie wprowadza przepisów dotyczących sztucznej inteligencji, którą uznaje się za obarczoną minimalnym ryzykiem lub nieobciążoną żadnym ryzykiem. Zdecydowana większość systemów sztucznej inteligencji obecnie wykorzystywanych w UE należy do tej kategorii. Obejmuje to aplikacje takie jak gry wideo wykorzystujące sztuczną inteligencję lub filtry spamu.

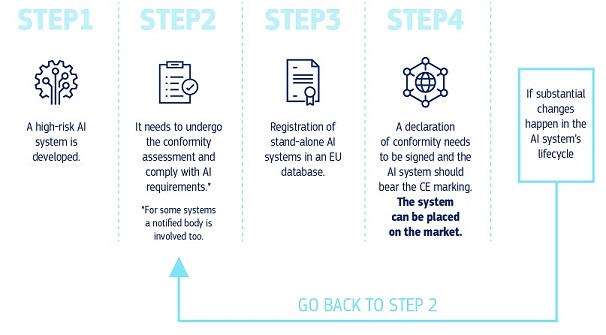

Jak to wszystko działa w praktyce w przypadku dostawców systemów sztucznej inteligencji wysokiego ryzyka?

Po wprowadzeniu systemu sztucznej inteligencji do obrotu organy są odpowiedzialne za nadzór rynku, podmioty wdrażające zapewniają nadzór i monitorowanie przez człowieka, a dostawcy dysponują systemem monitorowania po wprowadzeniu do obrotu. Dostawcy i podmioty wdrażające będą również zgłaszać poważne incydenty i nieprawidłowe działanie.

Jakie są zasady dotyczące modeli AI ogólnego przeznaczenia?

Modele sztucznej inteligencji ogólnego przeznaczenia (GPAI) mogą wykonywać szeroki zakres zadań i stają się podstawą wielu systemów sztucznej inteligencji w UE. Niektóre z tych modeli mogą wiązać się z ryzykiem systemowym, jeśli są bardzo zdolne lub szeroko stosowane. Aby zapewnić bezpieczną i wiarygodną sztuczną inteligencję, w akcie w sprawie sztucznej inteligencji wprowadzono przepisy dotyczące dostawców takich modeli. Obejmuje to przejrzystość i przepisy dotyczące praw autorskich. W przypadku modeli, które mogą wiązać się z ryzykiem systemowym, dostawcy powinni oceniać i ograniczać to ryzyko. Przepisy aktu w sprawie sztucznej inteligencji dotyczące sztucznej inteligencji ogólnego przeznaczenia weszły w życie w sierpniu 2025 r.

Wspieranie zgodności

W lipcu 2025 r. Komisja opublikowała trzy kluczowe instrumenty wspierające odpowiedzialne opracowywanie i wdrażanie modeli sztucznej inteligencji ogólnej:

- W wytycznych w sprawie zakresu obowiązków dostawców modeli sztucznej inteligencji ogólnego przeznaczenia wyjaśniono zakres obowiązków w zakresie sztucznej inteligencji ogólnego przeznaczenia wynikających z aktu w sprawie sztucznej inteligencji, pomagając podmiotom w całym łańcuchu wartości sztucznej inteligencji zrozumieć, kto musi wywiązywać się z tych obowiązków.

- Kodeks postępowania w zakresie sztucznej inteligencji ogólnego przeznaczenia jest dobrowolnym narzędziem zapewniania zgodności przedłożonym Komisji przez niezależnych ekspertów, które oferuje praktyczne wskazówki, aby pomóc dostawcom w wypełnianiu ich obowiązków wynikających z aktu w sprawie sztucznej inteligencji w odniesieniu do przejrzystości, praw autorskich i bezpieczeństwa & security.

- W szablonie publicznego podsumowania treści szkoleniowych modeli GPAI wymaga się od dostawców przedstawienia przeglądu danych wykorzystywanych do szkolenia ich modeli. Obejmuje to źródła, z których pozyskano dane (obejmujące duże zbiory danych i najważniejsze nazwy domen).W szablonie zwrócono się również o informacje na temat aspektów przetwarzania danych, aby umożliwić stronom mającym uzasadniony interes korzystanie z praw przysługujących im na mocy prawa UE.

Narzędzia te są przeznaczone do pracy ręka w rękę. Wspólnie zapewniają one jasne i wykonalne ramy dla dostawców modeli sztucznej inteligencji ogólnego przeznaczenia w celu zapewnienia zgodności z aktem w sprawie sztucznej inteligencji, zmniejszenia obciążeń administracyjnych i wspierania innowacji przy jednoczesnej ochronie praw podstawowych i zaufania publicznego.

Komisja opracowuje również inne narzędzia wspierające, które oferują wytyczne dotyczące sposobu przestrzegania zasad przejrzystości określonych w akcie w sprawie sztucznej inteligencji:

- Kodeks postępowania w zakresie oznaczania i etykietowania treści generowanych przez sztuczną inteligencję wybrany przez Urząd ds. Sztucznej Inteligencji. Kodeks będzie dobrowolnym narzędziem pomagającym dostawcom i podmiotom wdrażającym generatywne systemy sztucznej inteligencji w wypełnianiu obowiązków w zakresie przejrzystości. Obejmują one oznaczanie treści generowanych przez sztuczną inteligencję i ujawnianie sztucznego charakteru obrazów, audio (w tym deepfake'ów) oraz tekstu.

- Wytyczne w sprawie przejrzystych systemów sztucznej inteligencji w celu wyjaśnienia zakresu stosowania, odpowiednich definicji prawnych, obowiązków w zakresie przejrzystości, wyjątków i powiązanych kwestii horyzontalnych.

Te instrumenty wsparcia są w przygotowaniu i zostaną opublikowane w drugim kwartale 2026 r. Dowiedz się więcej o tym, w jaki sposób Urząd ds. Sztucznej Inteligencji wspiera wdrażanie aktu w sprawie sztucznej inteligencji.

Zarządzanie i wdrażanie

Europejski Urząd ds. Sztucznej Inteligencji i organy państw członkowskich są odpowiedzialne za wdrażanie, nadzorowanie i egzekwowanie aktu w sprawie sztucznej inteligencji. Rada ds. AI, panel naukowy i forum doradcze kierują zarządzaniem aktem w sprawie AI i doradzają w tym zakresie. Więcej informacji na temat zarządzania aktem w sprawie sztucznej inteligencji i jego egzekwowania.

Harmonogram składania wniosków

Akt w sprawie sztucznej inteligencji wszedł w życie 1 sierpnia 2024 r. i zacznie w pełni obowiązywać 2 lata później, 2 sierpnia 2026 r., z pewnymi wyjątkami:

- zakazanych praktyk związanych ze sztuczną inteligencją i obowiązków w zakresie umiejętności korzystania ze sztucznej inteligencji, które weszły w życie 2 lutego 2025 r.

- zasady zarządzania i obowiązki dotyczące modeli GPAI zaczęły obowiązywać 2 sierpnia 2025 r.

- przepisy dotyczące systemów sztucznej inteligencji wysokiego ryzyka – wbudowanych w produkty regulowane – mają przedłużony okres przejściowy do 2 sierpnia 2027 r.

Jaki jest wniosek Komisji dotyczący uproszczenia wdrażania aktu w sprawie sztucznej inteligencji?

W pakiecie cyfrowym dotyczącym uproszczenia zaproponowano zmiany mające na celu uproszczenie wdrażania aktu w sprawie sztucznej inteligencji i zapewnienie, aby przepisy pozostały jasne, proste i sprzyjające innowacjom.

Komisja proponuje dostosowanie harmonogramu stosowania zasad wysokiego ryzyka do maksymalnie 16 miesięcy. Dzięki temu przepisy mają zastosowanie, gdy przedsiębiorstwa dysponują odpowiednimi narzędziami wsparcia ułatwiającymi wdrażanie, takimi jak normy.

Komisja proponuje również ukierunkowane zmiany w akcie w sprawie sztucznej inteligencji, które:

- wzmocnienie uprawnień Urzędu ds. AI i scentralizowanie nadzoru nad systemami AI opartymi na modelach AI ogólnego przeznaczenia, co zmniejszy fragmentację zarządzania;

- rozszerzenie niektórych uproszczeń przyznawanych MŚP i pomorskim krajom południowego regionu Morza Śródziemnego, w tym uproszczonych wymogów dotyczących dokumentacji technicznej;

- zobowiązać Komisję i państwa członkowskie do promowania umiejętności korzystania ze sztucznej inteligencji i zapewnienia przedsiębiorstwom stałego wsparcia w oparciu o istniejące wysiłki (takie jak niedawno odnowione repozytorium praktyk Urzędu ds. Sztucznej Inteligencji w zakresie umiejętności korzystania ze sztucznej inteligencji), przy jednoczesnym utrzymaniu obowiązków szkoleniowych dla podmiotów wdrażających wysokiego ryzyka;

- rozszerzenie środków wspierających zgodność, tak aby więcej innowatorów mogło skorzystać z piaskownic regulacyjnych, które zostaną utworzone od 2028 r., oraz poprzez rozszerzenie możliwości testowania w warunkach rzeczywistych;

- Dostosowanie procedur aktu w sprawie sztucznej inteligencji w celu wyjaśnienia jego wzajemnych powiązań z innymi przepisami oraz poprawy jego ogólnego wdrażania i funkcjonowania.

Wszystkie te działania uzupełniają działania, które Komisja i jej Urząd ds. Sztucznej Inteligencji już podejmują w celu zapewnienia jasności przedsiębiorstwom i organom krajowym, na przykład za pośrednictwem wytycznych, kodeksów praktyk i punktu obsługi ds. aktu w sprawie sztucznej inteligencji.

Wniosek ustawodawczy został przyjęty w dniu 19 listopada. Parlament Europejski i Rada UE omawiają obecnie i negocjują cyfrowy zbiorczy akt prawny w sprawie sztucznej inteligencji.

Najnowsze wiadomości

Polityka i prawodawstwo

- 05-03-2026Komisja publikuje drugi projekt kodeksu postępowania w zakresie znakowania i etykietowania treści generowanych przez sztuczną inteligencję

- 20-02-2026Deklaracja przywódców na szczycie w sprawie wpływu sztucznej inteligencji w Indiach

- 21-01-2026Wniosek dotyczący rozporządzenia w sprawie aktu o sieciach cyfrowych

Sprawozdanie/badanie

- 07-04-2026Sztuczna inteligencja w opiece sercowo-naczyniowej: od obietnicy do praktyki

- 17-03-2026Badanie na temat sztucznej inteligencji w opiece zdrowotnej analizuje cyfrowe technologie medyczne w Europie

- 01-12-2025Badanie – następna granica danych: generatywna sztuczna inteligencja, zgodność z przepisami i wymiar międzynarodowy

Zestawienie informacji / infografika

Broszura

- 22-12-2025Wzrost inteligentnej przewagi – wgląd w MetaOS

- 04-02-2025Żywe repozytorium w celu wspierania uczenia się i wymiany w zakresie umiejętności korzystania ze sztucznej inteligencji

- 04-03-2024Program „Horyzont Europa”: nowe projekty w dziedzinie sztucznej inteligencji, danych i robotyki – 2024 Edition

Podobne tematy

W szerszej perspektywie

Szczegółowe wyjaśnienia

-

Europejski Urząd ds. Sztucznej Inteligencji i krajowe organy nadzoru rynku są odpowiedzialne za...

-

Komisja dąży do zwiększenia liczby ekspertów w dziedzinie sztucznej inteligencji poprzez szkolenie i...

-

Zharmonizowane normy zapewnią pewność prawa na mocy aktu w sprawie sztucznej inteligencji, będą...

-

Narzędzie sygnalistów w ramach aktu w sprawie sztucznej inteligencji umożliwia osobom fizycznym...