AI-akten är den första rättsliga ramen någonsin för AI, som tar itu med riskerna med AI och positionerar Europa att spela en ledande roll globalt.

AI-akten (förordning (EU) 2024/1689 om harmoniserade regler för artificiell intelligens) är den första övergripande rättsliga ramen någonsin för AI i världen. Syftet med reglerna är att främja tillförlitlig AI i Europa. Om du har frågor om AI-akten kan du kolla in den gemensamma informationsplattformen för AI-akten.

I AI-akten fastställs riskbaserade regler för AI-utvecklare och AI-användare när det gäller specifik användning av AI. AI-akten är en del av ett bredare paket med politiska åtgärder för att stödja utvecklingen av tillförlitlig AI, som också omfattar handlingsplanen för AI-kontinenten, AI-innovationspaketet och lanseringen av AI-fabriker. Tillsammans garanterar dessa åtgärder säkerhet, grundläggande rättigheter och människocentrerad AI och stärker spridningen, investeringarna och innovationen inom AI i hela EU.

För att underlätta övergången till det nya regelverket har kommissionen lanserat AI-pakten, ett frivilligt initiativ som syftar till att stödja det framtida genomförandet, samarbeta med berörda parter och uppmana leverantörer och spridare av AI från och utanför Europa att uppfylla de viktigaste skyldigheterna i AI-akten i förväg. Samtidigt tillhandahåller servicedesken för AI-akten också information och stöd för ett smidigt och effektivt genomförande av AI-akten i hela EU.

Varför behövs regler om AI?

AI-akten säkerställer att européerna kan lita på vad AI har att erbjuda. Även om de flesta AI-system utgör begränsade till inga risker och kan bidra till att lösa många samhällsutmaningar, skapar vissa AI-system risker som vi måste ta itu med för att undvika oönskade resultat.

Till exempel är det ofta inte möjligt att ta reda på varför ett AI-system har fattat ett beslut eller förutsägelse och vidtagit en viss åtgärd. Det kan därför bli svårt att bedöma om någon har missgynnats på ett orättvist sätt, till exempel i ett anställningsbeslut eller i en ansökan om ett offentligt förmånssystem.

Även om befintlig lagstiftning ger ett visst skydd är den inte tillräcklig för att ta itu med de särskilda utmaningar som AI-system kan medföra.

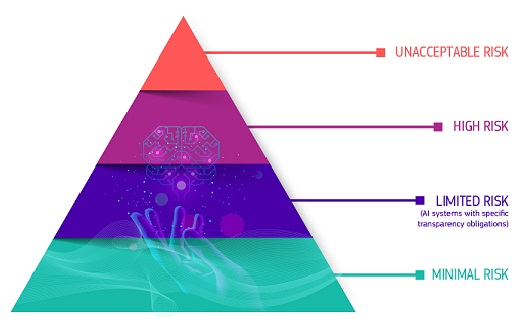

En riskbaserad metod

I AI-akten fastställs fyra risknivåer för AI-system:

Oacceptabel risk

Alla AI-system som anses utgöra ett tydligt hot mot människors säkerhet, försörjningsmöjligheter och rättigheter är förbjudna. I AI-akten förbjuds åtta metoder, nämligen

- skadlig AI-baserad manipulation och vilseledande

- skadligt AI-baserat utnyttjande av sårbarheter

- social poängsättning

- Bedömning eller förutsägelse av risken för enskilda brott

- oriktad skrapning av internet- eller CCTV-material för att skapa eller utöka databaser för ansiktsigenkänning

- Känsloigenkänning på arbetsplatser och utbildningsinstitutioner

- Biometrisk kategorisering för att härleda vissa skyddade egenskaper

- Biometrisk fjärridentifiering i realtid för brottsbekämpande ändamål på allmänt tillgängliga platser

Förbuden trädde i kraft i februari 2025. Kommissionen offentliggjorde två viktiga dokument till stöd för den praktiska tillämpningen av förbjudna metoder:

- Riktlinjerna om förbjudna AI-metoder enligt AI-akten, som erbjuder rättsliga förklaringar och praktiska exempel för att hjälpa berörda parter att förstå och följa förbuden.

- Riktlinjerna om definitionen av AI-system i AI-akten, för att hjälpa berörda parter att fastställa AI-aktens tillämpningsområde

Hög risk

AI-användningsfall som kan utgöra allvarliga risker för hälsa, säkerhet eller grundläggande rättigheter klassificeras som högriskfall. Dessa användningsfall med hög risk omfattar följande:

- AI-säkerhetskomponenter i kritisk infrastruktur (t.ex. transport), vars misslyckande skulle kunna äventyra medborgarnas liv och hälsa

- AI-lösningar som används vid utbildningsinstitutioner och som kan avgöra tillgången till utbildning och yrkeslivets förlopp (t.ex. poängsättning av prov)

- AI-baserade säkerhetskomponenter i produkter (t.ex. AI-tillämpningar inom robotassisterad kirurgi)

- AI-verktyg för anställning, hantering av arbetstagare och tillgång till egenföretagande (t.ex. programvara för CV-sortering för rekrytering)

- Vissa fall av AI-användning som används för att ge tillgång till viktiga privata och offentliga tjänster (t.ex. kreditbedömning som nekar medborgarna möjlighet att få ett lån)

- AI-system som används för biometrisk fjärridentifiering, känsloigenkänning och biometrisk kategorisering (t.ex. AI-system för att retroaktivt identifiera en snattare)

- AI-användningsfall inom brottsbekämpning som kan inkräkta på människors grundläggande rättigheter (t.ex. utvärdering av bevisens tillförlitlighet)

- AI-användningsfall inom migrations-, asyl- och gränskontrollhantering (t.ex. automatisk prövning av viseringsansökningar)

- AI-lösningar som används vid rättskipning och demokratiska processer (t.ex. AI-lösningar för att förbereda domstolsavgöranden)

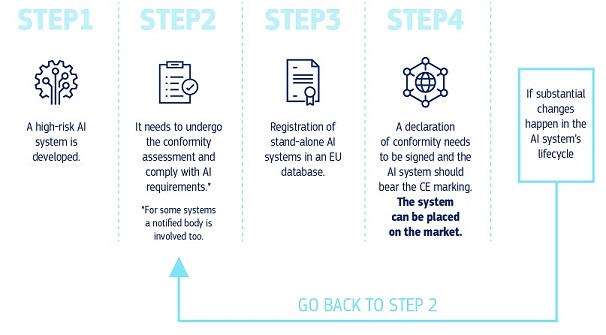

AI-system med hög risk omfattas av strikta skyldigheter innan de kan släppas ut på marknaden:

- Lämpliga system för riskbedömning och riskreducering.

- Högkvalitativa dataset som matar systemet för att minimera riskerna för diskriminerande resultat.

- loggning av verksamhet för att säkerställa spårbarhet av resultat

- detaljerad dokumentation med all nödvändig information om systemet och dess syfte för att myndigheterna ska kunna bedöma dess överensstämmelse

- Tydlig och adekvat information till spridaren.

- lämpliga åtgärder för mänsklig tillsyn

- hög robusthet, cybersäkerhet och noggrannhet

Reglerna för AI med hög risk träder i kraft i augusti 2026 och augusti 2027.

Öppenhetsrisk

Detta avser de risker som är förknippade med behovet av transparens kring användningen av AI. Genom AI-akten införs särskilda upplysningsskyldigheter för att säkerställa att människor informeras när det är nödvändigt för att bevara förtroendet. När man till exempel använder AI-system som chatbots bör människor göras medvetna om att de interagerar med en maskin så att de kan fatta ett välgrundat beslut.

Dessutom måste leverantörer av generativ AI säkerställa att AI-genererat innehåll är identifierbart. Dessutom bör visst AI-genererat innehåll märkas på ett tydligt och synligt sätt, nämligen deepfake och text som offentliggörs i syfte att informera allmänheten om frågor av allmänt intresse.

Öppenhetsreglerna i AI-akten kommer att träda i kraft i augusti 2026.

Minimal eller ingen risk

AI-akten inför inte regler för AI som anses vara minimal eller ingen risk. De allra flesta AI-system som för närvarande används i EU ingår i denna kategori. Detta inkluderar applikationer som AI-aktiverade videospel eller spamfilter.

Hur fungerar det i praktiken för leverantörer av AI-system med hög risk?

När ett AI-system väl finns på marknaden ansvarar myndigheterna för marknadskontroll, spridarna säkerställer mänsklig tillsyn och övervakning och leverantörerna har ett system för övervakning efter utsläppandet på marknaden. Leverantörer och spridare kommer också att rapportera allvarliga incidenter och funktionsfel.

Vilka regler gäller för AI-modeller för allmänna ändamål?

AI-modeller för allmänna ändamål kan utföra många olika uppgifter och håller på att bli grunden för många AI-system i EU. Vissa av dessa modeller skulle kunna medföra systemrisker om de är mycket kapabla eller används i stor utsträckning. För att säkerställa säker och tillförlitlig AI införs genom AI-akten regler för leverantörer av sådana modeller. Detta inbegriper öppenhet och upphovsrättsrelaterade regler. För modeller som kan medföra systemrisker bör leverantörerna bedöma och minska dessa risker. AI-lagens regler om GPAI trädde i kraft i augusti 2025.

Stödja efterlevnad

I juli 2025 offentliggjorde kommissionen tre viktiga instrument för att stödja en ansvarsfull utveckling och användning av GPAI-modeller:

- I riktlinjerna om omfattningen av skyldigheterna för leverantörer av GPAI-modeller klargörs omfattningen av GPAI-skyldigheterna enligt AI-akten, vilket hjälper aktörer längs AI-värdekedjan att förstå vem som måste uppfylla dessa skyldigheter.

- GPAI:s uppförandekod är ett frivilligt efterlevnadsverktyg som lämnats in till kommissionen av oberoende experter och som erbjuder praktisk vägledning för att hjälpa leverantörer att uppfylla sina skyldigheter enligt AI-akten när det gäller transparens, upphovsrätt och säkerhet.

- Enligt mallen för den offentliga sammanfattningen av utbildningsinnehållet i GPAI-modeller ska leverantörerna ge en översikt över de data som används för att träna deras modeller. Detta inbegriper de källor från vilka uppgifterna erhölls (som omfattar stora datamängder och toppdomännamn). Mallen begär också information om databehandlingsaspekter för att göra det möjligt för parter med legitima intressen att utöva sina rättigheter enligt EU-lagstiftningen.

Dessa verktyg är utformade för att fungera hand i hand. Tillsammans utgör de en tydlig och genomförbar ram för att leverantörer av GPAI-modeller ska kunna följa AI-akten, minska den administrativa bördan och främja innovation samtidigt som grundläggande rättigheter och allmänhetens förtroende skyddas.

Kommissionen håller också på att ta fram andra stödverktyg som ger vägledning om hur AI-aktens transparensregler ska följas:

- Den uppförandekod för märkning och etikettering av AI-genererat innehåll som valts ut av AI-byrån. Koden kommer att vara ett frivilligt verktyg för att vägleda leverantörer och spridare av generativa AI-system att uppfylla transparenskraven. Dessa inkluderar märkning av AI-genererat innehåll och avslöjande av bilders artificiella natur, ljud (inklusive deepfakes) samt text.

- Riktlinjerna om transparenta AI-system för att klargöra tillämpningsområdet, relevanta rättsliga definitioner, transparenskraven, undantagen och relaterade övergripande frågor.

Dessa stödinstrument håller på att utarbetas och kommer att offentliggöras under andra kvartalet 2026. Läs mer om hur AI-byrån stöder genomförandet av AI-akten.

Styrning och genomförande

Europeiska AI-byrån och medlemsstaternas myndigheter ansvarar för att genomföra, övervaka och verkställa AI-akten. AI-nämnden, den vetenskapliga panelen och den rådgivande gruppen styr och ger råd om styrningen av AI-akten. Läs mer om styrningen och efterlevnaden av AI-akten.

Tidsplan för ansökan

AI-akten trädde i kraft den 1 augusti 2024 och kommer att tillämpas fullt ut två år senare, den 2 augusti 2026, med vissa undantag:

- Förbjudna AI-metoder och skyldigheter avseende AI-kompetens som började tillämpas från och med den 2 februari 2025.

- Styrningsreglerna och skyldigheterna för GPAI-modellerna började tillämpas den 2 augusti 2025.

- Reglerna för AI-system med hög risk – inbäddade i reglerade produkter – har en förlängd övergångsperiod till och med den 2 augusti 2027.

Vad är kommissionens förslag för att förenkla genomförandet av AI-akten?

I det digitala förenklingspaketet föreslås ändringar för att förenkla genomförandet av AI-akten och säkerställa att reglerna förblir tydliga, enkla och innovationsvänliga.

Kommissionen föreslår att tidsfristen för tillämpning av högriskreglerna anpassas till högst 16 månader. Detta säkerställer att reglerna gäller när företagen har rätt stödverktyg för att underlätta genomförandet, t.ex. standarder.

Kommissionen föreslår också riktade ändringar av AI-akten som kommer att

- Stärka AI-byråns befogenheter och centralisera tillsynen av AI-system som bygger på AI-modeller för allmänna ändamål, vilket minskar fragmenteringen av styrningen.

- Utvidga vissa förenklingar som beviljas små och medelstora företag och länder i södra Medelhavsområdet, inbegripet förenklade krav på teknisk dokumentation.

- Kräva att kommissionen och medlemsstaterna främjar AI-kompetens och säkerställer kontinuerligt stöd till företag genom att bygga vidare på befintliga insatser (t.ex. AI-byråns databas över metoder för AI-kompetens, som nyligen moderniserats), samtidigt som utbildningsskyldigheter för högriskanvändare bibehålls.

- Bredda åtgärderna till stöd för efterlevnad så att fler innovatörer kan dra nytta av regulatoriska sandlådor som kommer att inrättas från och med 2028 och genom att utöka möjligheterna till testning under verkliga förhållanden.

- Anpassa AI-aktens förfaranden för att klargöra dess samspel med andra lagar och förbättra dess övergripande genomförande och funktion.

Allt detta kompletterar åtgärder som kommissionen och dess AI-byrå redan vidtar för att skapa klarhet för företag och nationella myndigheter, till exempel genom riktlinjer, uppförandekoder och AI Act Service Desk.

Lagstiftningsförslaget antogs den 19 november. Europaparlamentet och rådet diskuterar och förhandlar nu om den digitala samlingsförordningen om AI.

Senaste nytt

Politik och lagstiftning

Rapport/studie

Faktablad/infografik

Läs mer

Översikt

Fördjupning

-

Europeiska AI-byrån och de nationella marknadskontrollmyndigheterna ansvarar för att genomföra...

-

Kommissionen strävar efter att öka antalet AI-experter genom att utbilda och locka fler forskare och...

-

Harmoniserade standarder kommer att erbjuda rättssäkerhet enligt AI-akten, stödja innovation och ge...

-

AI Act Whistleblower Tool ger enskilda personer möjlighet att på ett säkert sätt lämna in en rapport...