Tekoälysäädös on kaikkien aikojen ensimmäinen tekoälyä koskeva oikeudellinen kehys, jolla puututaan tekoälyn riskeihin ja asetetaan Eurooppa johtavaan asemaan maailmanlaajuisesti.

Tekoälysäädös (asetus (EU) 2024/1689 tekoälyä koskevista yhdenmukaistetuista säännöistä) on kaikkien aikojen ensimmäinen kattava tekoälyä koskeva oikeudellinen kehys maailmanlaajuisesti. Sääntöjen tavoitteena on edistää luotettavaa tekoälyä Euroopassa. Tekoälysäädöstä koskevia kysymyksiä on tekoälysäädöksen keskitetyllä tietoalustalla.

Tekoälysäädöksessä vahvistetaan tekoälyn kehittäjiä ja käyttöönottajia koskevat riskiperusteiset säännöt, jotka koskevat tekoälyn tiettyjä käyttötarkoituksia. Tekoälysäädös on osa laajempaa toimenpidepakettia, jolla tuetaan luotettavan tekoälyn kehittämistä ja johon kuuluvat myös tekoälyä koskeva Euroopan laajuinen toimintasuunnitelma, tekoälyn innovointipaketti ja tekoälytehtaiden perustaminen. Yhdessä näillä toimenpiteillä taataan turvallisuus, perusoikeudet ja ihmiskeskeinen tekoäly ja vahvistetaan tekoälyn käyttöönottoa, investointeja ja innovointia kaikkialla EU:ssa.

Uuteen sääntelykehykseen siirtymisen helpottamiseksi komissio on käynnistänyt tekoälysopimuksen. Kyseessä on vapaaehtoinen aloite, jolla pyritään tukemaan tulevaa täytäntöönpanoa, tekemään yhteistyötä sidosryhmien kanssa ja pyytämään tekoälyn tarjoajia ja käyttöönottajia Euroopasta ja sen ulkopuolelta noudattamaan tekoälysäädöksen keskeisiä velvoitteita hyvissä ajoin. Samaan aikaan tekoälysäädöksen palvelupiste tarjoaa myös tietoa ja tukea tekoälysäädöksen sujuvalle ja tehokkaalle täytäntöönpanolle kaikkialla EU:ssa.

Miksi tekoälyä koskevia sääntöjä tarvitaan?

Tekoälysäädöksellä varmistetaan, että eurooppalaiset voivat luottaa siihen, mitä tekoälyllä on tarjottavanaan. Vaikka useimmat tekoälyjärjestelmät aiheuttavat vain vähän riskejä ja voivat auttaa ratkaisemaan monia yhteiskunnallisia haasteita, tietyt tekoälyjärjestelmät aiheuttavat riskejä, joihin on puututtava ei-toivottujen tulosten välttämiseksi.

Usein ei esimerkiksi ole mahdollista selvittää, miksi tekoälyjärjestelmä on tehnyt päätöksen tai ennusteen ja toteuttanut tietyn toimen. Näin ollen voi olla vaikea arvioida, onko joku joutunut epäoikeudenmukaisesti epäedulliseen asemaan esimerkiksi työhönottopäätöksessä tai yleishyödyllistä järjestelmää koskevassa hakemuksessa.

Vaikka voimassa oleva lainsäädäntö tarjoaa jonkin verran suojaa, se ei riitä vastaamaan tekoälyjärjestelmien mahdollisesti tuomiin erityishaasteisiin.

Riskiperusteinen lähestymistapa

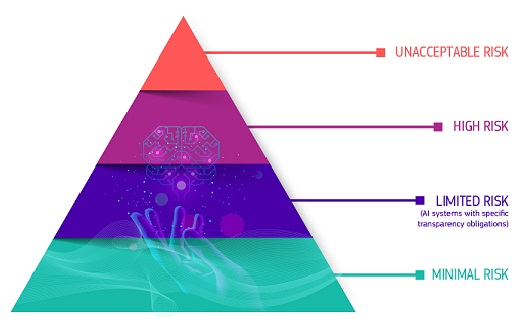

Tekoälysäädöksessä määritellään tekoälyjärjestelmille neljä riskitasoa:

Riski, jota ei voida hyväksyä

Kaikki tekoälyjärjestelmät, joita pidetään selvänä uhkana ihmisten turvallisuudelle, toimeentulolle ja oikeuksille, on kielletty. Tekoälysäädöksessä kielletään seuraavat kahdeksan käytäntöä:

- haitallinen tekoälyyn perustuva manipulointi ja petos

- haavoittuvuuksien haitallinen tekoälyyn perustuva hyödyntäminen

- sosiaalinen pisteytys

- Yksittäisen rikoksen riskien arviointi tai ennustaminen

- Internetin tai kameravalvontamateriaalin kohdentamaton kaavinta kasvojentunnistustietokantojen luomiseksi tai laajentamiseksi

- Tunteiden tunnistaminen työpaikoilla ja oppilaitoksissa

- biometrinen luokittelu tiettyjen suojattujen ominaisuuksien määrittämiseksi

- reaaliaikainen biometrinen etätunnistus lainvalvontatarkoituksessa julkisissa tiloissa

Kiellot tulivat voimaan helmikuussa 2025. Komissio julkaisi kaksi keskeistä asiakirjaa kiellettyjen käytäntöjen käytännön soveltamisen tueksi:

- Tekoälysäädöksen mukaisia kiellettyjä tekoälykäytäntöjä koskevat ohjeet, joissa annetaan oikeudellisia selityksiä ja käytännön esimerkkejä, jotka auttavat sidosryhmiä ymmärtämään kieltoja ja noudattamaan niitä.

- Tekoälysäädöksen tekoälyjärjestelmän määritelmää koskevat ohjeet, joilla autetaan sidosryhmiä määrittämään tekoälysäädöksen soveltamisala

Suuri riski

Tekoälyn käyttötapaukset, jotka voivat aiheuttaa vakavia riskejä terveydelle, turvallisuudelle tai perusoikeuksille, luokitellaan suuririskisiksi. Tällaisia suuririskisiä käyttötapauksia ovat muun muassa seuraavat:

- Tekoälyn turvakomponentit kriittisissä infrastruktuureissa (esim. liikenteessä), joiden vikaantuminen voisi vaarantaa kansalaisten hengen ja terveyden

- Oppilaitoksissa käytettävät tekoälyratkaisut, jotka voivat määrittää koulutukseen pääsyn ja henkilön työelämän kulun (esim. tenttien pisteytys)

- Tekoälyyn perustuvat tuotteiden turvakomponentit (esim. tekoälysovellus robottiavusteisessa kirurgiassa)

- Tekoälyvälineet työllistymistä, työntekijöiden hallinnointia ja itsenäisen ammatinharjoittamisen aloittamista varten (esim. ansioluetteloiden lajitteluohjelmisto rekrytointia varten)

- Tietyt tekoälyn käyttötapaukset, joita käytetään keskeisten yksityisten ja julkisten palvelujen saatavuuteen (esim. luottopisteytys, joka estää kansalaisia saamasta lainaa)

- Tekoälyjärjestelmät, joita käytetään biometriseen etätunnistukseen, tunteiden tunnistamiseen ja biometriseen luokitteluun (esim. tekoälyjärjestelmä myymälävarkaan tunnistamiseksi takautuvasti)

- Tekoälyn käyttötapaukset lainvalvonnassa, jotka voivat vaikuttaa ihmisten perusoikeuksiin (esim. näytön luotettavuuden arviointi)

- Tekoälyn käyttötapaukset muuttoliikkeen, turvapaikka-asioiden ja rajavalvonnan hallinnassa (esim. viisumihakemusten automaattinen käsittely)

- Oikeudenkäytössä ja demokraattisissa prosesseissa käytettävät tekoälyratkaisut (esim. tekoälyratkaisut tuomioistuinten päätösten valmistelemiseksi)

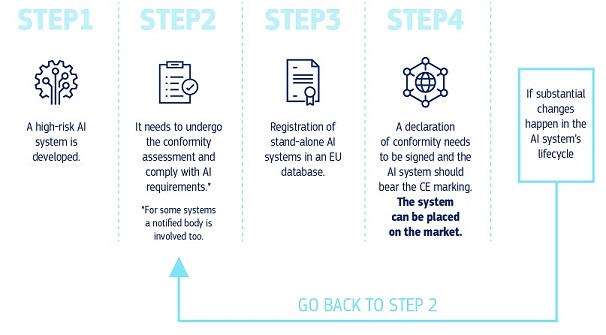

Suuririskisiin tekoälyjärjestelmiin sovelletaan tiukkoja velvoitteita ennen kuin ne voidaan saattaa markkinoille:

- riittävät riskinarviointi- ja riskienvähentämisjärjestelmät

- järjestelmään syötettävien tietoaineistojen korkea laatu syrjivien tulosten riskin minimoimiseksi

- toiminnan kirjaaminen tulosten jäljitettävyyden varmistamiseksi

- yksityiskohtaiset asiakirjat, joissa annetaan kaikki tarvittavat tiedot järjestelmästä ja sen tarkoituksesta, jotta viranomaiset voivat arvioida sen vaatimustenmukaisuutta

- selkeät ja riittävät tiedot käyttöönottajalle

- asianmukaiset ihmisen suorittamat valvontatoimenpiteet

- korkea luotettavuus, kyberturvallisuus ja tarkkuus

Suuririskistä tekoälyä koskevat säännöt tulevat voimaan elokuussa 2026 ja elokuussa 2027.

Avoimuusriski

Tällä tarkoitetaan riskejä, jotka liittyvät tekoälyn käytön läpinäkyvyyden tarpeeseen. Tekoälysäädöksessä otetaan käyttöön erityisiä julkistamisvelvoitteita, joilla varmistetaan, että ihmiset saavat tarvittaessa tietoa luottamuksen säilyttämiseksi. Esimerkiksi käytettäessä tekoälyjärjestelmiä, kuten chatbotteja, ihmisille olisi kerrottava, että he ovat vuorovaikutuksessa koneen kanssa, jotta he voivat tehdä tietoon perustuvan päätöksen.

Lisäksi generatiivisen tekoälyn tarjoajien on varmistettava, että tekoälyn tuottama sisältö on tunnistettavissa. Tämän lisäksi tietty tekoälyn tuottama sisältö olisi merkittävä selkeästi ja näkyvästi, erityisesti syväväärennökset ja teksti, joka julkaistaan yleisölle tiedottamiseksi yleistä etua koskevista asioista.

Tekoälysäädöksen avoimuussäännöt tulevat voimaan elokuussa 2026.

Minimaalinen riski tai ei riskiä

Tekoälysäädöksellä ei oteta käyttöön tekoälyä koskevia sääntöjä, joita pidetään vähäisinä tai riskittöminä. Valtaosa EU:ssa tällä hetkellä käytetyistä tekoälyjärjestelmistä kuuluu tähän luokkaan. Tämä sisältää sovelluksia, kuten tekoälyä hyödyntäviä videopelejä tai roskapostisuodattimia.

Miten kaikki toimii käytännössä suuririskisten tekoälyjärjestelmien tarjoajien kannalta?

Kun tekoälyjärjestelmä on markkinoilla, viranomaiset vastaavat markkinavalvonnasta, käyttöönottajat varmistavat ihmisen suorittaman valvonnan ja seurannan ja tarjoajilla on käytössä markkinoille saattamisen jälkeinen seurantajärjestelmä. Palveluntarjoajat ja käyttöönottajat ilmoittavat myös vakavista vaaratilanteista ja toimintahäiriöistä.

Mitkä ovat yleiskäyttöisten tekoälymallien säännöt?

Yleiskäyttöiset tekoälymallit voivat suorittaa monenlaisia tehtäviä, ja niistä on tulossa monien tekoälyjärjestelmien perusta EU:ssa. Joihinkin näistä malleista voi liittyä järjestelmäriskejä, jos ne ovat hyvin toimintakykyisiä tai niitä käytetään laajalti. Tekoälysäädöksessä vahvistetaan tällaisten mallien tarjoajia koskevat säännöt turvallisen ja luotettavan tekoälyn varmistamiseksi. Tähän sisältyvät avoimuus ja tekijänoikeuteen liittyvät säännöt. Sellaisten mallien osalta, joihin voi liittyä järjestelmäriskejä, tarjoajien olisi arvioitava ja lievennettävä näitä riskejä. GPAI:ta koskevat tekoälysäädöksen säännöt tulivat voimaan elokuussa 2025.

Vaatimusten noudattamisen tukeminen

Komissio julkaisi heinäkuussa 2025 kolme keskeistä välinettä, joilla tuetaan GPAI-mallien vastuullista kehittämistä ja käyttöönottoa:

- GPAI-mallien tarjoajien velvoitteiden soveltamisalaa koskevissa ohjeissa selvennetään tekoälysäädöksen mukaisten GPAI-velvoitteiden soveltamisalaa ja autetaan tekoälyn arvoketjun toimijoita ymmärtämään, kenen on noudatettava näitä velvoitteita.

- GPAI-käytännesäännöt ovat riippumattomien asiantuntijoiden komissiolle toimittama vapaaehtoinen vaatimustenmukaisuusväline, joka tarjoaa käytännön ohjeita, joiden avulla tarjoajat voivat noudattaa tekoälysäädöksen mukaisia velvoitteitaan, jotka liittyvät avoimuuteen, tekijänoikeuksiin sekä turvallisuuteen ja vahvistimiin.

- GPAI-mallien koulutussisältöä koskevan julkisen yhteenvedon mallissa edellytetään, että tarjoajat antavat yleiskuvan malliensa kouluttamisessa käytetyistä tiedoista. Mallissa pyydetään myös tietoja tietojenkäsittelyyn liittyvistä näkökohdista, jotta osapuolet, joilla on oikeutettuja etuja, voivat käyttää EU:n lainsäädännön mukaisia oikeuksiaan.

Nämä työkalut on suunniteltu toimimaan käsi kädessä. Yhdessä ne tarjoavat GPAI-mallien tarjoajille selkeän ja toteuttamiskelpoisen kehyksen tekoälysäädöksen noudattamiseksi, hallinnollisen taakan vähentämiseksi ja innovoinnin edistämiseksi samalla kun turvataan perusoikeudet ja kansalaisten luottamus.

Komissio kehittää myös muita välineitä, jotka tarjoavat ohjeita tekoälysäädöksen avoimuussääntöjen noudattamiseen:

- Tekoälytoimiston valitseman tekoälyn tuottaman sisällön merkintöjä koskevat käytännesäännöt. Käytännesäännöt ovat vapaaehtoinen väline, jonka avulla generatiivisten tekoälyjärjestelmien tarjoajia ja käyttöönottajia ohjataan noudattamaan avoimuusvelvoitteita. Näitä ovat muun muassa tekoälyn tuottaman sisällön merkitseminen ja kuvien, äänen (myös syväväärennösten) ja tekstin keinotekoisen luonteen paljastaminen.

- Läpinäkyviä tekoälyjärjestelmiä koskevat ohjeet, joissa selvennetään soveltamisalaa, asiaankuuluvia oikeudellisia määritelmiä, avoimuusvelvoitteita, poikkeuksia ja niihin liittyviä horisontaalisia kysymyksiä.

Näitä tukivälineitä valmistellaan parhaillaan, ja ne julkaistaan vuoden 2026 toisella neljänneksellä. Lue lisää siitä, miten tekoälytoimisto tukee tekoälysäädöksen täytäntöönpanoa.

Hallinto ja täytäntöönpano

Euroopan tekoälytoimisto ja jäsenvaltioiden viranomaiset vastaavat tekoälysäädöksen täytäntöönpanosta, valvonnasta ja noudattamisen valvonnasta. Tekoälylautakunta, tiedelautakunta ja neuvoa-antava ryhmä ohjaavat ja neuvovat tekoälysäädöksen hallintoa. Lisätietoja tekoälysäädöksen hallinnoinnista ja täytäntöönpanosta.

Hakuaika

Tekoälysäädös tuli voimaan 1. elokuuta 2024, ja sitä sovelletaan täysimääräisesti kaksi vuotta myöhemmin, 2. elokuuta 2026, joitakin poikkeuksia lukuun ottamatta:

- kielletyt tekoälykäytännöt ja tekoälylukutaitoa koskevat velvoitteet, joita alettiin soveltaa 2. helmikuuta 2025 alkaen

- GPAI-mallien hallintosääntöjä ja velvoitteita alettiin soveltaa 2. elokuuta 2025.

- Säänneltyihin tuotteisiin sisällytettyjä suuririskisiä tekoälyjärjestelmiä koskevilla säännöillä on pidennetty siirtymäkausi 2. elokuuta 2027 saakka.

Mikä on komission ehdotus tekoälysäädöksen täytäntöönpanon yksinkertaistamiseksi?

Yksinkertaistamista koskevassa digitaalipaketissa ehdotetaan muutoksia, joilla yksinkertaistetaan tekoälysäädöksen täytäntöönpanoa ja varmistetaan, että säännöt pysyvät selkeinä, yksinkertaisina ja innovointia edistävinä.

Komissio ehdottaa, että suuririskisten sääntöjen soveltamisaikataulua mukautetaan enintään 16 kuukauteen. Näin varmistetaan, että sääntöjä sovelletaan, kun yrityksillä on oikeat tukivälineet täytäntöönpanon helpottamiseksi, kuten standardit.

Komissio ehdottaa tekoälysäädökseen myös kohdennettuja muutoksia, joilla

- Vahvistetaan tekoälytoimiston valtuuksia ja keskitetään yleiskäyttöisiin tekoälymalleihin perustuvien tekoälyjärjestelmien valvonta, mikä vähentää hallinnon hajanaisuutta.

- laajennetaan tiettyjä pk-yrityksille ja eteläisen Välimeren maille myönnettyjä yksinkertaistuksia, mukaan lukien yksinkertaistettuja teknisiä asiakirjoja koskevat vaatimukset;

- edellytettävä, että komissio ja jäsenvaltiot edistävät tekoälylukutaitoa ja varmistavat jatkuvan tuen yrityksille hyödyntämällä nykyisiä toimia (kuten äskettäin uudistettua tekoälytoimiston tekoälylukutaitokäytäntöjen rekisteriä) ja säilyttämällä samalla suuririskisten käyttöönottajien koulutusvelvoitteet;

- Laajennetaan vaatimusten noudattamista tukevia toimenpiteitä, jotta useammat innovoijat voivat hyötyä sääntelyn testiympäristöistä, jotka perustetaan vuodesta 2028 alkaen, ja laajennetaan mahdollisuuksia tosielämän testaukseen.

- Mukautetaan tekoälysäädöksen menettelyjä, jotta voidaan selkeyttää sen vuorovaikutusta muiden lakien kanssa ja parantaa sen yleistä täytäntöönpanoa ja toimintaa.

Kaikki tämä täydentää toimia, joita komissio ja sen tekoälytoimisto jo toteuttavat selkeyttääkseen tilannetta yritysten ja kansallisten viranomaisten kannalta esimerkiksi ohjeiden, käytännesääntöjen ja tekoälysäädöksen palvelupisteen avulla.

Lainsäädäntöehdotus hyväksyttiin 19. marraskuuta. Euroopan parlamentti ja EU:n neuvosto keskustelevat ja neuvottelevat nyt tekoälyä koskevasta digitaalisesta koontiasetuksesta.

Viimeisimmät uutiset

Politiikka ja lainsäädäntö

- 05-03-2026Komissio julkaisee toisen luonnoksen tekoälyn tuottaman sisällön merkitsemistä ja merkintöjä koskeviksi käytännesäännöiksi

- 20-02-2026Johtajien julkilausuma tekoälyn vaikutuksia käsittelevässä huippukokouksessa Intiassa

- 21-01-2026Ehdotus asetukseksi digitaalisia verkkoja koskevasta säädöksestä

Raportti/Selvitys

- 07-04-2026Tekoäly sydän- ja verisuonihoidossa: lupauksesta käytäntöön

- 17-03-2026Study on Artificial Intelligence in healthcare dissects digital health technologies in Europe

- 01-12-2025Tutkimus – seuraava tietojen eturintama: generatiivinen tekoäly, sääntelyn noudattaminen ja kansainväliset ulottuvuudet

Tietokooste/Infografiikka

Aiheeseen liittyvää

Aiheesta laajemmin

Syventävää tietoa

-

Euroopan tekoälytoimisto ja kansalliset markkinavalvontaviranomaiset vastaavat tekoälysäädöksen...

-

Komissio pyrkii lisäämään tekoälyasiantuntijoiden määrää kouluttamalla ja houkuttelemalla lisää...

-

Yhdenmukaistetut standardit tarjoavat tekoälysäädöksen mukaista oikeusvarmuutta, tukevat innovointia...

-

Tekoälysäädös – Väärinkäytösten paljastajia koskeva väline antaa yksilöille mahdollisuuden toimittaa...