La legge sull'IA è il primo quadro giuridico in assoluto in materia di IA, che affronta i rischi dell'IA e posiziona l'Europa a svolgere un ruolo guida a livello mondiale.

Il regolamento sull'IA (regolamento (UE) 2024/1689 che stabilisce norme armonizzate sull'intelligenza artificiale) è il primo quadro giuridico completo in assoluto sull'IA a livello mondiale. L'obiettivo delle norme è promuovere un'IA affidabile in Europa. Per qualsiasi domanda sulla legge sull'IA, consultare la piattaforma informativa unica della legge sull'IA.

La legge sull'IA stabilisce norme basate sul rischio per gli sviluppatori e i deployer di IA per quanto riguarda gli usi specifici dell'IA. La legge sull'IA fa parte di un più ampio pacchetto di misure politiche a sostegno dello sviluppo di un'IA affidabile, che comprende anche il piano d'azione per il continente dell'IA, il pacchetto per l'innovazione nel settore dell'IA e il lancio delle fabbriche di IA. Insieme, queste misure garantiscono la sicurezza, i diritti fondamentali e l'IA antropocentrica e rafforzano la diffusione, gli investimenti e l'innovazione nell'IA in tutta l'UE.

Per agevolare la transizione verso il nuovo quadro normativo, la Commissione ha varato il patto per l'IA, un'iniziativa volontaria che mira a sostenere la futura attuazione, dialogare con i portatori di interessi e invitare i fornitori e gli operatori di IA provenienti dall'Europa e dal resto del mondo a rispettare in anticipo gli obblighi fondamentali della legge sull'IA. Parallelamente, il Service Desk della legge sull'IA fornisce anche informazioni e sostegno per un'attuazione agevole ed efficace della legge sull'IA in tutta l'UE.

Perché abbiamo bisogno di regole sull'IA?

La legge sull'IA garantisce che gli europei possano fidarsi di ciò che l'IA ha da offrire. Sebbene la maggior parte dei sistemi di IA non presenti rischi e possa contribuire a risolvere molte sfide per la società, alcuni sistemi di IA creano rischi che dobbiamo affrontare per evitare risultati indesiderati.

Ad esempio, spesso non è possibile scoprire perché un sistema di IA ha preso una decisione o una previsione e ha intrapreso una particolare azione. Pertanto, può diventare difficile valutare se qualcuno sia stato ingiustamente svantaggiato, ad esempio in una decisione di assunzione o in una domanda di un regime di pubblica utilità.

Sebbene la legislazione esistente offra una certa protezione, non è sufficiente per affrontare le sfide specifiche che i sistemi di IA possono comportare.

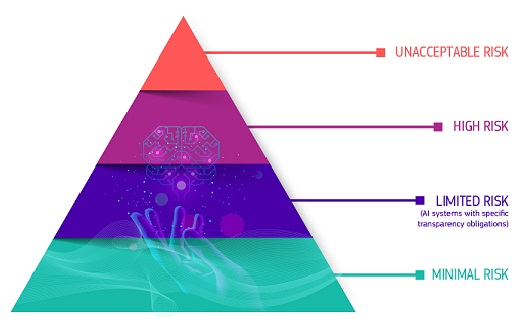

Un approccio basato sul rischio

La legge sull'IA definisce 4 livelli di rischio per i sistemi di IA:

Rischio inaccettabile

Tutti i sistemi di IA considerati una chiara minaccia per la sicurezza, i mezzi di sussistenza e i diritti delle persone sono vietati. La legge sull'IA vieta otto pratiche, vale a dire:

- manipolazione e inganno dannosi basati sull'IA

- sfruttamento dannoso delle vulnerabilità basato sull'IA

- punteggio sociale

- Valutazione o previsione del rischio di reato individuale

- raschiamento non mirato di materiale Internet o CCTV per creare o espandere banche dati di riconoscimento facciale

- riconoscimento delle emozioni nei luoghi di lavoro e negli istituti di istruzione

- categorizzazione biometrica per dedurre determinate caratteristiche protette

- identificazione biometrica remota in tempo reale a fini di contrasto in spazi accessibili al pubblico

I divieti sono entrati in vigore nel febbraio 2025. La Commissione ha pubblicato due documenti chiave a sostegno dell'applicazione pratica delle pratiche vietate:

- Gli orientamenti sulle pratiche di IA vietate ai sensi della legge sull'IA, che offrono spiegazioni giuridiche ed esempi pratici per aiutare i portatori di interessi a comprendere e rispettare i divieti.

- Gli orientamenti sulla definizione di sistema di IA della legge sull'IA, per aiutare i portatori di interessi a determinare l'ambito di applicazione della legge sull'IA

Rischio elevato

I casi d'uso dell'IA che possono comportare gravi rischi per la salute, la sicurezza o i diritti fondamentali sono classificati come ad alto rischio. Questi casi d'uso ad alto rischio includono:

- Componenti di sicurezza dell'IA nelle infrastrutture critiche (ad esempio i trasporti), il cui guasto potrebbe mettere a rischio la vita e la salute dei cittadini

- Soluzioni di IA utilizzate negli istituti di istruzione, che possono determinare l'accesso all'istruzione e al corso della vita professionale di qualcuno (ad esempio punteggio degli esami)

- Componenti di sicurezza dei prodotti basati sull'IA (ad esempio applicazione dell'IA nella chirurgia assistita da robot)

- Strumenti di IA per l'occupazione, la gestione dei lavoratori e l'accesso al lavoro autonomo (ad esempio software di selezione dei CV per le assunzioni)

- Alcuni casi d'uso dell'IA utilizzati per dare accesso a servizi pubblici e privati essenziali (ad esempio, punteggio di credito che nega ai cittadini la possibilità di ottenere un prestito)

- Sistemi di IA utilizzati per l'identificazione biometrica remota, il riconoscimento delle emozioni e la categorizzazione biometrica (ad esempio sistema di IA per identificare retroattivamente un taccheggiatore)

- Casi d'uso dell'IA nell'applicazione della legge che possono interferire con i diritti fondamentali delle persone (ad esempio valutazione dell'affidabilità delle prove)

- Casi d'uso dell'IA nella gestione della migrazione, dell'asilo e dei controlli alle frontiere (ad esempio esame automatizzato delle domande di visto)

- Soluzioni di IA utilizzate nell'amministrazione della giustizia e nei processi democratici (ad esempio soluzioni di IA per preparare le sentenze dei tribunali)

I sistemi di IA ad alto rischio sono soggetti a obblighi rigorosi prima di poter essere immessi sul mercato:

- adeguati sistemi di valutazione e attenuazione dei rischi

- elevata qualità delle serie di dati che alimentano il sistema per ridurre al minimo i rischi di esiti discriminatori

- registrazione delle attività per garantire la tracciabilità dei risultati

- documentazione dettagliata che fornisca tutte le informazioni necessarie sul sistema e sulla sua finalità per consentire alle autorità di valutarne la conformità

- informazioni chiare e adeguate al deployer

- adeguate misure di sorveglianza umana

- elevato livello di robustezza, sicurezza informatica e accuratezza

Le norme per l'IA ad alto rischio entreranno in vigore nell'agosto 2026 e nell'agosto 2027.

Rischio di trasparenza

Si tratta dei rischi associati alla necessità di trasparenza in merito all'uso dell'IA. La legge sull'IA introduce obblighi specifici di divulgazione per garantire che gli esseri umani siano informati quando necessario per preservare la fiducia. Ad esempio, quando si utilizzano sistemi di IA come i chatbot, gli esseri umani dovrebbero essere consapevoli del fatto che interagiscono con una macchina in modo da poter prendere una decisione informata.

Inoltre, i fornitori di IA generativa devono garantire che i contenuti generati dall'IA siano identificabili. Inoltre, alcuni contenuti generati dall'IA dovrebbero essere etichettati in modo chiaro e visibile, vale a dire deep fake e testi pubblicati allo scopo di informare il pubblico su questioni di interesse pubblico.

Le norme sulla trasparenza della legge sull'IA entreranno in vigore nell'agosto 2026.

Rischio minimo o nullo

La legge sull'IA non introduce norme per l'IA ritenute a rischio minimo o nullo. La stragrande maggioranza dei sistemi di IA attualmente utilizzati nell'UE rientra in questa categoria. Ciò include applicazioni come videogiochi abilitati all'intelligenza artificiale o filtri antispam.

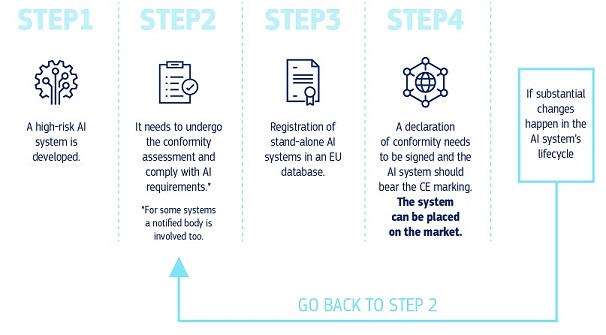

Come funziona nella pratica per i fornitori di sistemi di IA ad alto rischio?

Una volta che un sistema di IA è sul mercato, le autorità sono responsabili della vigilanza del mercato, gli operatori garantiscono la sorveglianza e il monitoraggio umani e i fornitori dispongono di un sistema di monitoraggio post-commercializzazione. I fornitori e gli operatori segnaleranno anche incidenti gravi e malfunzionamenti.

Quali sono le regole per i modelli di IA per finalità generali?

I modelli di IA per finalità generali (GPAI) possono svolgere un'ampia gamma di compiti e stanno diventando la base di molti sistemi di IA nell'UE. Alcuni di questi modelli potrebbero comportare rischi sistemici se sono molto capaci o ampiamente utilizzati. Per garantire un'IA sicura e affidabile, la legge sull'IA stabilisce norme per i fornitori di tali modelli. Ciò include la trasparenza e le norme relative al diritto d'autore. Per i modelli che possono comportare rischi sistemici, i fornitori dovrebbero valutare e attenuare tali rischi. Le norme della legge sull'IA in materia di GPAI sono entrate in vigore nell'agosto 2025.

Sostenere la conformità

Nel luglio 2025 la Commissione ha pubblicato tre strumenti chiave per sostenere lo sviluppo e la diffusione responsabili dei modelli GPAI:

- Gli orientamenti sulla portata degli obblighi per i fornitori di modelli GPAI chiariscono la portata degli obblighi GPAI ai sensi della legge sull'IA, aiutando gli attori lungo la catena del valore dell'IA a capire chi deve rispettare tali obblighi.

- Il codice di buone pratiche GPAI è uno strumento volontario di conformità presentato alla Commissione da esperti indipendenti, che offre orientamenti pratici per aiutare i fornitori a rispettare i loro obblighi ai sensi della legge sull'IA in materia di trasparenza, diritto d'autore e sicurezza.

- Il modello per la sintesi pubblica dei contenuti formativi dei modelli GPAI impone ai fornitori di fornire una panoramica dei dati utilizzati per addestrare i loro modelli. Ciò include le fonti da cui sono stati ottenuti i dati (comprendenti grandi serie di dati e nomi di dominio principali). Il modello richiede anche informazioni sugli aspetti del trattamento dei dati per consentire alle parti con interessi legittimi di esercitare i loro diritti ai sensi del diritto dell'UE.

Questi strumenti sono progettati per lavorare mano nella mano. Insieme, forniscono un quadro chiaro e attuabile affinché i fornitori di modelli GPAI rispettino la legge sull'IA, riducano gli oneri amministrativi e promuovano l'innovazione salvaguardando nel contempo i diritti fondamentali e la fiducia del pubblico.

La Commissione sta inoltre sviluppando altri strumenti di sostegno che offrono orientamenti su come rispettare le norme in materia di trasparenza della legge sull'IA:

- Codice di buone pratiche sulla marcatura e l'etichettatura dei contenuti generati dall'IA selezionati dall'Ufficio per l'IA. Il codice sarà uno strumento volontario per guidare i fornitori e gli operatori di sistemi di IA generativa a rispettare gli obblighi di trasparenza. Questi includono la marcatura dei contenuti generati dall'IA e la divulgazione della natura artificiale delle immagini e dell'audio (compresi i deepfake) e del testo.

- Gli orientamenti sui sistemi di IA trasparenti per chiarire l'ambito di applicazione, le pertinenti definizioni giuridiche, gli obblighi di trasparenza, le eccezioni e le relative questioni orizzontali.

Questi strumenti di sostegno sono in fase di preparazione e saranno pubblicati nel secondo trimestre del 2026. Per saperne di più su come l'Ufficio per l'IA sostiene l'attuazione della legge sull'IA.

Governance e attuazione

L'Ufficio europeo per l'IA e le autorità degli Stati membri sono responsabili dell'attuazione, della supervisione e dell'applicazione della legge sull'IA. Il comitato per l'IA, il gruppo di esperti scientifici e il forum consultivo guidano e consigliano la governance della legge sull'IA. Per saperne di più sulla governance e l'applicazione della legge sull'IA.

Calendario delle candidature

La legge sull'IA è entrata in vigore il 1o agosto 2024 e sarà pienamente applicabile due anni dopo, il 2 agosto 2026, con alcune eccezioni:

- pratiche di IA vietate e obblighi di alfabetizzazione in materia di IA entrati in vigore il 2 febbraio 2025

- le norme di governance e gli obblighi per i modelli GPAI sono divenuti applicabili il 2 agosto 2025

- le norme per i sistemi di IA ad alto rischio - integrati in prodotti regolamentati - hanno un periodo di transizione prorogato fino al 2 agosto 2027

Qual è la proposta della Commissione di semplificare l'attuazione della legge sull'IA?

Il pacchetto digitale sulla semplificazione propone modifiche per semplificare l'attuazione della legge sull'IA e garantire che le norme rimangano chiare, semplici e favorevoli all'innovazione.

La Commissione propone di adeguare il calendario per l'applicazione delle norme ad alto rischio a un massimo di 16 mesi. Ciò garantisce che le norme si applichino quando le imprese dispongono dei giusti strumenti di supporto per facilitare l'attuazione, come le norme.

La Commissione propone inoltre modifiche mirate alla legge sull'IA che:

- rafforzare i poteri dell'Ufficio per l'IA e centralizzare la sorveglianza dei sistemi di IA basati su modelli di IA per finalità generali, riducendo la frammentazione della governance;

- estendere alcune semplificazioni concesse alle PMI e agli SMC, compresi i requisiti semplificati in materia di documentazione tecnica;

- chiedere alla Commissione e agli Stati membri di promuovere l'alfabetizzazione in materia di IA e di garantire un sostegno continuo alle imprese basandosi sugli sforzi esistenti (come il repertorio delle pratiche di alfabetizzazione in materia di IA dell'Ufficio per l'IA, recentemente rinnovato), mantenendo nel contempo in vigore gli obblighi di formazione per i deployer ad alto rischio;

- ampliare le misure a sostegno della conformità in modo che un maggior numero di innovatori possa beneficiare degli spazi di sperimentazione normativa che saranno istituiti a partire dal 2028 e ampliando le possibilità di sperimentazione nel mondo reale;

- Adeguare le procedure della legge sull'IA per chiarirne l'interazione con altre leggi e migliorarne l'attuazione e il funzionamento generali.

Tutto ciò integra le azioni che la Commissione e il suo ufficio per l'IA stanno già intraprendendo per fornire chiarezza alle imprese e alle autorità nazionali, ad esempio attraverso orientamenti, codici di condotta e lo sportello per i servizi di legge sull'IA.

La proposta legislativa è stata adottata il 19 novembre. Il Parlamento europeo e il Consiglio dell'UE stanno ora discutendo e negoziando l'omnibus digitale sull'IA.

Ultime notizie

Politiche e legislazione

- 05-03-2026La Commissione pubblica il secondo progetto di codice di buone pratiche sulla marcatura e l'etichettatura dei contenuti generati dall'IA

- 20-02-2026Dichiarazione dei leader al vertice sull'impatto dell'IA in India

- 21-01-2026Proposta di regolamento relativo alla legge sulle reti digitali (DNA)

Relazione / studio

- 07-04-2026Intelligenza artificiale nella cura cardiovascolare: dalla promessa alla pratica

- 17-03-2026Study on Artificial Intelligence in healthcare dissects digital health technologies in Europe

- 01-12-2025Studio - la prossima frontiera dei dati: IA generativa, conformità normativa e dimensioni internazionali

Scheda informativa / Infografica

Contenuti correlati

Quadro generale

Per ulteriori approfondimenti

-

L'Ufficio europeo per l'IA e le autorità nazionali di vigilanza del mercato sono responsabili dell...

-

La Commissione mira ad aumentare il numero di esperti di IA formando e attirando un maggior numero...

-

Le norme armonizzate offriranno certezza giuridica ai sensi della legge sull'IA, sosterranno l...

-

Lo strumento per gli informatori della legge sull'IA consente alle persone di presentare una...