Forordningen om kunstig intelligens er den første retlige ramme for kunstig intelligens nogensinde, som imødegår risiciene ved kunstig intelligens og sætter Europa i stand til at spille en førende rolle på globalt plan.

Forordningen om kunstig intelligens (forordning (EU) 2024/1689 om harmoniserede regler for kunstig intelligens) er den første omfattende retlige ramme for kunstig intelligens nogensinde på verdensplan. Formålet med reglerne er at fremme pålidelig kunstig intelligens i Europa. Hvis du har spørgsmål om retsakten om kunstig intelligens, kan du tjekke den fælles informationsplatform om retsakten om kunstig intelligens.

Forordningen om kunstig intelligens fastsætter risikobaserede regler for udviklere og udbredere af kunstig intelligens vedrørende specifikke anvendelser af kunstig intelligens. Forordningen om kunstig intelligens er en del af en bredere pakke af politiske foranstaltninger til støtte for udviklingen af pålidelig kunstig intelligens, som også omfatter handlingsplanen for AI-kontinentet, AI-innovationspakken og lanceringen af AI-fabrikker. Tilsammen garanterer disse foranstaltninger sikkerhed, grundlæggende rettigheder og menneskecentreret kunstig intelligens og styrker udbredelsen, investeringerne og innovationen inden for kunstig intelligens i hele EU.

For at lette overgangen til den nye lovgivningsmæssige ramme har Kommissionen lanceret AI-pagten, et frivilligt initiativ, der har til formål at støtte den fremtidige gennemførelse, samarbejde med interessenter og opfordre AI-udbydere og -idriftsættere fra og uden for Europa til at overholde de centrale forpligtelser i forordningen om kunstig intelligens på forhånd. Sideløbende hermed leverer servicedesken for forordningen om kunstig intelligens også oplysninger og støtte til en gnidningsløs og effektiv gennemførelse af forordningen om kunstig intelligens i hele EU.

Hvorfor har vi brug for regler om kunstig intelligens?

Forordningen om kunstig intelligens sikrer, at europæerne kan stole på, hvad kunstig intelligens har at tilbyde. Selv om de fleste AI-systemer udgør en begrænset risiko og kan bidrage til at løse mange samfundsmæssige udfordringer, skaber visse AI-systemer risici, som vi skal imødegå for at undgå uønskede resultater.

Det er f.eks. ofte ikke muligt at finde ud af, hvorfor et AI-system har truffet en beslutning eller forudsigelse og truffet en bestemt foranstaltning. Det kan derfor blive vanskeligt at vurdere, om en person er blevet uretfærdigt stillet, f.eks. i en ansættelsesafgørelse eller i en ansøgning om en offentlig ydelsesordning.

Selv om den eksisterende lovgivning yder en vis beskyttelse, er den ikke tilstrækkelig til at tackle de specifikke udfordringer, som AI-systemer kan medføre.

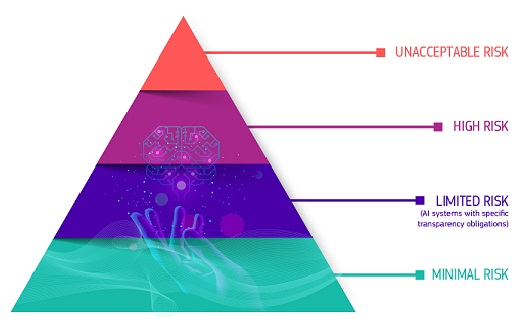

En risikobaseret tilgang

AI-forordningen definerer fire risikoniveauer for AI-systemer:

Uacceptabel risiko

Alle AI-systemer, der betragtes som en klar trussel mod menneskers sikkerhed, levebrød og rettigheder, er forbudt. AI-forordningen forbyder otte praksisser, nemlig:

- skadelig AI-baseret manipulation og bedrag

- skadelig AI-baseret udnyttelse af sårbarheder

- sociale scoringer

- Risikovurdering eller -forudsigelse vedrørende individuelle strafbare handlinger

- ikkemålrettet skrabning af internet- eller CCTV-materiale for at oprette eller udvide databaser til ansigtsgenkendelse

- følelsesgenkendelse på arbejdspladser og uddannelsesinstitutioner

- biometrisk kategorisering med henblik på at udlede visse beskyttede egenskaber

- biometrisk fjernidentifikation i realtid med henblik på retshåndhævelse på offentlige steder

Forbuddene trådte i kraft i februar 2025. Kommissionen offentliggjorde to centrale dokumenter til støtte for den praktiske anvendelse af den forbudte praksis:

- Retningslinjerne for forbudt AI-praksis i henhold til forordningen om kunstig intelligens, som indeholder juridiske forklaringer og praktiske eksempler for at hjælpe interessenterne med at forstå og overholde forbuddene.

- Retningslinjerne for definitionen af AI-systemer i forordningen om kunstig intelligens med henblik på at bistå interessenter med at fastlægge anvendelsesområdet for forordningen om kunstig intelligens

Høj risiko

AI-anvendelsestilfælde, der kan udgøre alvorlige risici for sundhed, sikkerhed eller grundlæggende rettigheder, klassificeres som højrisikotilfælde. Disse højrisikobrugstilfælde omfatter:

- AI-sikkerhedskomponenter i kritisk infrastruktur (f.eks. transport), hvis svigt kan bringe borgernes liv og sundhed i fare

- AI-løsninger, der anvendes på uddannelsesinstitutioner, og som kan være afgørende for adgangen til uddannelse og forløbet af en persons arbejdsliv (f.eks. bedømmelse af eksamener)

- AI-baserede sikkerhedskomponenter i produkter (f.eks. AI-anvendelse i robotassisteret kirurgi)

- AI-værktøjer til beskæftigelse, forvaltning af arbejdstagere og adgang til selvstændig erhvervsvirksomhed (f.eks. CV-sorteringssoftware til rekruttering)

- Visse tilfælde af anvendelse af kunstig intelligens, der anvendes til at give adgang til væsentlige private og offentlige tjenester (f.eks. kreditvurdering, der nægter borgerne mulighed for at opnå et lån)

- AI-systemer, der anvendes til biometrisk fjernidentifikation, følelsesgenkendelse og biometrisk kategorisering (f.eks. AI-system til at identificere en butikstyv med tilbagevirkende kraft)

- AI-anvendelsestilfælde inden for retshåndhævelse, der kan gribe ind i menneskers grundlæggende rettigheder (f.eks. evaluering af bevisernes pålidelighed)

- AI-anvendelsestilfælde inden for migrations-, asyl- og grænsekontrolforvaltning (f.eks. automatiseret behandling af visumansøgninger)

- AI-løsninger, der anvendes i retsplejen og de demokratiske processer (f.eks. AI-løsninger til udarbejdelse af retsafgørelser)

Højrisiko-AI-systemer er underlagt strenge forpligtelser, inden de kan bringes i omsætning:

- passende risikovurderings- og risikobegrænsningssystemer

- høj kvalitet af de datasæt, der anvendes i systemet, for at minimere risikoen for diskriminerende resultater

- logning af aktiviteter for at sikre sporbarhed af resultater

- detaljeret dokumentation med alle nødvendige oplysninger om systemet og dets formål, så myndighederne kan vurdere dets overholdelse

- klare og tilstrækkelige oplysninger til udbrederen

- passende foranstaltninger til menneskeligt tilsyn

- høj grad af robusthed, cybersikkerhed og nøjagtighed

Reglerne for højrisiko-AI træder i kraft i august 2026 og august 2027.

Gennemsigtighedsrisiko

Dette henviser til de risici, der er forbundet med behovet for gennemsigtighed i forbindelse med anvendelsen af kunstig intelligens. AI-forordningen indfører specifikke oplysningsforpligtelser for at sikre, at mennesker informeres, når det er nødvendigt for at bevare tilliden. Når mennesker f.eks. anvender AI-systemer såsom chatbots, bør de gøres opmærksomme på, at de interagerer med en maskine, så de kan træffe en informeret beslutning.

Desuden skal udbydere af generativ kunstig intelligens sikre, at AI-genereret indhold kan identificeres. Derudover bør visse former for AI-genereret indhold mærkes klart og synligt, nemlig deepfakes og tekst, der offentliggøres med det formål at informere offentligheden om spørgsmål af offentlig interesse.

Gennemsigtighedsreglerne i forordningen om kunstig intelligens træder i kraft i august 2026.

Minimal eller ingen risiko

Forordningen om kunstig intelligens indfører ikke regler for kunstig intelligens, der anses for at være minimale eller ingen risici. Langt størstedelen af de AI-systemer, der i øjeblikket anvendes i EU, falder ind under denne kategori. Dette omfatter applikationer som AI-aktiverede videospil eller spamfiltre.

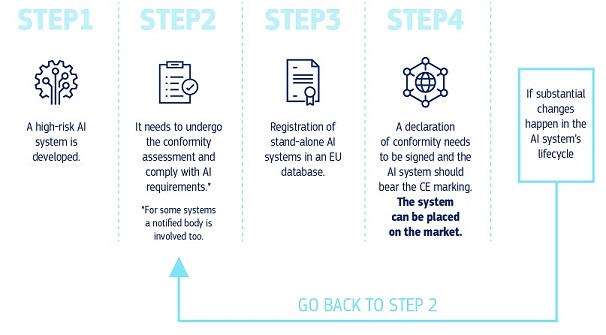

Hvordan fungerer det i praksis for udbydere af højrisiko-AI-systemer?

Når et AI-system er på markedet, er myndighederne ansvarlige for markedsovervågning, udbrederne sikrer menneskeligt tilsyn og overvågning, og udbyderne har indført et system til overvågning, efter at udstyret er bragt i omsætning. Udbydere og udbredere vil også indberette alvorlige hændelser og funktionsfejl.

Hvad er reglerne for AI-modeller til generelle formål?

AI-modeller til almen brug kan udføre en lang række opgaver og er ved at blive grundlaget for mange AI-systemer i EU. Nogle af disse modeller kan indebære systemiske risici, hvis de er meget anvendelige eller anvendes i vid udstrækning. For at sikre sikker og pålidelig kunstig intelligens indfører forordningen om kunstig intelligens regler for udbydere af sådanne modeller. Dette omfatter gennemsigtighed og ophavsretsrelaterede regler. For modeller, der kan indebære systemiske risici, bør udbyderne vurdere og afbøde disse risici. AI-lovens regler om GPAI trådte i kraft i august 2025.

Støtte til overholdelse

I juli 2025 offentliggjorde Kommissionen tre centrale instrumenter til støtte for ansvarlig udvikling og udbredelse af GPAI-modeller:

- Retningslinjerne for anvendelsesområdet for forpligtelserne for udbydere af GPAI-modeller præciserer anvendelsesområdet for GPAI-forpligtelserne i henhold til AI-forordningen og hjælper aktører i AI-værdikæden med at forstå, hvem der skal overholde disse forpligtelser.

- GPAI-adfærdskodeksen er et frivilligt overholdelsesværktøj, der forelægges Kommissionen af uafhængige eksperter, og som giver praktisk vejledning for at hjælpe udbydere med at opfylde deres forpligtelser i henhold til AI-forordningen vedrørende gennemsigtighed, ophavsret og sikkerhed.

- Skabelonen til den offentlige sammenfatning af uddannelsesindholdet i GPAI-modeller kræver, at udbyderne giver et overblik over de data, der anvendes til at træne deres modeller. Dette omfatter de kilder, hvorfra dataene blev indhentet (bestående af store datasæt og topdomænenavne). Skabelonen anmoder også om oplysninger om databehandlingsaspekter for at gøre det muligt for parter med legitime interesser at udøve deres rettigheder i henhold til EU-retten.

Disse værktøjer er designet til at arbejde hånd i hånd. Sammen udgør de en klar og handlingsrettet ramme for udbydere af GPAI-modeller med henblik på at overholde AI-forordningen, mindske den administrative byrde og fremme innovation, samtidig med at de grundlæggende rettigheder og offentlighedens tillid beskyttes.

Kommissionen er også i færd med at udvikle støtte til andre værktøjer, der giver vejledning i, hvordan man overholder gennemsigtighedsreglerne i forordningen om kunstig intelligens:

- Adfærdskodeksen for mærkning og etikettering af AI-genereret indhold udvalgt af AI-kontoret. Kodeksen vil være et frivilligt redskab til at vejlede udbydere og udbredere af generative AI-systemer i at overholde gennemsigtighedsforpligtelserne. Disse omfatter mærkning af AI-genereret indhold og offentliggørelse af billeders kunstige karakter og lyd (herunder deepfakes) samt tekst.

- Retningslinjerne for gennemsigtige AI-systemer med henblik på at præcisere anvendelsesområdet, relevante retlige definitioner, gennemsigtighedsforpligtelserne, undtagelserne og relaterede horisontale spørgsmål.

Disse støtteinstrumenter er under udarbejdelse og vil blive offentliggjort i andet kvartal af 2026. Læs mere om, hvordan AI-kontoret støtter gennemførelsen af AI-forordningen.

Forvaltning og gennemførelse

Det Europæiske Kontor for Kunstig Intelligens og medlemsstaternes myndigheder er ansvarlige for at gennemføre, føre tilsyn med og håndhæve forordningen om kunstig intelligens. AI-udvalget, ekspertpanelet og det rådgivende forum styrer og rådgiver om forvaltningen af AI-forordningen. Læs mere om forvaltning og håndhævelse af forordningen om kunstig intelligens.

Tidsplan for ansøgning

AI-forordningen trådte i kraft den 1. august 2024 og finder fuld anvendelse to år senere den 2. august 2026 med visse undtagelser:

- forbudt AI-praksis og forpligtelser vedrørende AI-færdigheder, der trådte i kraft den 2. februar 2025

- Forvaltningsreglerne og forpligtelserne for GPAI-modeller trådte i kraft den 2. august 2025.

- reglerne for højrisiko-AI-systemer — indlejret i regulerede produkter — har en forlænget overgangsperiode indtil den 2. august 2027

Hvad er Kommissionens forslag om at forenkle gennemførelsen af forordningen om kunstig intelligens?

I den digitale pakke om forenkling foreslås der ændringer for at forenkle gennemførelsen af forordningen om kunstig intelligens og sikre, at reglerne forbliver klare, enkle og innovationsvenlige.

Kommissionen foreslår at tilpasse tidsplanen for anvendelsen af højrisikoregler til højst 16 måneder. Dette sikrer, at reglerne finder anvendelse, når virksomhederne har de rette støtteværktøjer til at lette gennemførelsen, f.eks. standarder.

Kommissionen foreslår også målrettede ændringer af forordningen om kunstig intelligens, som vil:

- styrke AI-kontorets beføjelser og centralisere tilsynet med AI-systemer, der bygger på AI-modeller til almen brug, hvilket mindsker fragmenteringen af forvaltningen

- udvide visse forenklinger, der indrømmes SMV'er og SMC'er, herunder forenklede krav til teknisk dokumentation

- kræve, at Kommissionen og medlemsstaterne fremmer AI-færdigheder og sikrer løbende støtte til virksomheder ved at bygge videre på eksisterende bestræbelser (f.eks. AI-kontorets register over AI-færdigheder, der for nylig er blevet moderniseret), samtidig med at uddannelsesforpligtelserne for højrisikoidriftsættere opretholdes;

- udvide foranstaltningerne til støtte for overholdelse, så flere innovatorer kan drage fordel af reguleringsmæssige sandkasser, der vil blive oprettet fra 2028, og ved at udvide mulighederne for prøvning i den virkelige verden

- Tilpasse AI-forordningens procedurer for at præcisere dens samspil med andre love og forbedre dens overordnede gennemførelse og drift.

Alt dette supplerer de foranstaltninger, som Kommissionen og dens AI-kontor allerede træffer for at skabe klarhed for virksomheder og nationale myndigheder, f.eks. gennem retningslinjer, adfærdskodekser og AI Act Service Desk.

Lovgivningsforslaget blev vedtaget den 19. november. Europa-Parlamentet og Rådet for Den Europæiske Union drøfter og forhandler nu om den digitale omnibus om kunstig intelligens.

Seneste nyheder

Politik og lovgivning

Rapport/undersøgelse

- 07-04-2026Kunstig intelligens i hjerte-kar-pleje: fra løfte til praksis

- 17-03-2026Study on Artificial Intelligence in healthcare dissects digital health technologies in Europe

- 01-12-2025Undersøgelse – den næste datagrænse: generativ kunstig intelligens, overholdelse af lovgivningen og internationale dimensioner

Faktablad/infografik

Se også

Det store billede

Grav dybere

-

Det Europæiske Kontor for Kunstig Intelligens og de nationale markedsovervågningsmyndigheder er...

-

Kommissionen sigter mod at øge antallet af AI-eksperter ved at uddanne og tiltrække flere forskere...

-

Harmoniserede standarder vil give retssikkerhed i henhold til forordningen om kunstig intelligens...

-

Whistleblowerværktøjet til forordningen om kunstig intelligens giver enkeltpersoner mulighed for på...