La législation sur l’IA est le tout premier cadre juridique en matière d’IA, qui traite des risques liés à l’IA et positionne l’Europe comme un acteur de premier plan au niveau mondial.

Le règlement sur l’IA [règlement (UE) 2024/1689 établissant des règles harmonisées sur l’intelligence artificielle] est le tout premier cadre juridique complet en matière d’IA au monde. L’objectif des règles est de favoriser une IA digne de confiance en Europe. Pour toute question sur la législation sur l’IA, consultez la plateforme d’information unique sur la législation sur l’IA.

La législation sur l’IA établit des règles fondées sur les risques pour les développeurs et les déployeurs d’IA en ce qui concerne les utilisations spécifiques de l’IA. La législation sur l’IA fait partie d’un ensemble plus large de mesures visant à soutenir le développement d’une IA digne de confiance, qui comprend également le plan d’action pour le continent de l’IA, le train de mesures sur l’innovation dans le domaine de l’IA et le lancement d’usines d’IA. Ensemble, ces mesures garantissent la sécurité, les droits fondamentaux et une IA centrée sur l’homme, et renforcent l’adoption, l’investissement et l’innovation dans l’IA dans l’ensemble de l’UE.

Afin de faciliter la transition vers le nouveau cadre réglementaire, la Commission a lancé le pacte sur l’IA, une initiative volontaire qui vise à soutenir la mise en œuvre future, à dialoguer avec les parties prenantes et à inviter les fournisseurs et les déployeurs d’IA d’Europe et d’ailleurs à se conformer à l’avance aux principales obligations de la législation sur l’IA. Parallèlement, le Service Desk de la législation sur l’IA fournit également des informations et un soutien en vue d’une mise en œuvre harmonieuse et efficace de la législation sur l’IA dans l’ensemble de l’UE.

Pourquoi avons-nous besoin de règles sur l’IA?

La législation sur l’IA garantit que les Européens peuvent faire confiance à ce que l’IA a à offrir. Alors que la plupart des systèmes d’IA ne présentent aucun risque et peuvent contribuer à résoudre de nombreux défis sociétaux, certains systèmes d’IA créent des risques auxquels nous devons faire face pour éviter des résultats indésirables.

Par exemple, il est souvent impossible de savoir pourquoi un système d'IA a pris une décision ou une prédiction et pris une action particulière. Il peut donc devenir difficile d’évaluer si une personne a été injustement désavantagée, par exemple dans une décision d’embauche ou dans une demande de régime d’intérêt public.

Bien que la législation existante offre une certaine protection, elle est insuffisante pour relever les défis spécifiques que les systèmes d’IA peuvent poser.

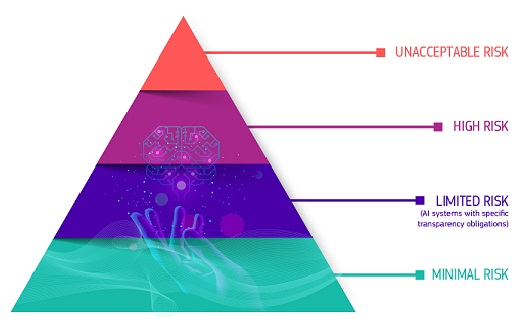

Une approche fondée sur les risques

La législation sur l’IA définit quatre niveaux de risque pour les systèmes d’IA:

Risque inacceptable

Tous les systèmes d’IA considérés comme une menace manifeste pour la sécurité, les moyens de subsistance et les droits des personnes sont interdits. La législation sur l’IA interdit huit pratiques, à savoir:

- manipulation et tromperie préjudiciables fondées sur l’IA

- exploitation nocive des vulnérabilités fondée sur l’IA

- notation sociale

- Évaluation ou prévision des risques d’infraction pénale individuelle

- grattage non ciblé de matériel internet ou CCTV pour créer ou développer des bases de données de reconnaissance faciale

- la reconnaissance des émotions sur les lieux de travail et dans les établissements d’enseignement;

- catégorisation biométrique pour déduire certaines caractéristiques protégées

- identification biométrique à distance en temps réel à des fins répressives dans des espaces accessibles au public

Les interdictions sont entrées en vigueur en février 2025. La Commission a publié deux documents clés à l’appui de l’application pratique des pratiques interdites:

- les lignes directrices sur les pratiques d’IA interdites au titre de la législation sur l’IA, qui fournissent des explications juridiques et des exemples pratiques pour aider les parties prenantes à comprendre les interdictions et à s’y conformer.

- Lignes directrices sur la définition du système d’IA de la législation sur l’IA, afin d’aider les parties prenantes à déterminer le champ d’application de la législation sur l’IA

Risque élevé

Les cas d’utilisation de l’IA qui peuvent présenter des risques graves pour la santé, la sécurité ou les droits fondamentaux sont classés comme étant à haut risque. Ces cas d'utilisation à haut risque comprennent:

- Composants de sécurité de l’IA dans les infrastructures critiques (par exemple, les transports), dont la défaillance pourrait mettre en danger la vie et la santé des citoyens

- Solutions d’IA utilisées dans les établissements d’enseignement, qui peuvent déterminer l’accès à l’éducation et le cours de la vie professionnelle d’une personne (par exemple, la notation des examens)

- Composants de sécurité des produits basés sur l’IA (par exemple, application de l’IA en chirurgie assistée par robot)

- Outils d’IA pour l’emploi, la gestion des travailleurs et l’accès au travail indépendant (par exemple, logiciels de tri de CV pour le recrutement)

- Certains cas d’utilisation de l’IA utilisés pour donner accès à des services privés et publics essentiels (par exemple, notation de crédit empêchant les citoyens d’obtenir un prêt)

- Systèmes d’IA utilisés pour l’identification biométrique à distance, la reconnaissance des émotions et la catégorisation biométrique (par exemple, système d’IA permettant d’identifier rétroactivement un voleur à l’étalage)

- Cas d’utilisation de l’IA dans les services répressifs susceptibles d’interférer avec les droits fondamentaux des personnes (par exemple, évaluation de la fiabilité des éléments de preuve)

- Cas d’utilisation de l’IA dans la gestion des migrations, de l’asile et des contrôles aux frontières (par exemple, examen automatisé des demandes de visa)

- Solutions d’IA utilisées dans l’administration de la justice et les processus démocratiques (par exemple, solutions d’IA pour préparer les décisions de justice)

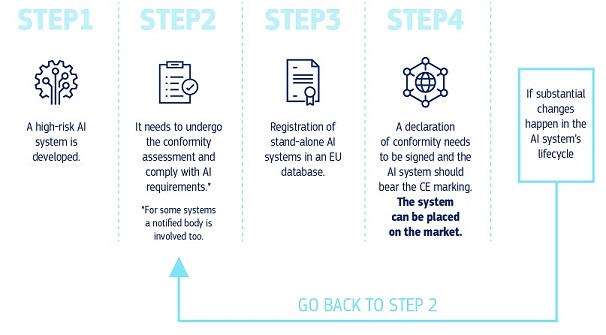

Les systèmes d’IA à haut risque sont soumis à des obligations strictes avant de pouvoir être mis sur le marché:

- des systèmes adéquats d'évaluation et d'atténuation des risques

- haute qualité des ensembles de données alimentant le système afin de réduire au minimum les risques de résultats discriminatoires

- journalisation de l'activité pour assurer la traçabilité des résultats

- une documentation détaillée fournissant toutes les informations nécessaires sur le système et son objectif pour permettre aux autorités d’évaluer sa conformité;

- des informations claires et adéquates à l’intention du déployeur;

- mesures de surveillance humaine appropriées

- niveau élevé de robustesse, de cybersécurité et de précision

Les règles relatives à l’IA à haut risque entreront en vigueur en août 2026 et en août 2027.

Risque de transparence

Il s’agit des risques associés à un besoin de transparence concernant l’utilisation de l’IA. La législation sur l’IA introduit des obligations de divulgation spécifiques afin de veiller à ce que les êtres humains soient informés lorsque cela est nécessaire pour préserver la confiance. Par exemple, lors de l’utilisation de systèmes d’IA tels que les chatbots, les humains devraient être informés qu’ils interagissent avec une machine afin de pouvoir prendre une décision en connaissance de cause.

En outre, les fournisseurs d’IA générative doivent veiller à ce que les contenus générés par l’IA soient identifiables. En outre, certains contenus générés par l’IA devraient être étiquetés de manière claire et visible, à savoir les faux profonds et les textes publiés dans le but d’informer le public sur des questions d’intérêt public.

Les règles de transparence de la législation sur l’IA entreront en vigueur en août 2026.

Risque minimal ou nul

La législation sur l’IA n’introduit pas de règles pour l’IA qui est considérée comme présentant un risque minimal ou nul. La grande majorité des systèmes d’IA actuellement utilisés dans l’UE relèvent de cette catégorie. Cela inclut des applications telles que les jeux vidéo compatibles avec l'IA ou les filtres anti-spam.

Comment tout cela fonctionne-t-il dans la pratique pour les fournisseurs de systèmes d’IA à haut risque?

Une fois qu’un système d’IA est sur le marché, les autorités sont chargées de la surveillance du marché, les déployeurs assurent la surveillance et le suivi humains, et les fournisseurs disposent d’un système de surveillance après commercialisation. Les fournisseurs et les déployeurs signaleront également les incidents graves et les dysfonctionnements.

Quelles sont les règles pour les modèles d'IA à usage général?

Les modèles d’IA à usage général (GPAI) peuvent accomplir un large éventail de tâches et deviennent la base de nombreux systèmes d’IA dans l’UE. Certains de ces modèles pourraient comporter des risques systémiques s'ils sont très performants ou largement utilisés. Afin de garantir une IA sûre et digne de confiance, la législation sur l’IA met en place des règles pour les fournisseurs de ces modèles. Cela inclut la transparence et les règles relatives au droit d'auteur. Pour les modèles qui peuvent comporter des risques systémiques, les fournisseurs devraient évaluer et atténuer ces risques. Les règles du règlement sur l’IA relatives au GPAI sont entrées en vigueur en août 2025.

Soutenir la conformité

En juillet 2025, la Commission a publié trois instruments clés pour soutenir le développement et le déploiement responsables de modèles d’IAGP:

- Les lignes directrices sur le champ d’application des obligations pour les fournisseurs de modèles d’IAGP clarifient le champ d’application des obligations d’IAGP au titre de la législation sur l’IA, en aidant les acteurs tout au long de la chaîne de valeur de l’IA à comprendre qui doit se conformer à ces obligations.

- Le code de bonnes pratiques GPAI est un outil de conformité volontaire soumis à la Commission par des experts indépendants, qui offre des orientations pratiques pour aider les fournisseurs à se conformer aux obligations qui leur incombent en vertu de la législation sur l’IA en matière de transparence, de droit d’auteur et de sécurité.

- Le modèle de résumé public du contenu de formation des modèles GPAI exige que les fournisseurs donnent un aperçu des données utilisées pour former leurs modèles. Il s’agit notamment des sources à partir desquelles les données ont été obtenues (comprenant de grands ensembles de données et des noms de domaine de premier plan). Le modèle demande également des informations sur les aspects liés au traitement des données afin de permettre aux parties ayant des intérêts légitimes d’exercer leurs droits en vertu du droit de l’Union.

Ces outils sont conçus pour travailler main dans la main. Ensemble, ils fournissent un cadre clair et exploitable permettant aux fournisseurs de modèles d’IAGP de se conformer à la législation sur l’IA, de réduire la charge administrative et de favoriser l’innovation tout en préservant les droits fondamentaux et la confiance du public.

La Commission élabore également d’autres outils de soutien qui fournissent des orientations sur la manière de se conformer aux règles de transparence de la législation sur l’IA:

- Code de bonnes pratiques sur le marquage et l’étiquetage des contenus générés par l’IA sélectionnés par le Bureau de l’IA. Le code sera un outil volontaire destiné à guider les fournisseurs et les déployeurs de systèmes d’IA générative afin qu’ils se conforment aux obligations de transparence. Il s'agit notamment de marquer le contenu généré par l'IA et de divulguer la nature artificielle des images, de l'audio (y compris les deepfakes) et du texte.

- Lignes directrices sur les systèmes d’IA transparents visant à clarifier le champ d’application, les définitions juridiques pertinentes, les obligations de transparence, les exceptions et les questions horizontales connexes.

Ces instruments de soutien sont en cours d’élaboration et seront publiés au cours du deuxième trimestre de 2026. En savoir plus sur la manière dont le Bureau de l’IA soutient la mise en œuvre de la législation sur l’IA.

Gouvernance et mise en œuvre

Le Bureau européen de l’IA et les autorités des États membres sont responsables de la mise en œuvre, de la supervision et de l’application de la législation sur l’IA. Le comité de l’IA, le groupe scientifique et le forum consultatif orientent et conseillent la gouvernance de la législation sur l’IA. En savoir plus sur la gouvernance et l’application de la législation sur l’IA.

Calendrier des demandes

La législation sur l’IA est entrée en vigueur le 1er août 2024 et sera pleinement applicable deux ans plus tard, le 2 août 2026, à quelques exceptions près:

- les pratiques d’IA interdites et les obligations en matière de littératie en matière d’IA sont entrées en application à partir du 2 février 2025

- les règles de gouvernance et les obligations applicables aux modèles d’IAGP sont devenues applicables le 2 août 2025;

- les règles applicables aux systèmes d’IA à haut risque – intégrés dans des produits réglementés – bénéficient d’une période de transition prolongée jusqu’au 2 août 2027;

Quelle est la proposition de la Commission visant à simplifier la mise en œuvre de la législation sur l’IA?

Le paquet numérique sur la simplification propose des modifications visant à simplifier la mise en œuvre de la législation sur l’IA et à garantir que les règles restent claires, simples et propices à l’innovation.

La Commission propose d’adapter le calendrier d’application des règles à haut risque à un maximum de 16 mois. Cela garantit que les règles s'appliquent lorsque les entreprises disposent des outils de soutien appropriés pour faciliter la mise en œuvre, tels que les normes.

La Commission propose également des modifications ciblées de la législation sur l’IA qui:

- renforcer les pouvoirs du Bureau de l’IA et centraliser la surveillance des systèmes d’IA fondés sur des modèles d’IA à usage général, en réduisant la fragmentation de la gouvernance;

- étendre certaines simplifications accordées aux PME et aux PME, y compris des exigences simplifiées en matière de documentation technique;

- demander à la Commission et aux États membres de promouvoir l’alphabétisation en matière d’IA et de garantir un soutien continu aux entreprises en s’appuyant sur les efforts existants (tels que le répertoire des pratiques d’alphabétisation en matière d’IA du Bureau de l’IA, récemment remanié), tout en maintenant les obligations de formation pour les déployeurs à haut risque;

- élargir les mesures de soutien à la conformité afin que davantage d’innovateurs puissent bénéficier des bacs à sable réglementaires qui seront mis en place à partir de 2028 et en élargissant les possibilités d’essais en conditions réelles;

- Ajuster les procédures de la législation sur l’IA afin de clarifier son interaction avec d’autres lois et d’améliorer sa mise en œuvre et son fonctionnement globaux.

Tous ces éléments complètent les mesures que la Commission et son Bureau de l’IA prennent déjà pour apporter des éclaircissements aux entreprises et aux autorités nationales, par exemple au moyen de lignes directrices, de codes de bonnes pratiques et du Service Desk de la législation sur l’IA.

La proposition législative a été adoptée le 19 novembre. Le Parlement européen et le Conseil de l’UE discutent et négocient actuellement l’omnibus numérique sur l’IA.

Dernières nouvelles

Politique et législation

- 05-03-2026La Commission publie un deuxième projet de code de bonnes pratiques sur le marquage et l’étiquetage des contenus générés par l’IA

- 20-02-2026Déclaration des dirigeants lors du sommet sur l’impact de l’IA en Inde

- 21-01-2026Proposition de règlement relatif à la législation sur les réseaux numériques (DNA)

Rapport / Etude

- 07-04-2026L'intelligence artificielle dans les soins cardiovasculaires : de la promesse à la pratique

- 17-03-2026Study on Artificial Intelligence in healthcare dissects digital health technologies in Europe

- 01-12-2025Étude - la prochaine frontière des données: IA générative, conformité réglementaire et dimensions internationales

Fiche d’information / infographie

Contenu associé

Vue d’ensemble

Aller plus loin

-

Le Bureau européen de l’IA et les autorités nationales de surveillance du marché sont responsables...

-

La Commission vise à accroître le nombre d’experts en IA en formant et en attirant davantage de...

-

Les normes harmonisées offriront une sécurité juridique au titre de la législation sur l’IA...

-

L’outil de dénonciation de la législation sur l’IA permet aux personnes de soumettre un rapport en...