Akt o umetni inteligenci je prvi pravni okvir o umetni inteligenci, ki obravnava tveganja umetne inteligence in Evropi daje vodilno vlogo na svetovni ravni.

Akt o umetni inteligenci (Uredba (EU) 2024/1689 o določitvi harmoniziranih pravil o umetni inteligenci) je prvi celovit pravni okvir o umetni inteligenci na svetu. Cilj pravil je spodbujati zaupanja vredno umetno inteligenco v Evropi. Vsa vprašanja o aktu o umetni inteligenci so na voljo na enotni informacijski platformi akta o umetni inteligenci.

Akt o umetni inteligenci določa pravila, ki temeljijo na tveganju, za razvijalce in uvajalce umetne inteligence v zvezi s posebnimi uporabami umetne inteligence. Akt o umetni inteligenci je del širšega svežnja ukrepov politike za podporo razvoju zaupanja vredne umetne inteligence, ki vključuje tudi akcijski načrt za celino umetne inteligence, sveženj o inovacijah na področju umetne inteligence in zagon tovarn umetne inteligence. Ti ukrepi skupaj zagotavljajo varnost, temeljne pravice in na človeka osredotočeno umetno inteligenco ter krepijo uvajanje, naložbe in inovacije na področju umetne inteligence po vsej EU.

Komisija je za olajšanje prehoda na novi regulativni okvir uvedla pakt za umetno inteligenco, tj. prostovoljno pobudo, katere namen je podpreti prihodnje izvajanje, sodelovati z deležniki ter ponudnike in uvajalce umetne inteligence iz Evrope in zunaj nje pozvati, naj pravočasno izpolnijo ključne obveznosti iz akta o umetni inteligenci. Hkrati storitveni center za akt o umetni inteligenci zagotavlja tudi informacije in podporo za nemoteno in učinkovito izvajanje akta o umetni inteligenci po vsej EU.

Zakaj potrebujemo pravila o umetni inteligenci?

Akt o umetni inteligenci zagotavlja, da lahko Evropejci zaupajo temu, kar ponuja umetna inteligenca. Čeprav večina umetnointeligenčnih sistemov ne predstavlja nobenega tveganja in lahko prispeva k reševanju številnih družbenih izzivov, nekateri umetnointeligenčni sistemi ustvarjajo tveganja, ki jih moramo obravnavati, da bi se izognili neželenim rezultatom.

Na primer, pogosto ni mogoče ugotoviti, zakaj je umetnointeligenčni sistem sprejel odločitev ali napoved in sprejel določen ukrep. Zato bo morda težko oceniti, ali je bil nekdo neupravičeno prikrajšan, na primer pri odločitvi o zaposlitvi ali vlogi za javnokoristno shemo.

Čeprav obstoječa zakonodaja zagotavlja določeno zaščito, ne zadostuje za obravnavanje posebnih izzivov, ki jih lahko prinesejo umetnointeligenčni sistemi.

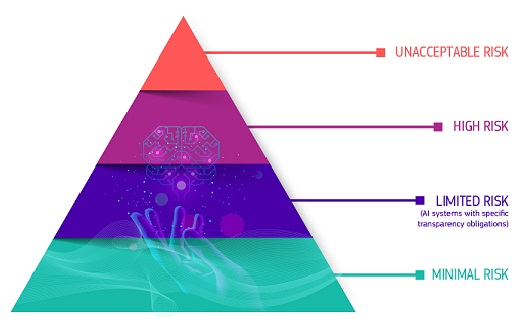

Pristop, ki temelji na tveganju

Akt o umetni inteligenci opredeljuje štiri ravni tveganja za umetnointeligenčne sisteme:

Nesprejemljivo tveganje

Vsi umetnointeligenčni sistemi, ki se štejejo za jasno grožnjo varnosti, možnostim preživljanja in pravicam ljudi, so prepovedani. Akt o umetni inteligenci prepoveduje osem praks, in sicer:

- škodljive manipulacije in prevare, ki temeljijo na umetni inteligenci

- škodljivo izkoriščanje ranljivosti, ki temelji na umetni inteligenci

- socialno točkovanje

- Ocena ali napoved tveganja posameznega kaznivega dejanja

- neciljno strganje interneta ali gradiva CCTV za vzpostavitev ali razširitev podatkovnih zbirk za prepoznavanje obrazov

- Priznavanje čustev na delovnih mestih in v izobraževalnih ustanovah

- biometrična kategorizacija za izpeljavo nekaterih zaščitenih značilnosti

- biometrična identifikacija na daljavo v realnem času za namene preprečevanja, odkrivanja in preiskovanja kaznivih dejanj v javno dostopnih prostorih

Prepovedi so začele veljati februarja 2025. Komisija je objavila dva ključna dokumenta v podporo praktični uporabi prepovedanih praks:

- Smernice o prepovedanih praksah umetne inteligence v skladu z aktom o umetni inteligenci, ki zagotavljajo pravne razlage in praktične primere za pomoč deležnikom pri razumevanju prepovedi in upoštevanju prepovedi.

- Smernice o opredelitvi umetnointeligenčnega sistema iz akta o umetni inteligenci za pomoč deležnikom pri določanju področja uporabe akta o umetni inteligenci

Visoko tveganje

Primeri uporabe umetne inteligence, ki lahko pomenijo resno tveganje za zdravje, varnost ali temeljne pravice, so razvrščeni kot primeri velikega tveganja. Ti primeri uporabe z visokim tveganjem vključujejo:

- Varnostne komponente umetne inteligence v kritičnih infrastrukturah (npr. prometu), katerih okvara bi lahko ogrozila življenje in zdravje državljanov

- Umetnointeligenčne rešitve, ki se uporabljajo v izobraževalnih ustanovah in lahko določajo dostop do izobraževanja in potek poklicnega življenja (npr. točkovanje izpitov)

- Varnostne komponente proizvodov, ki temeljijo na umetni inteligenci (npr. uporaba umetne inteligence pri operacijah s pomočjo robota)

- Orodja umetne inteligence za zaposlovanje, upravljanje delavcev in dostop do samozaposlitve (npr. programska oprema za razvrščanje življenjepisov za zaposlovanje)

- Nekateri primeri uporabe umetne inteligence, ki se uporabljajo za zagotavljanje dostopa do osnovnih zasebnih in javnih storitev (npr. kreditno točkovanje, ki državljanom onemogoča pridobitev posojila)

- Umetnointeligenčni sistemi, ki se uporabljajo za biometrično identifikacijo na daljavo, prepoznavanje čustev in biometrično kategorizacijo (npr. umetnointeligenčni sistem za retroaktivno identifikacijo krajodajalca)

- Primeri uporabe umetne inteligence pri preprečevanju, odkrivanju in preiskovanju kaznivih dejanj, ki lahko posegajo v temeljne pravice ljudi (npr. ocena zanesljivosti dokazov)

- Primeri uporabe umetne inteligence pri upravljanju migracij, azila in nadzora meja (npr. avtomatizirano obravnavanje vlog za izdajo vizuma)

- Rešitve umetne inteligence, ki se uporabljajo v pravosodju in demokratičnih procesih (npr. rešitve umetne inteligence za pripravo sodnih odločb)

Za umetnointeligenčne sisteme velikega tveganja veljajo stroge obveznosti, preden se lahko dajo na trg:

- ustrezni sistemi za oceno in zmanjšanje tveganja

- visokokakovostni nabori podatkov, ki se uporabljajo v sistemu, da se čim bolj zmanjša tveganje diskriminatornih rezultatov

- beleženje dejavnosti za zagotovitev sledljivosti rezultatov

- podrobno dokumentacijo z vsemi potrebnimi informacijami o sistemu in njegovem namenu, da lahko organi ocenijo njegovo skladnost;

- jasne in ustrezne informacije uvajalcu

- ustrezni ukrepi za človeški nadzor

- visoka raven robustnosti, kibernetske varnosti in natančnosti

Pravila za umetno inteligenco velikega tveganja bodo začela veljati avgusta 2026 in avgusta 2027.

Tveganje za preglednost

To se nanaša na tveganja, povezana s potrebo po preglednosti v zvezi z uporabo umetne inteligence. Akt o umetni inteligenci uvaja posebne obveznosti razkritja za zagotovitev, da so ljudje obveščeni, kadar je to potrebno za ohranitev zaupanja. Na primer, pri uporabi umetnointeligenčnih sistemov, kot so klepetalni boti, bi bilo treba ljudi opozoriti, da komunicirajo s strojem, da lahko sprejmejo informirano odločitev.

Poleg tega morajo ponudniki generativne umetne inteligence zagotoviti, da je mogoče prepoznati vsebino, ustvarjeno z umetno inteligenco. Poleg tega bi morale biti nekatere vsebine, ustvarjene z umetno inteligenco, jasno in vidno označene, in sicer globoki ponaredki in besedilo, objavljeno z namenom obveščanja javnosti o zadevah javnega interesa.

Pravila o preglednosti iz akta o umetni inteligenci bodo začela veljati avgusta 2026.

Minimalno tveganje ali brez tveganja

Akt o umetni inteligenci ne uvaja pravil za umetno inteligenco, ki se šteje za minimalno ali brez tveganja. V to kategorijo spada velika večina umetnointeligenčnih sistemov, ki se trenutno uporabljajo v EU. To vključuje aplikacije, kot so videoigre, ki podpirajo umetno inteligenco, ali filtri za neželeno elektronsko pošto.

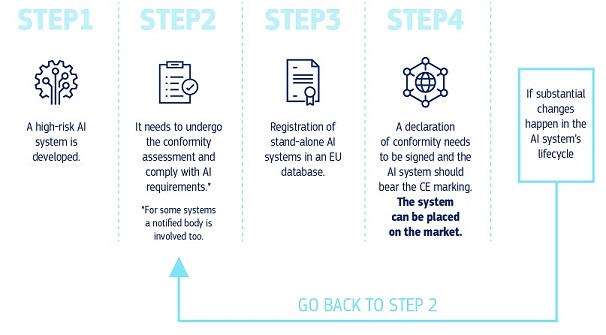

Kako vse to deluje v praksi za ponudnike umetnointeligenčnih sistemov velikega tveganja?

Ko je umetnointeligenčni sistem na trgu, so organi odgovorni za nadzor trga, uvajalci zagotavljajo človeški nadzor in spremljanje, ponudniki pa imajo vzpostavljen sistem spremljanja po dajanju na trg. Ponudniki in uvajalci bodo poročali tudi o resnih incidentih in nepravilnem delovanju.

Kakšna so pravila za umetnointeligenčne modele za splošne namene?

Modeli umetne inteligence za splošne namene lahko opravljajo najrazličnejše naloge in postajajo podlaga za številne umetnointeligenčne sisteme v EU. Nekateri od teh modelov bi lahko predstavljali sistemska tveganja, če bi bili zelo zmogljivi ali široko uporabljeni. Za zagotovitev varne in zaupanja vredne umetne inteligence akt o umetni inteligenci določa pravila za ponudnike takih modelov. To vključuje preglednost in pravila v zvezi z avtorskimi pravicami. Za modele, ki lahko pomenijo sistemska tveganja, bi morali ponudniki ta tveganja oceniti in zmanjšati. Pravila akta o umetni inteligenci o GPAI so začela veljati avgusta 2025.

Podpiranje skladnosti

Komisija je julija 2025 objavila tri ključne instrumente za podporo odgovornemu razvoju in uvajanju modelov GPAI:

- V smernicah o obsegu obveznosti ponudnikov modelov GPAI je pojasnjeno področje uporabe obveznosti GPAI na podlagi akta o umetni inteligenci, kar akterjem vzdolž vrednostne verige umetne inteligence pomaga razumeti, kdo mora izpolnjevati te obveznosti.

- Kodeks ravnanja GPAI je prostovoljno orodje za zagotavljanje skladnosti, ki so ga Komisiji predložili neodvisni strokovnjaki in ki ponuja praktične smernice za pomoč ponudnikom pri izpolnjevanju njihovih obveznosti iz akta o umetni inteligenci v zvezi s preglednostjo, avtorskimi pravicami ter varnostjo in varovanjem.

- Predloga za javni povzetek vsebine usposabljanja za modele GPAI od ponudnikov zahteva, da zagotovijo pregled podatkov, ki se uporabljajo za usposabljanje njihovih modelov. To vključuje vire, iz katerih so bili podatki pridobljeni (vključno z velikimi nabori podatkov in najvišjimi domenskimi imeni). Predloga zahteva tudi informacije o vidikih obdelave podatkov, da se strankam z zakonitimi interesi omogoči uveljavljanje njihovih pravic v skladu s pravom EU.

Ta orodja so zasnovana tako, da delujejo z roko v roki. Skupaj zagotavljajo jasen in izvedljiv okvir za ponudnike modelov GPAI za skladnost z aktom o umetni inteligenci, zmanjšujejo upravno breme in spodbujajo inovacije, hkrati pa varujejo temeljne pravice in zaupanje javnosti.

Komisija razvija tudi druga orodja za podporo, ki zagotavljajo smernice o tem, kako ravnati v skladu s pravili o preglednosti iz akta o umetni inteligenci:

- Kodeks ravnanja pri označevanju in etiketiranju vsebin, ustvarjenih z umetno inteligenco, ki ga je izbral urad za umetno inteligenco. Kodeks bo prostovoljno orodje za usmerjanje ponudnikov in uvajalcev generativnih umetnointeligenčnih sistemov k izpolnjevanju obveznosti glede preglednosti. Ti vključujejo označevanje vsebin, ustvarjenih z umetno inteligenco, ter razkrivanje umetne narave slik, zvoka (vključno z globokimi ponaredki) in besedila.

- Smernice o preglednih umetnointeligenčnih sistemih za pojasnitev področja uporabe, ustreznih pravnih opredelitev, obveznosti glede preglednosti, izjem in povezanih horizontalnih vprašanj.

Ti podporni instrumenti so v pripravi in bodo objavljeni v drugem četrtletju leta 2026. Več o tem, kako Urad za umetno inteligenco podpira izvajanje akta o umetni inteligenci.

Upravljanje in izvajanje

Evropski urad za umetno inteligenco in organi držav članic so odgovorni za izvajanje, nadzor in izvrševanje akta o umetni inteligenci. Odbor za umetno inteligenco, znanstveni odbor in svetovalni forum usmerjajo upravljanje akta o umetni inteligenci in svetujejo v zvezi z njim. Več podrobnosti o upravljanju in izvrševanju akta o umetni inteligenci.

Časovnica uporabe

Akt o umetni inteligenci je začel veljati 1. avgusta 2024 in se bo v celoti uporabljal dve leti pozneje, tj. 2. avgusta 2026, z nekaterimi izjemami:

- prepovedane prakse umetne inteligence in obveznosti glede pismenosti na področju umetne inteligence, ki so se začele uporabljati 2. februarja 2025

- pravila o upravljanju in obveznosti za modele GPAI so se začela uporabljati 2. avgusta 2025;

- pravila za umetnointeligenčne sisteme velikega tveganja, vgrajene v regulirane proizvode, imajo podaljšano prehodno obdobje do 2. avgusta 2027

Kakšen je predlog Komisije za poenostavitev izvajanja akta o umetni inteligenci?

V digitalnem svežnju o poenostavitvi so predlagane spremembe za poenostavitev izvajanja akta o umetni inteligenci ter zagotovitev, da pravila ostanejo jasna, preprosta in inovacijam prijazna.

Komisija predlaga prilagoditev časovnega okvira za uporabo pravil z visokim tveganjem na največ 16 mesecev. To zagotavlja, da se pravila uporabljajo, kadar imajo podjetja ustrezna podporna orodja za lažje izvajanje, kot so standardi.

Komisija predlaga tudi ciljno usmerjene spremembe akta o umetni inteligenci, ki bodo:

- okrepitev pristojnosti urada za umetno inteligenco in centralizacija nadzora nad umetnointeligenčnimi sistemi, ki temeljijo na umetnointeligenčnih modelih za splošne namene, s čimer bi se zmanjšala razdrobljenost upravljanja;

- razširitev nekaterih poenostavitev, odobrenih MSP in SMC, vključno s poenostavljenimi zahtevami glede tehnične dokumentacije;

- poziva Komisijo in države članice, naj spodbujajo pismenost na področju umetne inteligence in zagotovijo stalno podporo podjetjem na podlagi obstoječih prizadevanj (kot je nedavno prenovljen repozitorij praks pismenosti na področju umetne inteligence urada za umetno inteligenco), hkrati pa ohranijo obveznosti usposabljanja za uvajalce z visokim tveganjem;

- razširiti ukrepe v podporo skladnosti, da bo lahko več inovatorjev izkoristilo regulativne peskovnike, ki bodo vzpostavljeni od leta 2028, in razširiti možnosti za preizkušanje v resničnem svetu;

- Prilagoditi postopke akta o umetni inteligenci, da se pojasni njegov medsebojni vpliv z drugimi zakoni ter izboljšata njegovo splošno izvajanje in delovanje.

Vse to dopolnjuje ukrepe, ki jih Komisija in njen urad za umetno inteligenco že sprejemata, da bi podjetjem in nacionalnim organom zagotovila jasnost, na primer s smernicami, kodeksi ravnanja in storitvenim centrom za akt o umetni inteligenci.

Zakonodajni predlog je bil sprejet 19. novembra. Evropski parlament in Svet EU zdaj razpravljata in se pogajata o digitalnem omnibusu o umetni inteligenci.

Zadnje novice

Publikacija

- 07-04-2026Umetna inteligenca v kardiovaskularni oskrbi: od obljube do prakse

- 17-03-2026Študija o umetni inteligenci v zdravstvu secira digitalne zdravstvene tehnologije v Evropi

- 01-12-2025Študija – naslednja podatkovna meja: generativna umetna inteligenca, skladnost z zakonodajo in mednarodne razsežnosti

Informativni pregled/infografika

Povezane vsebine

Širša slika

Podrobnejše informacije

-

Evropski urad za umetno inteligenco in nacionalni organi za nadzor trga so odgovorni za izvajanje...

-

Komisija si prizadeva povečati število strokovnjakov za umetno inteligenco z usposabljanjem in...

-

Harmonizirani standardi bodo zagotovili pravno varnost v skladu z aktom o umetni inteligenci...

-

Orodje za žvižgače iz akta o umetni inteligenci posameznikom omogoča, da varno predložijo poročilo...