Das KI-Gesetz ist der erste Rechtsrahmen für KI, der sich mit den Risiken von KI befasst und Europa in die Lage versetzt, weltweit eine führende Rolle zu spielen.

Das KI-Gesetz (Verordnung (EU) 2024/1689 zur Festlegung harmonisierter Vorschriften für künstliche Intelligenz) ist der weltweit erste umfassende Rechtsrahmen für KI. Ziel der Vorschriften ist es, eine vertrauenswürdige KI in Europa zu fördern. Alle Fragen zum KI-Gesetz finden Sie auf der zentralen Informationsplattform für KI-Gesetze.

Das KI-Gesetz enthält risikobasierte Regeln für KI-Entwickler und -Bereitsteller in Bezug auf spezifische Anwendungen von KI. Das KI-Gesetz ist Teil eines umfassenderen Pakets politischer Maßnahmen zur Unterstützung der Entwicklung vertrauenswürdiger KI, das auch den Aktionsplan für den KI-Kontinent, das KI-Innovationspaket und die Einführung von KI-Fabriken umfasst. Gemeinsam gewährleisten diese Maßnahmen Sicherheit, Grundrechte und menschenzentrierte KI und stärken die Akzeptanz, Investitionen und Innovation im Bereich KI in der gesamten EU.

Um den Übergang zum neuen Rechtsrahmen zu erleichtern, hat die Kommission den KI-Pakt ins Leben gerufen, eine freiwillige Initiative, die darauf abzielt, die künftige Umsetzung zu unterstützen, mit Interessenträgern zusammenzuarbeiten und KI-Anbieter und -Einführer aus Europa und darüber hinaus einzuladen, die wichtigsten Verpflichtungen des KI-Gesetzes vorzeitig zu erfüllen. Parallel dazu bietet der AI Act Service Desk auch Informationen und Unterstützung für eine reibungslose und wirksame Umsetzung des KI-Gesetzes in der gesamten EU.

Warum brauchen wir KI-Regeln?

Das KI-Gesetz stellt sicher, dass die Europäer darauf vertrauen können, was KI zu bieten hat. Während die meisten KI-Systeme auf kein Risiko beschränkt sind und zur Lösung vieler gesellschaftlicher Herausforderungen beitragen können, bergen bestimmte KI-Systeme Risiken, die wir angehen müssen, um unerwünschte Ergebnisse zu vermeiden.

Zum Beispiel ist es oft nicht möglich herauszufinden, warum ein KI-System eine Entscheidung oder Vorhersage getroffen und eine bestimmte Maßnahme ergriffen hat. Daher kann es schwierig werden, zu beurteilen, ob jemand unfair benachteiligt wurde, beispielsweise in einer Einstellungsentscheidung oder in einem Antrag auf ein öffentliches Versorgungssystem.

Die bestehenden Rechtsvorschriften bieten zwar einen gewissen Schutz, reichen jedoch nicht aus, um die besonderen Herausforderungen anzugehen, die KI-Systeme mit sich bringen können.

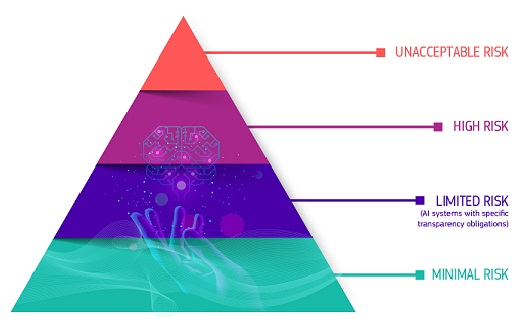

Ein risikobasierter Ansatz

Das KI-Gesetz definiert vier Risikostufen für KI-Systeme:

Inakzeptables Risiko

Alle KI-Systeme, die als klare Bedrohung für die Sicherheit, die Lebensgrundlagen und die Rechte der Menschen angesehen werden, sind verboten. Das KI-Gesetz verbietet acht Praktiken, nämlich:

- schädliche KI-basierte Manipulation und Täuschung

- schädliche KI-basierte Ausnutzung von Schwachstellen

- Soziales Scoring

- Individuelle Risikobewertung oder -vorhersage von Straftaten

- ungezieltes Abkratzen von Internet- oder CCTV-Material zur Erstellung oder Erweiterung von Gesichtserkennungsdatenbanken

- Emotionserkennung an Arbeitsplätzen und Bildungseinrichtungen

- biometrische Kategorisierung zur Ableitung bestimmter geschützter Merkmale

- biometrische Echtzeit-Fernidentifizierung für Strafverfolgungszwecke in öffentlich zugänglichen Räumen

Die Verbote traten im Februar 2025 in Kraft. Die Kommission veröffentlichte zwei Schlüsseldokumente zur Unterstützung der praktischen Anwendung der verbotenen Praktiken:

- Die Leitlinien zu verbotenen KI-Praktiken im Rahmen des KI-Gesetzes, die rechtliche Erläuterungen und praktische Beispiele bieten, um den Interessenträgern zu helfen, die Verbote zu verstehen und einzuhalten.

- Leitlinien zur Definition des KI-Systems des KI-Gesetzes, um die Interessenträger bei der Festlegung des Anwendungsbereichs des KI-Gesetzes zu unterstützen

Hohes Risiko

KI-Anwendungsfälle, die schwerwiegende Risiken für die Gesundheit, die Sicherheit oder die Grundrechte darstellen können, werden als hochriskant eingestuft. Zu diesen Anwendungsfällen mit hohem Risiko gehören:

- KI-Sicherheitskomponenten in kritischen Infrastrukturen (z. B. Verkehr), deren Ausfall das Leben und die Gesundheit der Bürger gefährden könnte

- KI-Lösungen in Bildungseinrichtungen, die den Zugang zu Bildung und den Verlauf des Berufslebens einer Person bestimmen können (z. B. Bewertung von Prüfungen)

- KI-basierte Sicherheitskomponenten von Produkten (z.B. KI-Anwendung in der robotergestützten Chirurgie)

- KI-Instrumente für die Beschäftigung, das Management von Arbeitnehmern und den Zugang zur Selbständigkeit (z. B. Software zur Auswahl von Lebensläufen für die Einstellung)

- Bestimmte KI-Anwendungsfälle, die genutzt werden, um den Zugang zu wesentlichen privaten und öffentlichen Dienstleistungen zu ermöglichen (z. B. Kreditwürdigkeitsprüfung, die den Bürgern die Möglichkeit verwehrt, einen Kredit zu erhalten)

- KI-Systeme zur biometrischen Fernidentifizierung, Emotionserkennung und biometrischen Kategorisierung (z. B. KI-System zur rückwirkenden Identifizierung eines Ladendiebes)

- KI-Anwendungsfälle in der Strafverfolgung, die die Grundrechte der Menschen beeinträchtigen können (z. B. Bewertung der Zuverlässigkeit von Beweismitteln)

- KI-Anwendungsfälle im Migrations-, Asyl- und Grenzkontrollmanagement (z. B. automatisierte Prüfung von Visumanträgen)

- KI-Lösungen für die Rechtspflege und demokratische Prozesse (z. B. KI-Lösungen zur Vorbereitung von Gerichtsurteilen)

Hochrisiko-KI-Systeme unterliegen strengen Verpflichtungen, bevor sie in Verkehr gebracht werden können:

- angemessene Risikobewertungs- und Risikominderungssysteme

- hohe Qualität der Datensätze, mit denen das System versorgt wird, um das Risiko diskriminierender Ergebnisse zu minimieren

- Protokollierung der Aktivitäten zur Gewährleistung der Rückverfolgbarkeit der Ergebnisse

- ausführliche Dokumentation mit allen erforderlichen Informationen über das System und seinen Zweck für die Behörden zur Bewertung seiner Konformität

- klare und angemessene Informationen für den Betreiber

- angemessene Maßnahmen der menschlichen Aufsicht

- hohe Robustheit, Cybersicherheit und Genauigkeit

Die Regeln für Hochrisiko-KI treten im August 2026 und August 2027 in Kraft.

Transparenzrisiko

Dies bezieht sich auf die Risiken, die mit der Notwendigkeit der Transparenz in Bezug auf den Einsatz von KI verbunden sind. Mit dem KI-Gesetz werden spezifische Offenlegungspflichten eingeführt, um sicherzustellen, dass Menschen informiert werden, wenn dies zur Wahrung des Vertrauens erforderlich ist. Zum Beispiel sollten Menschen bei der Verwendung von KI-Systemen wie Chatbots darauf hingewiesen werden, dass sie mit einer Maschine interagieren, damit sie eine fundierte Entscheidung treffen können.

Darüber hinaus müssen Anbieter generativer KI sicherstellen, dass KI-generierte Inhalte identifizierbar sind. Darüber hinaus sollten bestimmte KI-generierte Inhalte klar und sichtbar gekennzeichnet werden, d. h. Deep Fakes und Texte, die veröffentlicht werden, um die Öffentlichkeit über Angelegenheiten von öffentlichem Interesse zu informieren.

Die Transparenzregeln des KI-Gesetzes treten im August 2026 in Kraft.

Minimales oder kein Risiko

Mit dem KI-Gesetz werden keine Vorschriften für KI eingeführt, die als minimal oder nicht risikobehaftet gelten. Die überwiegende Mehrheit der derzeit in der EU verwendeten KI-Systeme fällt in diese Kategorie. Dazu gehören Anwendungen wie KI-fähige Videospiele oder Spamfilter.

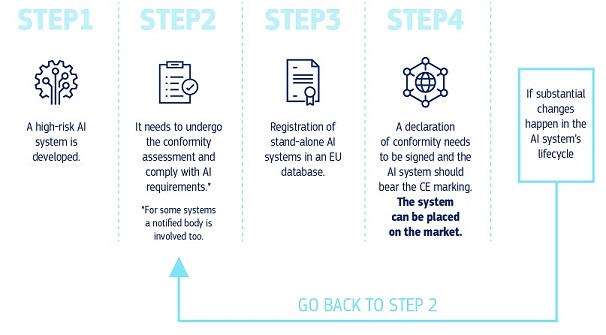

Wie funktioniert das alles in der Praxis für Anbieter von Hochrisiko-KI-Systemen?

Sobald ein KI-System auf dem Markt ist, sind die Behörden für die Marktüberwachung zuständig, die Betreiber stellen die menschliche Aufsicht und Überwachung sicher und die Anbieter verfügen über ein System zur Überwachung nach dem Inverkehrbringen. Anbieter und Betreiber werden auch schwerwiegende Vorfälle und Fehlfunktionen melden.

Was sind die Regeln für KI-Modelle mit allgemeinem Zweck?

Allgemeine KI-Modelle können eine Vielzahl von Aufgaben erfüllen und werden zur Grundlage für viele KI-Systeme in der EU. Einige dieser Modelle könnten systemische Risiken mit sich bringen, wenn sie sehr fähig oder weit verbreitet sind. Um eine sichere und vertrauenswürdige KI zu gewährleisten, werden mit dem KI-Gesetz Vorschriften für Anbieter solcher Modelle eingeführt. Dazu gehören Transparenz und urheberrechtliche Vorschriften. Bei Modellen, die systemische Risiken bergen können, sollten die Anbieter diese Risiken bewerten und mindern. Die Vorschriften des KI-Gesetzes über GPAI traten im August 2025 in Kraft.

Unterstützung der Compliance

Im Juli 2025 veröffentlichte die Kommission drei Schlüsselinstrumente zur Unterstützung der verantwortungsvollen Entwicklung und Einführung von GPAI-Modellen:

- Die Leitlinien zum Anwendungsbereich der Verpflichtungen für Anbieter von GPAI-Modellen präzisieren den Anwendungsbereich der GPAI-Verpflichtungen nach dem KI-Gesetz und helfen den Akteuren entlang der KI-Wertschöpfungskette zu verstehen, wer diesen Verpflichtungen nachkommen muss.

- Der GPAI-Praxiskodex ist ein freiwilliges Compliance-Instrument, das der Kommission von unabhängigen Sachverständigen vorgelegt wird und praktische Anleitungen bietet, um Anbieter bei der Erfüllung ihrer Verpflichtungen gemäß dem KI-Gesetz in Bezug auf Transparenz, Urheberrecht und Sicherheit zu unterstützen.

- Die Vorlage für die öffentliche Zusammenfassung der Schulungsinhalte von GPAI-Modellen verlangt von den Anbietern, einen Überblick über die Daten zu geben, die für die Schulung ihrer Modelle verwendet werden. Dazu gehören auch die Quellen, aus denen die Daten gewonnen wurden (große Datensätze und Top-Domain-Namen). In der Vorlage werden auch Informationen zu Datenverarbeitungsaspekten angefordert, damit Parteien mit berechtigten Interessen ihre Rechte nach EU-Recht ausüben können.

Diese Werkzeuge sind so konzipiert, dass sie Hand in Hand arbeiten. Gemeinsam bieten sie Anbietern von GPAI-Modellen einen klaren und umsetzbaren Rahmen zur Einhaltung des KI-Gesetzes, zur Verringerung des Verwaltungsaufwands und zur Förderung von Innovationen bei gleichzeitiger Wahrung der Grundrechte und des öffentlichen Vertrauens.

Die Kommission entwickelt auch Unterstützung für andere Instrumente, die Orientierungshilfen für die Einhaltung der Transparenzvorschriften des KI-Gesetzes bieten:

- Der Verhaltenskodex für die Kennzeichnung und Kennzeichnung von KI-generierten Inhalten, der vom Amt für künstliche Intelligenz ausgewählt wurde. Der Kodex wird ein freiwilliges Instrument sein, um Anbieter und Betreiber generativer KI-Systeme bei der Einhaltung von Transparenzverpflichtungen zu unterstützen. Dazu gehören das Markieren von KI-generierten Inhalten und die Offenlegung der künstlichen Natur von Bildern sowie Audio (einschließlich Deepfakes) und Text.

- die Leitlinien für transparente KI-Systeme zur Klärung des Anwendungsbereichs, der einschlägigen rechtlichen Definitionen, der Transparenzpflichten, der Ausnahmen und damit zusammenhängender horizontaler Fragen.

Diese Unterstützungsinstrumente sind in Vorbereitung und werden im zweiten Quartal 2026 veröffentlicht. Erfahren Sie mehr darüber, wie das Amt für künstliche Intelligenz die Umsetzung des KI-Gesetzes unterstützt.

Governance und Umsetzung

Das Europäische Amt für künstliche Intelligenz und die Behörden der Mitgliedstaaten sind für die Umsetzung, Überwachung und Durchsetzung des KI-Gesetzes zuständig. Der KI-Rat, das Wissenschaftliche Gremium und das Beirat steuern und beraten die Governance des KI-Gesetzes. Weitere Einzelheiten zur Governance und Durchsetzung des KI-Gesetzes finden Sie hier.

Bewerbungszeitplan

Das KI-Gesetz trat am 1. August 2024 in Kraft und wird zwei Jahre später, am 2. August 2026, uneingeschränkt anwendbar sein, mit einigen Ausnahmen:

- Verbotene KI-Praktiken und KI-Kompetenzverpflichtungen, die ab dem 2. Februar 2025 in Kraft getreten sind

- Die Governance-Regeln und die Verpflichtungen für GPAI-Modelle traten am 2. August 2025 in Kraft.

- Die Vorschriften für Hochrisiko-KI-Systeme, die in regulierte Produkte eingebettet sind, haben einen verlängerten Übergangszeitraum bis zum 2. August 2027.

Was ist der Vorschlag der Kommission zur Vereinfachung der Umsetzung des KI-Gesetzes?

Im digitalen Paket zur Vereinfachung werden Änderungen vorgeschlagen, um die Umsetzung des KI-Gesetzes zu vereinfachen und sicherzustellen, dass die Vorschriften klar, einfach und innovationsfreundlich bleiben.

Die Kommission schlägt vor, den Zeitplan für die Anwendung der Vorschriften mit hohem Risiko auf höchstens 16 Monate anzupassen. Dies stellt sicher, dass die Regeln gelten, wenn Unternehmen über die richtigen Unterstützungsinstrumente verfügen, um die Umsetzung zu erleichtern, wie zum Beispiel Standards.

Die Kommission schlägt außerdem gezielte Änderungen des KI-Gesetzes vor, mit denen

- Stärkung der Befugnisse des Amtes für künstliche Intelligenz und Zentralisierung der Aufsicht über KI-Systeme, die auf KI-Modellen mit allgemeinem Verwendungszweck basieren, wodurch die Fragmentierung der Governance verringert wird;

- Ausweitung bestimmter Vereinfachungen, die KMU und KMU gewährt werden, einschließlich vereinfachter Anforderungen an die technische Dokumentation;

- die Kommission und die Mitgliedstaaten aufzufordern, KI-Kenntnisse zu fördern und eine kontinuierliche Unterstützung von Unternehmen sicherzustellen, indem sie auf bestehenden Bemühungen aufbauen (wie dem kürzlich überarbeiteten Verzeichnis der KI-Kenntnisse des Amtes für KI-Kenntnisse), und gleichzeitig die Schulungspflichten für Betreiber mit hohem Risiko aufrechtzuerhalten;

- Ausweitung der Maßnahmen zur Unterstützung der Einhaltung der Vorschriften, damit mehr Innovatoren von Reallaboren profitieren können, die ab 2028 eingerichtet werden, und indem die Möglichkeiten für Tests in der Praxis erweitert werden;

- Anpassung der Verfahren des KI-Gesetzes, um sein Zusammenspiel mit anderen Gesetzen zu klären und seine allgemeine Umsetzung und Funktionsweise zu verbessern.

All dies ergänzt die Maßnahmen, die die Kommission und ihr Amt für künstliche Intelligenz bereits ergreifen, um Klarheit für Unternehmen und nationale Behörden zu schaffen, beispielsweise durch Leitlinien, Verhaltenskodizes und den Service Desk für KI-Gesetze.

Der Legislativvorschlag wurde am 19. November angenommen. Das Europäische Parlament und der Rat der EU erörtern und verhandeln derzeit den digitalen Omnibus zur KI.

Die neuesten Nachrichten

Politik und Rechtsvorschriften

- 05-03-2026Kommission veröffentlicht zweiten Entwurf eines Verhaltenskodex für die Kennzeichnung und Kennzeichnung von KI-generierten Inhalten

- 20-02-2026Erklärung der Staats- und Regierungschefs auf dem KI-Wirkungsgipfel in Indien

- 21-01-2026Vorschlag für eine Verordnung zum Gesetz über digitale Netze (DNA)

Bericht/Studie

- 07-04-2026Künstliche Intelligenz in der kardiovaskulären Versorgung: Vom Versprechen zur Praxis

- 17-03-2026Study on Artificial Intelligence in healthcare dissects digital health technologies in Europe

- 01-12-2025Studie - die nächste Datengrenze: generative KI, Einhaltung gesetzlicher Vorschriften und internationale Dimensionen

Factsheet/Infografik

Zugehöriger Inhalt

Gesamtbild

Vertiefen

-

Das Europäische Amt für künstliche Intelligenz und die nationalen Marktüberwachungsbehörden sind für...

-

Die Kommission will die Zahl der KI-Experten erhöhen, indem sie mehr Forscher und Fachkräfte...

-

Harmonisierte Normen werden Rechtssicherheit im Rahmen des KI-Gesetzes bieten, Innovationen fördern...

-

Das KI-Gesetz-Whistleblower-Tool ermöglicht es Einzelpersonen, auf sichere Weise einen Bericht...