DI aktas yra pirmoji DI teisinė sistema, kuria sprendžiama DI keliama rizika ir užtikrinama, kad Europa atliktų vadovaujamą vaidmenį pasaulyje.

DI aktas (Reglamentas (ES) 2024/1689, kuriuo nustatomos suderintos dirbtinio intelekto taisyklės) yra pirmoji išsami DI teisinė sistema visame pasaulyje. Taisyklių tikslas – skatinti patikimą DI Europoje. Jei turite klausimų dėl DI akto, apsilankykite DI akto bendros informacijos platformoje.

DI akte nustatytos rizika grindžiamos taisyklės DI kūrėjams ir diegėjams dėl konkrečių DI naudojimo būdų. DI aktas yra platesnio politikos priemonių, kuriomis remiamas patikimo DI plėtojimas, rinkinio, kuris taip pat apima žemyninio DI veiksmų planą, DI inovacijų dokumentų rinkinį ir DI fabrikų veiklos pradžią, dalis. Kartu šiomis priemonėmis užtikrinama sauga, pagrindinės teisės ir į žmogų orientuotas DI, taip pat stiprinamas DI įsisavinimas, investicijos ir inovacijos visoje ES.

Siekdama palengvinti perėjimą prie naujos reglamentavimo sistemos, Komisija paskelbė DI paktą – savanorišką iniciatyvą, kuria siekiama remti būsimą įgyvendinimą, bendradarbiauti su suinteresuotaisiais subjektais ir paraginti DI tiekėjus ir diegėjus iš Europos ir kitų šalių iš anksto įvykdyti pagrindines DI akte nustatytas pareigas. Be to, DI akto paslaugų centras taip pat teikia informaciją ir paramą, kad DI aktas būtų sklandžiai ir veiksmingai įgyvendinamas visoje ES.

Kodėl mums reikia dirbtinio intelekto taisyklių?

Dirbtinio intelekto aktu užtikrinama, kad europiečiai galėtų pasitikėti tuo, ką gali pasiūlyti dirbtinis intelektas. Nors dauguma DI sistemų nekelia jokios rizikos ir gali padėti spręsti daugelį visuomenės uždavinių, tam tikros DI sistemos kelia riziką, kurią turime šalinti, kad išvengtume nepageidaujamų pasekmių.

Pavyzdžiui, dažnai neįmanoma išsiaiškinti, kodėl DI sistema priėmė sprendimą arba prognozavo ir ėmėsi konkretaus veiksmo. Taigi gali būti sunku įvertinti, ar asmuo buvo nesąžiningai nepalankioje padėtyje, pavyzdžiui, priimant sprendimą dėl įdarbinimo arba teikiant paraišką dėl viešųjų išmokų sistemos.

Nors galiojančiuose teisės aktuose numatyta tam tikra apsauga, jos nepakanka konkretiems uždaviniams, kuriuos gali sukelti DI sistemos, spręsti.

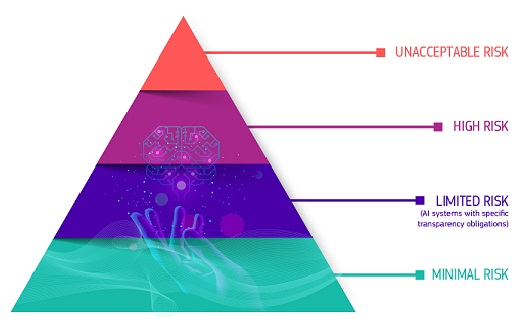

Rizika grindžiamas požiūris

DI akte apibrėžiami 4 DI sistemų rizikos lygiai:

Nepriimtina rizika

Visos DI sistemos, kurios laikomos keliančiomis akivaizdžią grėsmę žmonių saugumui, pragyvenimo šaltiniams ir teisėms, yra uždraustos. DI aktu draudžiamos aštuonios praktikos, t. y.:

- žalingas dirbtiniu intelektu grindžiamas manipuliavimas ir apgaulė

- žalingas dirbtiniu intelektu grindžiamas pažeidžiamumų išnaudojimas

- Socialiniai reitingai

- Atskiros nusikalstamos veikos rizikos vertinimas arba prognozė

- netikslinis interneto ar apsauginės vaizdo stebėjimo sistemos (AVSS) medžiagos nuskaitymas veido atpažinimo duomenų bazėms kurti ar plėsti;

- emocijų atpažinimas darbo vietose ir švietimo įstaigose;

- biometrinis skirstymas į kategorijas siekiant nustatyti tam tikras saugomas savybes

- tikralaikis nuotolinis biometrinis tapatybės nustatymas teisėsaugos tikslais viešosiose erdvėse

Draudimai įsigaliojo 2025 m. vasario mėn. Siekdama pagrįsti praktinį draudžiamos praktikos taikymą, Komisija paskelbė du pagrindinius dokumentus:

- Gairės dėl draudžiamos DI praktikos pagal DI aktą, kuriose pateikiami teisiniai paaiškinimai ir praktiniai pavyzdžiai, padedantys suinteresuotiesiems subjektams suprasti draudimus ir jų laikytis.

- DI akte pateiktos DI sistemos apibrėžties gairės, siekiant padėti suinteresuotiesiems subjektams nustatyti DI akto taikymo sritį

Didelė rizika

DI naudojimo atvejai, kurie gali kelti didelę riziką sveikatai, saugai ar pagrindinėms teisėms, priskiriami didelės rizikos atvejams. Šie didelės rizikos naudojimo atvejai apima:

- DI saugos komponentai ypatingos svarbos infrastruktūros objektuose (pvz., transporto), kurių gedimas galėtų kelti pavojų piliečių gyvybei ir sveikatai

- Švietimo įstaigose naudojami DI sprendimai, nuo kurių gali priklausyti galimybė gauti išsilavinimą ir asmens profesinio gyvenimo eiga (pvz., egzaminų vertinimas balais)

- Dirbtiniu intelektu grindžiami produktų saugos komponentai (pvz., dirbtinio intelekto taikymas robotizuotoje chirurgijoje)

- Dirbtinio intelekto priemonės užimtumui, darbuotojų valdymui ir galimybei dirbti savarankiškai (pvz., įdarbinimui skirta gyvenimo aprašymų rūšiavimo programinė įranga)

- Tam tikri DI naudojimo atvejai, kuriais suteikiama prieiga prie pagrindinių privačiųjų ir viešųjų paslaugų (pvz., kredito balai, nesuteikiantys piliečiams galimybės gauti paskolą)

- DI sistemos, naudojamos nuotoliniam biometriniam tapatybės nustatymui, emocijų atpažinimui ir biometriniam kategorizavimui (pvz., DI sistema, skirta krautuvininko tapatybei atgaline data nustatyti)

- DI naudojimo teisėsaugos srityje atvejai, kurie gali pažeisti pagrindines žmonių teises (pvz., įrodymų patikimumo vertinimas)

- DI naudojimo atvejai migracijos, prieglobsčio ir sienų kontrolės valdymo srityse (pvz., automatizuotas prašymų išduoti vizą nagrinėjimas)

- DI sprendimai, naudojami vykdant teisingumą ir demokratinius procesus (pvz., DI sprendimai, skirti teismo sprendimams rengti)

Didelės rizikos DI sistemoms taikomos griežtos pareigos prieš pateikiant jas rinkai:

- tinkamos rizikos vertinimo ir mažinimo sistemos

- aukštos kokybės duomenų rinkiniai, kuriais grindžiama sistema, siekiant kuo labiau sumažinti diskriminacinių rezultatų riziką;

- veiklos registravimas siekiant užtikrinti rezultatų atsekamumą

- išsamūs dokumentai, kuriuose pateikiama visa būtina informacija apie sistemą ir jos paskirtį, kad institucijos galėtų įvertinti jos atitiktį;

- aiški ir tinkama informacija diegėjui

- tinkamos žmogaus vykdomos priežiūros priemonės

- aukštas patikimumo, kibernetinio saugumo ir tikslumo lygis

Didelės rizikos DI taisyklės įsigalios 2026 m. rugpjūčio mėn. ir 2027 m. rugpjūčio mėn.

Skaidrumo rizika

Tai susiję su rizika, susijusia su dirbtinio intelekto naudojimo skaidrumo poreikiu. DI akte nustatytos konkrečios informacijos atskleidimo pareigos siekiant užtikrinti, kad žmonės būtų informuojami, kai to reikia pasitikėjimui išsaugoti. Pavyzdžiui, naudojant DI sistemas, pvz., pokalbių robotus, žmonės turėtų būti informuojami, kad sąveikauja su mašina, kad galėtų priimti informacija pagrįstą sprendimą.

Be to, generatyvinio DI tiekėjai turi užtikrinti, kad DI sukurtas turinys būtų atpažįstamas. Be to, tam tikras DI sukurtas turinys turėtų būti aiškiai ir matomai paženklintas, t. y. sintetinė vaizdakaita ir paskelbtas tekstas, siekiant informuoti visuomenę viešojo intereso klausimais.

Dirbtinio intelekto akte nustatytos skaidrumo taisyklės įsigalios 2026 m. rugpjūčio mėn.

Minimali rizika arba jokios rizikos

DI akte nenustatytos taisyklės dėl DI, kuris laikomas minimaliu arba nekeliančiu jokios rizikos. Šiai kategorijai priskiriama didžioji dauguma šiuo metu ES naudojamų DI sistemų. Tai apima programas, pvz., DI valdomus vaizdo žaidimus arba brukalų filtrus.

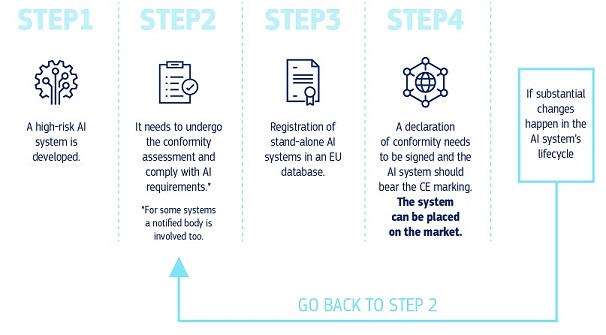

Kaip visa tai praktiškai veikia didelės rizikos DI sistemų tiekėjams?

Kai DI sistema pateikiama rinkai, už rinkos priežiūrą yra atsakingos institucijos, diegėjai užtikrina žmogaus vykdomą priežiūrą ir stebėseną, o tiekėjai yra įdiegę stebėsenos po pateikimo rinkai sistemą. Tiekėjai ir diegėjai taip pat praneš apie rimtus incidentus ir veikimo sutrikimus.

Kokios yra bendrosios paskirties DI modelių taisyklės?

Bendrosios paskirties DI modeliai gali atlikti įvairias užduotis ir tampa daugelio DI sistemų ES pagrindu. Kai kurie iš šių modelių gali kelti sisteminę riziką, jei jie yra labai pajėgūs arba plačiai naudojami. Siekiant užtikrinti saugų ir patikimą DI, DI aktu nustatomos taisyklės tokių modelių tiekėjams. Tai apima skaidrumą ir su autorių teisėmis susijusias taisykles. Modelių, kurie gali kelti sisteminę riziką, atveju teikėjai turėtų įvertinti ir sumažinti šią riziką. DI akto taisyklės dėl GPAI įsigaliojo 2025 m. rugpjūčio mėn.

Reikalavimų laikymosi rėmimas

2025 m. liepos mėn. Komisija paskelbė 3 pagrindines priemones, kuriomis remiamas atsakingas GPAI modelių kūrimas ir diegimas:

- Gairėse dėl GPAI modelių tiekėjų pareigų taikymo srities paaiškinama GPAI pareigų pagal DI aktą taikymo sritis, padedant DI vertės grandinės dalyviams suprasti, kas turi laikytis šių pareigų.

- GPAI praktikos kodeksas yra savanoriška atitikties užtikrinimo priemonė, kurią Komisijai teikia nepriklausomi ekspertai ir kurioje pateikiamos praktinės gairės, padedančios tiekėjams vykdyti savo pareigas pagal DI aktą, susijusias su skaidrumu, autorių teisėmis ir sauga bei saugumu.

- GPAI modelių mokymo turinio viešos santraukos šablone reikalaujama, kad teikėjai pateiktų savo modeliams mokyti naudojamų duomenų apžvalgą. Tai apima šaltinius, iš kurių buvo gauti duomenys (įskaitant didelius duomenų rinkinius ir geriausius domenų vardus). Šablone taip pat prašoma informacijos apie duomenų tvarkymo aspektus, kad teisėtų interesų turinčios šalys galėtų naudotis savo teisėmis pagal ES teisę.

Šie įrankiai skirti dirbti ranka rankon. Kartu jos suteikia aiškią ir įgyvendinamą sistemą, kad GPAI modelių tiekėjai galėtų laikytis DI akto, sumažinti administracinę naštą ir skatinti inovacijas, kartu apsaugant pagrindines teises ir visuomenės pasitikėjimą.

Komisija taip pat rengia kitas pagalbines priemones, kuriose pateikiamos gairės, kaip laikytis DI akto skaidrumo taisyklių:

- DI tarnybos pasirinktas DI sukurto turinio žymėjimo ir ženklinimo praktikos kodeksas. Kodeksas bus savanoriška priemonė, padėsianti generatyvinio DI sistemų tiekėjams ir diegėjams laikytis skaidrumo pareigų. Tai apima DI sukurto turinio žymėjimą ir dirbtinio vaizdų pobūdžio atskleidimą, taip pat garso (įskaitant sintetinę vaizdakaitą) ir teksto atskleidimą.

- Skaidrių DI sistemų gairės, kuriose paaiškinama taikymo sritis, atitinkamos teisinės apibrėžtys, skaidrumo pareigos, išimtys ir susiję horizontalieji klausimai.

Šios paramos priemonės šiuo metu rengiamos ir bus paskelbtos 2026 m. antrąjį ketvirtį. Sužinokite daugiau, kaip DI tarnyba padeda įgyvendinti DI aktą.

Valdymas ir įgyvendinimas

Europos DI tarnyba ir valstybių narių institucijos yra atsakingos už DI akto įgyvendinimą, priežiūrą ir vykdymo užtikrinimą. DI valdyba, mokslinė grupė ir patariamasis forumas vadovauja DI akto valdymui ir jį konsultuoja. Daugiau informacijos apie DI akto valdymą ir vykdymo užtikrinimą.

Paraiškų teikimo tvarkaraštis

DI aktas įsigaliojo 2024 m. rugpjūčio 1 d. ir bus visapusiškai taikomas po dvejų metų – 2026 m. rugpjūčio 2 d., išskyrus kai kurias išimtis:

- draudžiama DI praktika ir DI raštingumo pareigos, pradėtos taikyti nuo 2025 m. vasario 2 d.

- GPAI modelių valdymo taisyklės ir pareigos pradėtos taikyti 2025 m. rugpjūčio 2 d.

- didelės rizikos DI sistemoms, įterptoms į reglamentuojamus gaminius, taikomas pereinamasis laikotarpis pratęstas iki 2027 m. rugpjūčio 2 d.;

Koks yra Komisijos pasiūlymas supaprastinti DI akto įgyvendinimą?

Skaitmeninio supaprastinimo dokumentų rinkinyje siūlomi pakeitimai, kuriais siekiama supaprastinti DI akto įgyvendinimą ir užtikrinti, kad taisyklės išliktų aiškios, paprastos ir palankios inovacijoms.

Komisija siūlo pakoreguoti didelės rizikos taisyklių taikymo tvarkaraštį, kad jis būtų ne ilgesnis kaip 16 mėnesių. Taip užtikrinama, kad taisyklės būtų taikomos, kai įmonės turi tinkamas paramos priemones įgyvendinimui palengvinti, pavyzdžiui, standartus.

Komisija taip pat siūlo tikslinius DI akto pakeitimus, kuriais:

- stiprinti DI tarnybos įgaliojimus ir centralizuoti DI sistemų, grindžiamų bendrosios paskirties DI modeliais, priežiūrą, mažinant valdymo susiskaidymą;

- išplėsti tam tikrus MVĮ ir MVĮ taikomus supaprastinimus, įskaitant supaprastintus techninės dokumentacijos reikalavimus;

- reikalauti, kad Komisija ir valstybės narės skatintų raštingumą DI srityje ir užtikrintų nuolatinę paramą įmonėms, remdamosi esamomis pastangomis (pvz., neseniai atnaujinta DI biuro raštingumo DI srityje praktikos saugykla), kartu išlaikydamos didelės rizikos diegėjų mokymo pareigas;

- išplėsti priemones, kuriomis remiamas reikalavimų laikymasis, kad daugiau novatorių galėtų pasinaudoti bandomąja reglamentavimo aplinka, kuri bus sukurta nuo 2028 m., ir išplėsti bandymų realiomis sąlygomis galimybes;

- Pakoreguoti DI akto procedūras, kad būtų paaiškinta jo sąveika su kitais teisės aktais ir pagerintas jo bendras įgyvendinimas ir veikimas.

Visa tai papildo veiksmus, kurių Komisija ir jos DI biuras jau imasi, kad suteiktų aiškumo įmonėms ir nacionalinėms institucijoms, pavyzdžiui, parengdami gaires, praktikos kodeksus ir DI akto paslaugų centrą.

Pasiūlymas dėl teisėkūros procedūra priimamo akto priimtas lapkričio 19 d. Europos Parlamentas ir ES Taryba šiuo metu svarsto DI skaitmeninį omnibusą ir dėl jo derasi.

Naujausios naujienos

Ataskaita / tyrimas

- 07-04-2026Dirbtinis intelektas širdies ir kraujagyslių priežiūroje: nuo pažado iki praktikos

- 17-03-2026Study on Artificial Intelligence in healthcare dissects digital health technologies in Europe

- 01-12-2025Tyrimas. Kita duomenų riba: generatyvinis DI, atitiktis teisės aktams ir tarptautiniai aspektai

Faktų suvestinė / infografikas

Daugiau šia tema

Bendras vaizdas

Išsamiau

-

Europos DI tarnyba ir nacionalinės rinkos priežiūros institucijos yra atsakingos už DI akto...

-

Komisija siekia padidinti DI ekspertų skaičių mokydama ir pritraukdama daugiau tyrėjų ir specialistų...

-

Darnieji standartai suteiks teisinio tikrumo pagal DI aktą, rems inovacijas ir padės ES nustatyti...

-

Dirbtinio intelekto akto pranešėjų priemonė suteikia asmenims galimybę saugiai pateikti ataskaitą ir...