Regulamentul privind IA este primul cadru juridic privind IA, care abordează riscurile IA și poziționează Europa pentru a juca un rol de lider la nivel mondial.

Regulamentul privind IA [Regulamentul (UE) 2024/1689 de stabilire a unor norme armonizate privind inteligența artificială] este primul cadru juridic cuprinzător privind IA la nivel mondial. Scopul normelor este de a promova o IA de încredere în Europa. Pentru orice întrebări referitoare la Regulamentul privind IA, consultați platforma unică de informații a Regulamentului privind IA.

Regulamentul privind IA stabilește norme bazate pe riscuri pentru dezvoltatorii și operatorii de IA în ceea ce privește utilizările specifice ale IA. Regulamentul privind IA face parte dintr-un pachet mai amplu de măsuri de politică menite să sprijine dezvoltarea unei IA de încredere, care include, de asemenea, Planul de acțiune pentru continentul IA, pachetul privind inovarea în domeniul IA și lansarea fabricilor de IA. Împreună, aceste măsuri garantează siguranța, drepturile fundamentale și IA centrată pe factorul uman și consolidează adoptarea, investițiile și inovarea în IA în întreaga UE.

Pentru a facilita tranziția către noul cadru de reglementare, Comisia a lansat Pactul privind IA, o inițiativă voluntară care urmărește să sprijine punerea în aplicare viitoare, să colaboreze cu părțile interesate și să invite furnizorii și implementatorii de IA din Europa și din afara acesteia să respecte în timp util principalele obligații prevăzute în Regulamentul privind IA. În paralel, Serviciul de asistență pentru Regulamentul privind IA oferă, de asemenea, informații și sprijin pentru o punere în aplicare armonioasă și eficace a Regulamentului privind IA în întreaga UE.

De ce avem nevoie de norme privind IA?

Regulamentul privind IA asigură faptul că europenii pot avea încredere în ceea ce are de oferit IA. Deși majoritatea sistemelor de IA prezintă riscuri limitate la zero și pot contribui la soluționarea multor provocări societale, anumite sisteme de IA creează riscuri pe care trebuie să le abordăm pentru a evita rezultatele nedorite.

De exemplu, adesea nu este posibil să se afle de ce un sistem de IA a luat o decizie sau o predicție și a luat o anumită măsură. Prin urmare, poate deveni dificil să se evalueze dacă o persoană a fost dezavantajată în mod inechitabil, cum ar fi într-o decizie de angajare sau într-o cerere pentru un sistem de interes public.

Deși legislația existentă oferă o anumită protecție, aceasta nu este suficientă pentru a aborda provocările specifice pe care le pot aduce sistemele de IA.

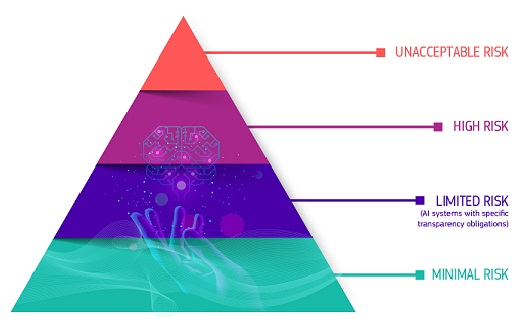

O abordare bazată pe riscuri

Regulamentul privind IA definește patru niveluri de risc pentru sistemele de IA:

Risc inacceptabil

Toate sistemele de IA considerate o amenințare clară la adresa siguranței, a mijloacelor de subzistență și a drepturilor persoanelor sunt interzise. Regulamentul privind IA interzice opt practici, și anume:

- manipulare și înșelăciune dăunătoare bazate pe IA

- exploatarea dăunătoare a vulnerabilităților bazată pe IA

- punctajul social

- Evaluarea sau anticiparea riscurilor legate de infracțiunile individuale

- răzuire nedirecționată a internetului sau a materialelor CCTV pentru a crea sau a extinde bazele de date de recunoaștere facială

- Recunoașterea emoțiilor la locul de muncă și în instituțiile de învățământ

- clasificarea biometrică pentru a deduce anumite caracteristici protejate

- identificarea biometrică la distanță în timp real în scopul asigurării respectării legii în spațiile accesibile publicului

Interdicțiile au intrat în vigoare în februarie 2025. Comisia a publicat două documente-cheie pentru a sprijini aplicarea practică a practicilor interzise:

- Orientările privind practicile de IA interzise în temeiul Regulamentului privind IA, care oferă explicații juridice și exemple practice pentru a ajuta părțile interesate să înțeleagă și să respecte interdicțiile.

- Orientările privind definirea sistemului de IA din Regulamentul privind IA, pentru a ajuta părțile interesate să stabilească domeniul de aplicare al Regulamentului privind IA

Risc ridicat

Cazurile de utilizare a IA care pot prezenta riscuri grave pentru sănătate, siguranță sau drepturile fundamentale sunt clasificate ca prezentând un grad ridicat de risc. Printre aceste cazuri de utilizare cu risc ridicat se numără:

- Componentele de siguranță ale IA în infrastructurile critice (de exemplu, transporturi), a căror defectare ar putea pune în pericol viața și sănătatea cetățenilor

- Soluții de IA utilizate în instituțiile de învățământ, care pot determina accesul la educație și parcursul vieții profesionale a unei persoane (de exemplu, notarea examenelor)

- Componentele de siguranță ale produselor bazate pe IA (de exemplu, aplicația IA în chirurgia asistată de robot)

- Instrumente de IA pentru ocuparea forței de muncă, gestionarea lucrătorilor și accesul la activități independente (de exemplu, software de sortare a CV-urilor pentru recrutare)

- Anumite cazuri de utilizare a IA utilizate pentru a oferi acces la servicii publice și private esențiale (de exemplu, notarea creditelor care le refuză cetățenilor posibilitatea de a obține un împrumut)

- Sisteme de IA utilizate pentru identificarea biometrică la distanță, recunoașterea emoțiilor și clasificarea biometrică (de exemplu, sistemul de IA pentru identificarea retroactivă a unui hoț din magazine)

- Cazuri de utilizare a IA în asigurarea respectării legii care pot interfera cu drepturile fundamentale ale persoanelor (de exemplu, evaluarea fiabilității probelor)

- Cazuri de utilizare a IA în gestionarea migrației, a azilului și a controlului la frontiere (de exemplu, examinarea automată a cererilor de viză)

- Soluții de IA utilizate în administrarea justiției și a proceselor democratice (de exemplu, soluții de IA pentru pregătirea hotărârilor judecătorești)

Sistemele de IA cu grad ridicat de risc fac obiectul unor obligații stricte înainte de a putea fi introduse pe piață:

- sisteme adecvate de evaluare și atenuare a riscurilor

- calitatea ridicată a seturilor de date care alimentează sistemul pentru a reduce la minimum riscurile de rezultate discriminatorii

- înregistrarea activității pentru a asigura trasabilitatea rezultatelor

- documentația detaliată care furnizează toate informațiile necesare privind sistemul și scopul acestuia pentru ca autoritățile să evalueze conformitatea acestuia

- informații clare și adecvate pentru implementator

- măsuri adecvate de supraveghere umană

- nivel ridicat de robustețe, securitate cibernetică și precizie

Normele privind IA cu grad ridicat de risc vor intra în vigoare în august 2026 și august 2027.

Riscul de transparență

Aceasta se referă la riscurile asociate cu nevoia de transparență în ceea ce privește utilizarea IA. Regulamentul privind IA introduce obligații specifice de divulgare pentru a se asigura că oamenii sunt informați atunci când este necesar pentru a menține încrederea. De exemplu, atunci când se utilizează sisteme de IA, cum ar fi roboții de chat, oamenii ar trebui să fie conștienți de faptul că interacționează cu o mașină, astfel încât să poată lua o decizie în cunoștință de cauză.

În plus, furnizorii de IA generativă trebuie să se asigure că conținutul generat de IA este identificabil. În plus, anumite conținuturi generate de IA ar trebui să fie etichetate în mod clar și vizibil, și anume deepfake-urile și textul publicat cu scopul de a informa publicul cu privire la chestiuni de interes public.

Normele privind transparența din Regulamentul privind IA vor intra în vigoare în august 2026.

Risc minim sau inexistent

Regulamentul privind IA nu introduce norme pentru IA care să fie considerate ca prezentând un risc minim sau să nu prezinte niciun risc. Marea majoritate a sistemelor de IA utilizate în prezent în UE se încadrează în această categorie. Printre acestea se numără aplicații precum jocurile video bazate pe IA sau filtrele de spam.

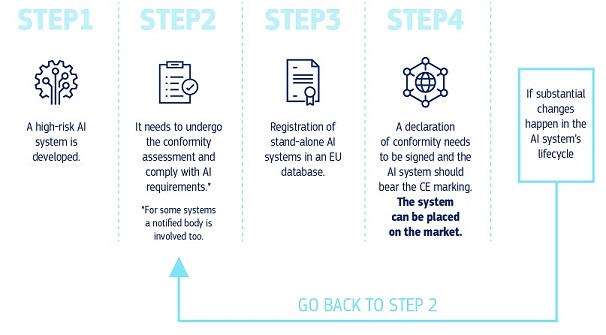

Cum funcționează toate acestea în practică pentru furnizorii de sisteme de IA cu grad ridicat de risc?

Odată ce un sistem de IA este pe piață, autoritățile sunt responsabile de supravegherea pieței, implementatorii asigură supravegherea și monitorizarea umană, iar furnizorii dispun de un sistem de monitorizare ulterioară introducerii pe piață. Furnizorii și operatorii vor raporta, de asemenea, incidentele grave și disfuncționalitățile.

Care sunt normele pentru modelele de IA de uz general?

Modelele de IA de uz general (GPAI) pot îndeplini o gamă largă de sarcini și devin baza multor sisteme de IA din UE. Unele dintre aceste modele ar putea prezenta riscuri sistemice dacă sunt foarte capabile sau utilizate pe scară largă. Pentru a asigura o IA sigură și de încredere, Regulamentul privind IA instituie norme pentru furnizorii de astfel de modele. Aceasta include norme privind transparența și drepturile de autor. Pentru modelele care pot prezenta riscuri sistemice, furnizorii ar trebui să evalueze și să atenueze aceste riscuri. Normele Regulamentului privind IA referitoare la GPAI au intrat în vigoare în august 2025.

Susținerea conformității

În iulie 2025, Comisia a publicat 3 instrumente-cheie pentru a sprijini dezvoltarea și implementarea responsabilă a modelelor GPAI:

- Orientările privind domeniul de aplicare al obligațiilor furnizorilor de modele GPAI clarifică domeniul de aplicare al obligațiilor GPAI în temeiul Regulamentului privind IA, ajutând actorii de-a lungul lanțului valoric al IA să înțeleagă cine trebuie să respecte aceste obligații.

- Codul de bune practici al GPAI este un instrument voluntar de asigurare a conformității prezentat Comisiei de către experți independenți, care oferă orientări practice pentru a ajuta furnizorii să își respecte obligațiile care le revin în temeiul Legii privind IA în ceea ce privește transparența, drepturile de autor și siguranța și securitatea.

- Modelul pentru rezumatul public al conținutului de formare al modelelor GPAI impune furnizorilor să ofere o imagine de ansamblu a datelor utilizate pentru formarea modelelor lor. Aceasta include sursele din care au fost obținute datele (cuprinzând seturi mari de date și nume de domenii principale). Modelul solicită, de asemenea, informații cu privire la aspectele legate de prelucrarea datelor pentru a permite părților cu interese legitime să își exercite drepturile în temeiul legislației UE.

Aceste instrumente sunt concepute pentru a lucra mână în mână. Împreună, acestea oferă un cadru clar și aplicabil pentru ca furnizorii de modele GPAI să respecte Regulamentul privind IA, reducând sarcina administrativă și promovând inovarea, protejând în același timp drepturile fundamentale și încrederea publicului.

Comisia dezvoltă, de asemenea, alte instrumente de sprijin care oferă orientări cu privire la modul de respectare a normelor de transparență ale Regulamentului privind IA:

- Codul de bune practici privind marcarea și etichetarea conținutului generat de IA selectat de Oficiul pentru IA. Codul va fi un instrument voluntar pentru a ghida furnizorii și operatorii de sisteme de IA generativă să respecte obligațiile în materie de transparență. Printre acestea se numără marcarea conținutului generat de IA și dezvăluirea naturii artificiale a imaginilor și a conținutului audio (inclusiv deepfake), precum și a textului.

- Orientările privind sistemele de IA transparente pentru a clarifica domeniul de aplicare, definițiile juridice relevante, obligațiile în materie de transparență, excepțiile și aspectele orizontale conexe.

Aceste instrumente de sprijin sunt în curs de pregătire și vor fi publicate în al doilea trimestru al anului 2026. Aflați mai multe despre modul în care Oficiul pentru IA sprijină punerea în aplicare a Regulamentului privind IA.

Guvernanță și punere în aplicare

Oficiul European pentru IA și autoritățile statelor membre sunt responsabile de punerea în aplicare, supravegherea și asigurarea respectării Regulamentului privind IA. Comitetul pentru IA, grupul științific și forumul consultativ orientează și consiliază guvernanța Regulamentului privind IA. Aflați mai multe detalii despre guvernanța și asigurarea respectării Regulamentului privind IA.

Calendarul de aplicare

Regulamentul privind IA a intrat în vigoare la 1 august 2024 și va fi pe deplin aplicabil doi ani mai târziu, la 2 august 2026, cu unele excepții:

- practicile interzise în domeniul IA și obligațiile de alfabetizare în domeniul IA au intrat în vigoare la 2 februarie 2025

- normele de guvernanță și obligațiile pentru modelele GPAI au devenit aplicabile la 2 august 2025

- normele privind sistemele de IA cu grad ridicat de risc – integrate în produsele reglementate – au o perioadă de tranziție prelungită până la 2 august 2027

Care este propunerea Comisiei de simplificare a punerii în aplicare a Regulamentului privind IA?

Pachetul digital privind simplificarea propune modificări pentru a simplifica punerea în aplicare a Regulamentului privind IA și pentru a se asigura că normele rămân clare, simple și favorabile inovării.

Comisia propune ajustarea calendarului de aplicare a normelor privind riscurile ridicate la maximum 16 luni. Acest lucru asigură faptul că normele se aplică atunci când întreprinderile dispun de instrumentele de sprijin adecvate pentru a facilita punerea în aplicare, cum ar fi standardele.

Comisia propune, de asemenea, modificări specifice ale Regulamentului privind IA, care:

- consolidarea competențelor Oficiului pentru IA și centralizarea supravegherii sistemelor de IA bazate pe modele de IA de uz general, reducând fragmentarea guvernanței;

- Extinderea anumitor simplificări acordate IMM-urilor și țărilor sud-mediteraneene, inclusiv a cerințelor simplificate privind documentația tehnică;

- să solicite Comisiei și statelor membre să promoveze alfabetizarea în domeniul IA și să asigure un sprijin continuu pentru întreprinderi, bazându-se pe eforturile existente (cum ar fi registrul Oficiului pentru IA de practici în materie de alfabetizare în domeniul IA, revizuit recent), menținând în același timp obligațiile de formare pentru implementatorii cu grad ridicat de risc;

- extinderea măsurilor de sprijinire a conformității, astfel încât mai mulți inovatori să poată beneficia de spațiile de testare în materie de reglementare care vor fi instituite începând cu 2028 și prin extinderea posibilităților de testare în condiții reale;

- Ajustarea procedurilor Regulamentului privind IA pentru a clarifica interacțiunea sa cu alte legi și pentru a îmbunătăți punerea în aplicare și funcționarea generală a acestuia.

Toate acestea completează acțiunile pe care Comisia și Oficiul său pentru IA le întreprind deja pentru a oferi claritate întreprinderilor și autorităților naționale, de exemplu prin orientări, coduri de practică și Serviciul de asistență pentru Regulamentul privind IA.

Propunerea legislativă a fost adoptată la 19 noiembrie. Parlamentul European și Consiliul UE discută și negociază în prezent Omnibusul digital privind IA.

Ultimele știri

Politică și legislație

Raport/Studiu

- 07-04-2026Inteligența artificială în îngrijirea cardiovasculară: de la promisiune la practică

- 17-03-2026Studiu privind inteligența artificială în domeniul asistenței medicale disecă tehnologiile digitale în domeniul sănătății în Europa

- 01-12-2025Studiu – următoarea frontieră a datelor: IA generativă, conformitatea cu reglementările și dimensiunile internaționale

Fișă informativă/Infografic

Conținut asociat

Imaginea de ansamblu

Aprofundați subiectul

-

Oficiul European pentru IA și autoritățile naționale de supraveghere a pieței sunt responsabile de...

-

Comisia urmărește să crească numărul de experți în domeniul IA prin formarea și atragerea unui număr...

-

Standardele armonizate vor oferi securitate juridică în temeiul Regulamentului privind IA, vor...

-

Instrumentul pentru avertizorii de integritate din cadrul Legii privind IA le permite persoanelor...