O Regulamento Inteligência Artificial é o primeiro quadro jurídico em matéria de IA, que aborda os riscos da IA e posiciona a Europa para desempenhar um papel de liderança a nível mundial.

O Regulamento Inteligência Artificial (Regulamento (UE) 2024/1689 que estabelece regras harmonizadas em matéria de inteligência artificial) é o primeiro quadro jurídico abrangente em matéria de IA a nível mundial. O objetivo das regras é promover uma IA de confiança na Europa. Para quaisquer perguntas sobre o Regulamento Inteligência Artificial, consulte a plataforma de informação única do Regulamento Inteligência Artificial.

O Regulamento Inteligência Artificial estabelece regras baseadas no risco para os criadores e responsáveis pela implantação da IA no que diz respeito a utilizações específicas da IA. O Regulamento Inteligência Artificial faz parte de um pacote mais vasto de medidas políticas destinadas a apoiar o desenvolvimento de uma IA de confiança, que inclui também o Plano de Ação para o Continente da IA, o pacote de inovação no domínio da IA e o lançamento de fábricas de IA. Em conjunto, estas medidas garantem a segurança, os direitos fundamentais e uma IA centrada no ser humano e reforçam a adoção, o investimento e a inovação no domínio da IA em toda a UE.

A fim de facilitar a transição para o novo quadro regulamentar, a Comissão lançou o Pacto para a IA, uma iniciativa voluntária que procura apoiar a futura aplicação, dialogar com as partes interessadas e convidar os fornecedores e responsáveis pela implantação de IA da Europa e de outros países a cumprirem antecipadamente as principais obrigações do Regulamento Inteligência Artificial. Paralelamente, o serviço de assistência do Regulamento Inteligência Artificial também presta informações e apoio para uma aplicação harmoniosa e eficaz do Regulamento Inteligência Artificial em toda a UE.

Por que razão precisamos de regras em matéria de IA?

O Regulamento Inteligência Artificial garante que os europeus podem confiar no que a IA tem para oferecer. Embora a maioria dos sistemas de IA represente um risco limitado a zero e possa contribuir para resolver muitos desafios societais, determinados sistemas de IA criam riscos que temos de enfrentar para evitar resultados indesejáveis.

Por exemplo, muitas vezes não é possível descobrir por que razão um sistema de IA tomou uma decisão ou uma previsão e tomou uma determinada ação. Assim, pode tornar-se difícil avaliar se alguém foi injustamente prejudicado, como numa decisão de contratação ou num pedido de um regime de benefícios públicos.

Embora a legislação em vigor proporcione alguma proteção, é insuficiente para dar resposta aos desafios específicos que os sistemas de IA podem trazer.

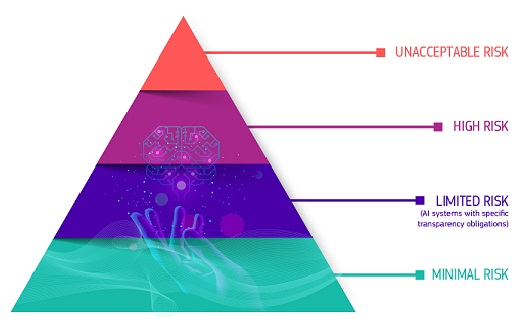

Uma abordagem baseada no risco

O Regulamento Inteligência Artificial define quatro níveis de risco para os sistemas de IA:

Risco inaceitável

Todos os sistemas de IA considerados uma clara ameaça à segurança, aos meios de subsistência e aos direitos das pessoas são proibidos. O Regulamento Inteligência Artificial proíbe oito práticas, a saber:

- manipulação e engano prejudiciais baseados na IA

- exploração nociva das vulnerabilidades com base na IA

- pontuação social

- Avaliação ou previsão do risco de infração penal individual

- Raspagem não direcionada da Internet ou de material de CCTV para criar ou expandir bases de dados de reconhecimento facial

- reconhecimento de emoções nos locais de trabalho e nas instituições de ensino

- categorização biométrica para deduzir determinadas características protegidas

- identificação biométrica à distância em tempo real para efeitos de aplicação da lei em espaços acessíveis ao público

As proibições entraram em vigor em fevereiro de 2025. A Comissão publicou dois documentos fundamentais para apoiar a aplicação prática das práticas proibidas:

- As orientações sobre práticas de IA proibidas ao abrigo do Regulamento Inteligência Artificial, que oferecem explicações jurídicas e exemplos práticos para ajudar as partes interessadas a compreender e cumprir as proibições.

- Orientações sobre a definição de sistema de IA do Regulamento Inteligência Artificial, a fim de ajudar as partes interessadas a determinar o âmbito de aplicação do Regulamento Inteligência Artificial

Risco elevado

Os casos de utilização da IA que podem representar riscos graves para a saúde, a segurança ou os direitos fundamentais são classificados como de risco elevado. Estes casos de uso de alto risco incluem:

- Componentes de segurança da IA em infraestruturas críticas (por exemplo, transportes), cuja falha pode pôr em risco a vida e a saúde dos cidadãos

- Soluções de IA utilizadas em instituições de ensino, que podem determinar o acesso à educação e ao percurso da vida profissional de alguém (por exemplo, pontuação dos exames)

- Componentes de segurança de produtos baseados na IA (por exemplo, aplicação de IA em cirurgia assistida por robôs)

- Ferramentas de IA para o emprego, a gestão dos trabalhadores e o acesso ao trabalho por conta própria (por exemplo, software de seleção de CV para recrutamento)

- Determinados casos de utilização da IA utilizados para dar acesso a serviços públicos e privados essenciais (por exemplo, pontuação de crédito que nega aos cidadãos a oportunidade de obter um empréstimo)

- Sistemas de IA utilizados para a identificação biométrica à distância, o reconhecimento de emoções e a categorização biométrica (por exemplo, sistema de IA para identificar retroativamente um assaltante de lojas)

- Casos de utilização da IA na aplicação da lei que possam interferir com os direitos fundamentais das pessoas (por exemplo, avaliação da fiabilidade das provas)

- Casos de utilização da IA na gestão da migração, do asilo e do controlo das fronteiras (por exemplo, análise automatizada de pedidos de visto)

- Soluções de IA utilizadas na administração da justiça e nos processos democráticos (por exemplo, soluções de IA para preparar decisões judiciais)

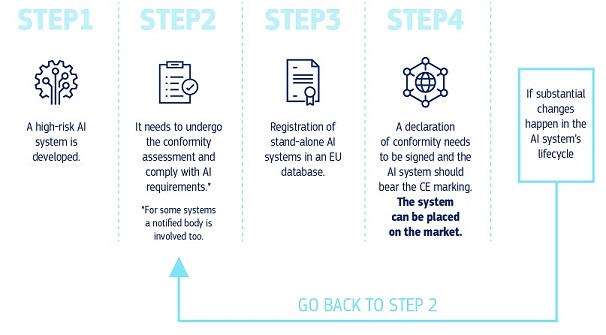

Os sistemas de IA de risco elevado estão sujeitos a obrigações rigorosas antes de poderem ser colocados no mercado:

- sistemas adequados de avaliação e atenuação dos riscos

- elevada qualidade dos conjuntos de dados que alimentam o sistema, a fim de minimizar os riscos de resultados discriminatórios

- registo da atividade para garantir a rastreabilidade dos resultados

- documentação pormenorizada que forneça todas as informações necessárias sobre o sistema e a sua finalidade para que as autoridades possam avaliar a sua conformidade

- informações claras e adequadas ao responsável pela implantação

- medidas adequadas de supervisão humana

- elevado nível de robustez, cibersegurança e exatidão

As regras para a IA de risco elevado entrarão em vigor em agosto de 2026 e agosto de 2027.

Risco de transparência

Trata-se dos riscos associados à necessidade de transparência em torno da utilização da IA. O Regulamento Inteligência Artificial introduz obrigações de divulgação específicas para assegurar que os seres humanos são informados sempre que necessário para preservar a confiança. Por exemplo, ao utilizar sistemas de IA como os robôs de conversação, os seres humanos devem ser sensibilizados para o facto de estarem a interagir com uma máquina, para que possam tomar uma decisão informada.

Além disso, os fornecedores de IA generativa têm de assegurar que os conteúdos gerados por IA são identificáveis. Além disso, determinados conteúdos gerados por IA devem ser rotulados de forma clara e visível, nomeadamente falsificações profundas e textos publicados com o objetivo de informar o público sobre questões de interesse público.

As regras de transparência do Regulamento Inteligência Artificial entrarão em vigor em agosto de 2026.

Risco mínimo ou nulo

O Regulamento Inteligência Artificial não introduz regras para a IA que sejam consideradas de risco mínimo ou nulo. A grande maioria dos sistemas de IA atualmente utilizados na UE insere-se nesta categoria. Tal inclui aplicações como jogos de vídeo com IA ativada ou filtros de spam.

Como funciona na prática para os fornecedores de sistemas de IA de risco elevado?

Uma vez que um sistema de IA esteja no mercado, as autoridades são responsáveis pela fiscalização do mercado, os responsáveis pela implantação asseguram a supervisão e o acompanhamento humanos e os fornecedores dispõem de um sistema de acompanhamento pós-comercialização. Os fornecedores e os responsáveis pela implantação também comunicarão incidentes graves e avarias.

Quais são as regras aplicáveis aos modelos de IA de finalidade geral?

Os modelos de IA de finalidade geral (GPAI) podem desempenhar uma vasta gama de tarefas e estão a tornar-se a base de muitos sistemas de IA na UE. Alguns destes modelos podem acarretar riscos sistémicos se forem muito capazes ou amplamente utilizados. A fim de garantir uma IA segura e fiável, o Regulamento Inteligência Artificial estabelece regras para os fornecedores desses modelos. Tal inclui regras em matéria de transparência e direitos de autor. No caso dos modelos que podem comportar riscos sistémicos, os prestadores devem avaliar e atenuar esses riscos. As regras do Regulamento Inteligência Artificial relativas à IA de finalidade geral entraram em vigor em agosto de 2025.

Apoio ao cumprimento

Em julho de 2025, a Comissão publicou três instrumentos fundamentais para apoiar o desenvolvimento e a implantação responsáveis de modelos de IA de finalidade geral:

- As orientações sobre o âmbito das obrigações dos fornecedores de modelos de IA de finalidade geral clarificam o âmbito das obrigações de IA de finalidade geral ao abrigo do Regulamento Inteligência Artificial, ajudando os intervenientes ao longo da cadeia de valor da IA a compreender quem deve cumprir estas obrigações.

- O Código de Conduta da GPAI é uma ferramenta de conformidade voluntária apresentada à Comissão por peritos independentes, que oferece orientações práticas para ajudar os prestadores a cumprir as obrigações que lhes incumbem por força do Regulamento Inteligência Artificial relacionadas com a transparência, os direitos de autor e a segurança &.

- O modelo para o resumo público dos conteúdos de formação dos modelos GPAI exige que os prestadores apresentem uma panorâmica dos dados utilizados para treinar os seus modelos. Tal inclui as fontes a partir das quais os dados foram obtidos (incluindo grandes conjuntos de dados e nomes de domínio de topo). O modelo também solicita informações sobre aspetos do tratamento de dados, a fim de permitir que as partes com interesses legítimos exerçam os seus direitos ao abrigo do direito da UE.

Estas ferramentas são projetadas para trabalhar de mãos dadas. Em conjunto, proporcionam um quadro claro e exequível para que os fornecedores de modelos de IA de finalidade geral cumpram o Regulamento Inteligência Artificial, reduzindo os encargos administrativos e promovendo a inovação, salvaguardando simultaneamente os direitos fundamentais e a confiança do público.

A Comissão está também a desenvolver outras ferramentas de apoio que oferecem orientações sobre a forma de cumprir as regras de transparência do Regulamento Inteligência Artificial:

- Código de Prática relativo à marcação e rotulagem de conteúdos gerados por IA selecionados pelo Serviço IA. O código será uma ferramenta voluntária para orientar os fornecedores e responsáveis pela implantação de sistemas de IA generativa no cumprimento das obrigações de transparência. Estes incluem a marcação de conteúdos gerados pela IA e a divulgação da natureza artificial das imagens, do áudio (incluindo falsificações profundas) e do texto.

- Orientações relativas a sistemas de IA transparentes para clarificar o âmbito de aplicação, as definições jurídicas pertinentes, as obrigações de transparência, as exceções e as questões horizontais conexas.

Estes instrumentos de apoio estão em preparação e serão publicados no segundo trimestre de 2026. Saiba mais sobre a forma como o Serviço para a IA está a apoiar a aplicação do Regulamento Inteligência Artificial.

Governação e execução

O Serviço Europeu para a IA e as autoridades dos Estados-Membros são responsáveis pela aplicação, supervisão e execução do Regulamento Inteligência Artificial. O Comité para a IA, o Painel Científico e o Fórum Consultivo orientam e aconselham a governação do Regulamento Inteligência Artificial. Mais informações sobre a governação e a aplicação do Regulamento Inteligência Artificial.

Calendário do pedido

O Regulamento Inteligência Artificial entrou em vigor em 1 de agosto de 2024 e será plenamente aplicável dois anos mais tarde, em 2 de agosto de 2026, com algumas exceções:

- as práticas de IA proibidas e as obrigações de literacia em IA entraram em vigor em 2 de fevereiro de 2025

- as regras de governação e as obrigações para os modelos GPAI tornaram-se aplicáveis em 2 de agosto de 2025

- as regras aplicáveis aos sistemas de IA de risco elevado — incorporados em produtos regulamentados — têm um período de transição alargado até 2 de agosto de 2027

Qual é a proposta da Comissão para simplificar a aplicação do Regulamento Inteligência Artificial?

O Pacote Digital para a Simplificação propõe alterações para simplificar a aplicação do Regulamento Inteligência Artificial e assegurar que as regras continuam a ser claras, simples e favoráveis à inovação.

A Comissão propõe ajustar o calendário para a aplicação das regras de risco elevado para um máximo de 16 meses. Tal garante que as regras se aplicam quando as empresas dispõem dos instrumentos de apoio adequados para facilitar a aplicação, como as normas.

A Comissão propõe igualmente alterações específicas ao Regulamento Inteligência Artificial que:

- Reforçar os poderes do Serviço para a IA e centralizar a supervisão dos sistemas de IA baseados em modelos de IA de finalidade geral, reduzindo a fragmentação da governação;

- Alargar determinadas simplificações concedidas às PME e aos PSM, incluindo requisitos simplificados em matéria de documentação técnica;

- Exigir que a Comissão e os Estados-Membros promovam a literacia em IA e assegurem um apoio contínuo às empresas, com base nos esforços existentes (como o repositório de práticas de literacia em IA do Serviço para a IA, recentemente renovado), mantendo simultaneamente em vigor obrigações de formação para os responsáveis pela implantação de alto risco;

- Alargar as medidas de apoio ao cumprimento, para que mais inovadores possam beneficiar dos ambientes de testagem da regulamentação que serão criados a partir de 2028 e alargando as possibilidades de realização de ensaios em condições reais;

- Ajustar os procedimentos do Regulamento Inteligência Artificial para clarificar a sua interação com outras leis e melhorar a sua aplicação e funcionamento globais.

Tudo isto complementa as ações que a Comissão e o seu Serviço para a IA já estão a tomar para proporcionar clareza às empresas e às autoridades nacionais, por exemplo, através de orientações, códigos de práticas e do serviço de assistência do Regulamento Inteligência Artificial.

A proposta legislativa foi adoptada em 19 de Novembro. O Parlamento Europeu e o Conselho da UE estão agora a debater e a negociar o Omnibus Digital sobre IA.

Últimas notícias

Relatório/estudo

- 07-04-2026Inteligência artificial nos cuidados cardiovasculares: da promessa à prática

- 17-03-2026Estudo sobre a inteligência artificial nos cuidados de saúde disseca tecnologias de saúde digitais na Europa

- 01-12-2025Estudo – a próxima fronteira dos dados: IA generativa, conformidade regulamentar e dimensões internacionais

Ficha de informação/infografia

Conteúdo relacionado

Visão geral

Em pormenor

-

O Serviço Europeu para a IA e as autoridades nacionais de fiscalização do mercado são responsáveis...

-

A Comissão pretende aumentar o número de peritos em IA, formando e atraindo mais investigadores e...

-

As normas harmonizadas proporcionarão segurança jurídica ao abrigo do Regulamento Inteligência...

-

O instrumento de denúncia do Regulamento Inteligência Artificial habilita as pessoas a apresentarem...