Akt o umjetnoj inteligenciji prvi je pravni okvir o umjetnoj inteligenciji koji se bavi rizicima umjetne inteligencije i postavlja Europu u vodeću ulogu na globalnoj razini.

Akt o umjetnoj inteligenciji (Uredba (EU) 2024/1689 o utvrđivanju usklađenih pravila o umjetnoj inteligenciji) prvi je sveobuhvatni pravni okvir za umjetnu inteligenciju u cijelom svijetu. Cilj je pravila poticati pouzdanu umjetnu inteligenciju u Europi. Za sva pitanja o Aktu o umjetnoj inteligenciji pogledajte jedinstvenu informacijsku platformu Akta o umjetnoj inteligenciji.

Aktom o umjetnoj inteligenciji utvrđuju se pravila koja se temelje na riziku za razvojne programere i subjekte koji uvode umjetnu inteligenciju u pogledu određenih uporaba umjetne inteligencije. Akt o umjetnoj inteligenciji dio je šireg paketa mjera politike za potporu razvoju pouzdane umjetne inteligencije, koji uključuje i Akcijski plan za kontinent umjetne inteligencije, Paket za inovacije u području umjetne inteligencije i pokretanje tvornica umjetne inteligencije. Tim se mjerama zajedno jamče sigurnost, temeljna prava i antropocentrična umjetna inteligencija te jačaju prihvaćanje, ulaganja i inovacije u području umjetne inteligencije u cijelom EU-u.

Kako bi olakšala prelazak na novi regulatorni okvir, Komisija je pokrenula Pakt o umjetnoj inteligenciji, dobrovoljnu inicijativu kojom se nastoji poduprijeti buduća provedba, surađivati s dionicima i pozvati dobavljače i subjekte koji primjenjuju umjetnu inteligenciju iz Europe i izvan nje da unaprijed ispune ključne obveze iz Akta o umjetnoj inteligenciji. Služba za podršku Aktu o umjetnoj inteligenciji istodobno pruža informacije i potporu za neometanu i učinkovitu provedbu Akta o umjetnoj inteligenciji u cijelom EU-u.

Zašto su nam potrebna pravila o umjetnoj inteligenciji?

Aktom o umjetnoj inteligenciji osigurava se da Europljani mogu vjerovati onome što umjetna inteligencija nudi. Iako većina UI sustava predstavlja ograničen rizik i može doprinijeti rješavanju mnogih društvenih izazova, određeni UI sustavi stvaraju rizike koje moramo ukloniti kako bismo izbjegli neželjene ishode.

Na primjer, često nije moguće saznati zašto je UI sustav donio odluku ili predvidio i poduzeo određenu mjeru. Stoga može biti teško procijeniti je li netko bio nepravedno u nepovoljnom položaju, primjerice u odluci o zapošljavanju ili u prijavi za sustav javnih naknada.

Iako postojeće zakonodavstvo pruža određenu zaštitu, ono nije dovoljno za rješavanje posebnih izazova koje UI sustavi mogu donijeti.

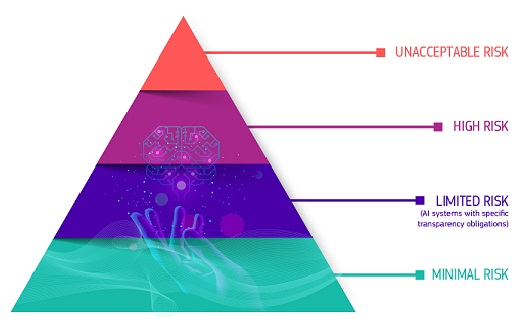

Pristup koji se temelji na riziku

Aktom o umjetnoj inteligenciji definirane su četiri razine rizika za UI sustave:

Neprihvatljiv rizik

Zabranjeni su svi UI sustavi koji se smatraju jasnom prijetnjom sigurnosti, sredstvima za život i pravima ljudi. Aktom o umjetnoj inteligenciji zabranjeno je osam praksi, a to su:

- štetna manipulacija i obmana koja se temelji na umjetnoj inteligenciji

- štetno iskorištavanje ranjivosti koje se temelji na umjetnoj inteligenciji

- Socijalno bodovanje

- Procjena ili predviđanje rizika od pojedinačnog kaznenog djela

- neciljano struganje internetskog ili CCTV materijala radi stvaranja ili proširenja baza podataka za prepoznavanje lica

- prepoznavanje emocija na radnim mjestima i u obrazovnim ustanovama

- biometrijska kategorizacija kako bi se izvele određene zaštićene značajke

- daljinska biometrijska identifikacija u stvarnom vremenu za potrebe kaznenog progona na javnim mjestima

Zabrane su stupile na snagu u veljači 2025. Komisija je objavila dva ključna dokumenta kojima se podupire praktična primjena zabranjenih praksi:

- Smjernice o zabranjenim praksama u području umjetne inteligencije u skladu s Aktom o umjetnoj inteligenciji, u kojima se navode pravna objašnjenja i praktični primjeri kako bi se dionicima pomoglo da razumiju zabrane i poštuju ih.

- Smjernice o definiciji UI sustava iz Akta o umjetnoj inteligenciji kako bi se dionicima pomoglo u utvrđivanju područja primjene Akta o umjetnoj inteligenciji

Visokorizični

Slučajevi upotrebe umjetne inteligencije koji mogu predstavljati ozbiljan rizik za zdravlje, sigurnost ili temeljna prava klasificiraju se kao visokorizični. Ti visokorizični slučajevi primjene uključuju:

- Sigurnosne komponente umjetne inteligencije u ključnim infrastrukturama (npr. promet), čiji bi neuspjeh mogao ugroziti život i zdravlje građana

- UI rješenja koja se upotrebljavaju u obrazovnim ustanovama, a koja mogu odrediti pristup obrazovanju i tijek nečijeg profesionalnog života (npr. bodovanje ispita)

- Sigurnosne komponente proizvoda koje se temelje na umjetnoj inteligenciji (npr. primjena umjetne inteligencije u kirurgiji uz pomoć robota)

- Alati umjetne inteligencije za zapošljavanje, upravljanje radnicima i pristup samozapošljavanju (npr. softver za razvrstavanje životopisa za zapošljavanje)

- Određeni slučajevi upotrebe umjetne inteligencije koji se upotrebljavaju za pružanje pristupa osnovnim privatnim i javnim uslugama (npr. kreditni bodovi kojima se građanima uskraćuje mogućnost dobivanja zajma)

- UI sustavi koji se upotrebljavaju za daljinsku biometrijsku identifikaciju, prepoznavanje emocija i biometrijsku kategorizaciju (npr. UI sustav za retroaktivnu identifikaciju trgovca)

- slučajevi upotrebe umjetne inteligencije u tijelima kaznenog progona koji mogu utjecati na temeljna prava ljudi (npr. evaluacija pouzdanosti dokaza)

- Primjeri upotrebe umjetne inteligencije u upravljanju migracijama, azilom i nadzorom državne granice (npr. automatizirano razmatranje zahtjeva za vizu)

- Rješenja umjetne inteligencije koja se upotrebljavaju u sudovanju i demokratskim procesima (npr. rješenja umjetne inteligencije za pripremu sudskih presuda)

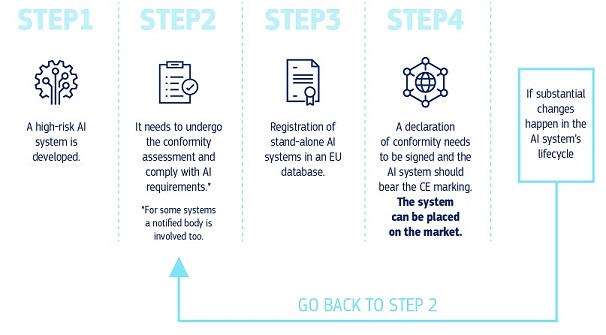

Visokorizični UI sustavi podliježu strogim obvezama prije nego što se mogu staviti na tržište:

- odgovarajući sustavi za procjenu i ublažavanje rizika

- visoka kvaliteta skupova podataka koji se unose u sustav kako bi se rizici od diskriminirajućih ishoda sveli na najmanju moguću mjeru

- bilježenje aktivnosti kako bi se osigurala sljedivost rezultata

- detaljna dokumentacija kojom se pružaju sve potrebne informacije o sustavu i njegovoj svrsi kako bi nadležna tijela mogla ocijeniti njegovu usklađenost

- jasne i odgovarajuće informacije subjektu koji uvodi sustav

- odgovarajuće mjere ljudskog nadzora

- visoka razina otpornosti, kibersigurnosti i točnosti

Pravila za visokorizičnu umjetnu inteligenciju stupit će na snagu u kolovozu 2026. i kolovozu 2027.

Rizik transparentnosti

To se odnosi na rizike povezane s potrebom za transparentnošću u pogledu upotrebe umjetne inteligencije. Aktom o umjetnoj inteligenciji uvode se posebne obveze objavljivanja kako bi se osiguralo da su ljudi informirani kada je to potrebno za očuvanje povjerenja. Na primjer, pri upotrebi UI sustava kao što su chatbotovi ljudi bi trebali biti svjesni da su u interakciji sa strojem kako bi mogli donijeti informiranu odluku.

Nadalje, dobavljači generativne umjetne inteligencije moraju osigurati da se sadržaj generiran umjetnom inteligencijom može identificirati. Povrh toga, određeni sadržaj stvoren umjetnom inteligencijom trebao bi biti jasno i vidljivo označen, odnosno uvjerljivi krivotvoreni sadržaj i tekst objavljen u svrhu informiranja javnosti o pitanjima od javnog interesa.

Pravila o transparentnosti Akta o umjetnoj inteligenciji stupit će na snagu u kolovozu 2026.

Minimalni rizik ili rizik bez rizika

Aktom o umjetnoj inteligenciji ne uvode se pravila za umjetnu inteligenciju koja se smatra minimalnom ili nikakvom. Velika većina UI sustava koji se trenutačno upotrebljavaju u EU-u pripada toj kategoriji. To uključuje aplikacije kao što su videoigre omogućene umjetnom inteligencijom ili filtri za neželjenu poštu.

Kako sve to funkcionira u praksi za dobavljače visokorizičnih UI sustava?

Nakon što se UI sustav stavi na tržište, tijela su zadužena za nadzor tržišta, subjekti koji uvode sustav osiguravaju ljudski nadzor i praćenje, a dobavljači imaju uspostavljen sustav praćenja nakon stavljanja na tržište. Dobavljači i subjekti koji uvode sustav također će prijaviti ozbiljne incidente i neispravnosti.

Koja su pravila za modele umjetne inteligencije opće namjene?

Modeli umjetne inteligencije opće namjene (GPAI) mogu obavljati širok raspon zadaća i postaju osnova za mnoge sustave umjetne inteligencije u EU-u. Neki od tih modela mogli bi nositi sistemske rizike ako su vrlo sposobni ili se u velikoj mjeri upotrebljavaju. Kako bi se osigurala sigurna i pouzdana umjetna inteligencija, Aktom o umjetnoj inteligenciji utvrđuju se pravila za dobavljače takvih modela. To uključuje pravila o transparentnosti i autorskom pravu. Kad je riječ o modelima koji mogu nositi sistemske rizike, pružatelji bi trebali procijeniti i ublažiti te rizike. Pravila iz Akta o umjetnoj inteligenciji o GPAI-ju stupila su na snagu u kolovozu 2025.

Potpora usklađenosti

Komisija je u srpnju 2025. objavila tri ključna instrumenta za potporu odgovornom razvoju i uvođenju modela GPAI-ja:

- U Smjernicama o području primjene obveza za dobavljače modela GPAI pojašnjava se područje primjene obveza GPAI-ja na temelju Akta o umjetnoj inteligenciji, čime se akterima u vrijednosnom lancu umjetne inteligencije pomaže da razumiju tko mora poštovati te obveze.

- Kodeks dobre prakse OZP-a dobrovoljni je alat za usklađivanje koji Komisiji podnose neovisni stručnjaci i koji nudi praktične smjernice kako bi se dobavljačima pomoglo da ispune svoje obveze iz Akta o umjetnoj inteligenciji koje se odnose na transparentnost, autorska prava te sigurnost i zaštitu.

- U predlošku za javni sažetak sadržaja osposobljavanja za modele GPAI-ja od pružatelja se zahtijeva da daju pregled podataka koji se upotrebljavaju za osposobljavanje njihovih modela. To uključuje izvore iz kojih su podaci dobiveni (koji obuhvaćaju velike skupove podataka i vrhunske nazive domena). U predlošku se traže i informacije o aspektima obrade podataka kako bi se stranama s legitimnim interesima omogućilo da ostvare svoja prava u skladu s pravom EU-a.

Ovi alati su dizajnirani za rad ruku pod ruku. Zajedno pružaju jasan i provediv okvir za usklađivanje pružatelja modela OZP-a s Aktom o umjetnoj inteligenciji, čime se smanjuje administrativno opterećenje i potiču inovacije uz istodobnu zaštitu temeljnih prava i povjerenja javnosti.

Komisija razvija i druge alate za potporu koji pružaju smjernice o tome kako se uskladiti s pravilima o transparentnosti iz Akta o umjetnoj inteligenciji:

- Kodeks dobre prakse za označivanje i označivanje sadržaja generiranog umjetnom inteligencijom koji je odabrao Ured za umjetnu inteligenciju. Kodeks će biti dobrovoljni alat za usmjeravanje dobavljača i subjekata koji uvode generativne UI sustave u ispunjavanju obveza transparentnosti. To uključuje označivanje sadržaja generiranog umjetnom inteligencijom i otkrivanje umjetne prirode slika te zvuka (uključujući uvjerljive krivotvorene sadržaje) i teksta.

- Smjernice o transparentnim UI sustavima kako bi se pojasnilo područje primjene, relevantne pravne definicije, obveze transparentnosti, iznimke i povezana horizontalna pitanja.

Ti su instrumenti potpore u pripremi i bit će objavljeni u drugom tromjesečju 2026. Saznajte više o tome kako Ured za umjetnu inteligenciju podupire provedbu Akta o umjetnoj inteligenciji.

Upravljanje i provedba

Europski ured za umjetnu inteligenciju i tijela država članica odgovorni su za provedbu, nadzor i provedbu Akta o umjetnoj inteligenciji. Odbor za umjetnu inteligenciju, Znanstveni odbor i Savjetodavni forum usmjeravaju i savjetuju upravljanje Aktom o umjetnoj inteligenciji. Saznajte više o upravljanju Aktom o umjetnoj inteligenciji i njegovoj provedbi.

Vremenski okvir primjene

Akt o umjetnoj inteligenciji stupio je na snagu 1. kolovoza 2024., a u potpunosti će se primjenjivati dvije godine kasnije, 2. kolovoza 2026., uz neke iznimke:

- zabranjene prakse u području umjetne inteligencije i obveze u pogledu pismenosti u području umjetne inteligencije počele su se primjenjivati od 2. veljače 2025.

- pravila upravljanja i obveze za modele GPAI-ja počeli su se primjenjivati 2. kolovoza 2025.

- pravila za visokorizične UI sustave ugrađene u regulirane proizvode imaju produljeno prijelazno razdoblje do 2. kolovoza 2027.

Koji je prijedlog Komisije za pojednostavnjenje provedbe Akta o umjetnoj inteligenciji?

U digitalnom paketu o pojednostavnjenju predlažu se izmjene kako bi se pojednostavnila provedba Akta o umjetnoj inteligenciji i osiguralo da pravila ostanu jasna, jednostavna i povoljna za inovacije.

Komisija predlaže da se vremenski okvir za primjenu visokorizičnih pravila prilagodi na najviše 16 mjeseci. Time se osigurava da se pravila primjenjuju kada poduzeća imaju odgovarajuće alate za potporu kako bi se olakšala provedba, kao što su standardi.

Komisija predlaže i ciljane izmjene Akta o umjetnoj inteligenciji kojima će se:

- ojačati ovlasti Ureda za umjetnu inteligenciju i centralizirati nadzor nad UI sustavima koji se temelje na UI modelima opće namjene, čime se smanjuje fragmentacija upravljanja;

- Proširiti određena pojednostavnjenja koja se dodjeljuju MSP-ovima i SMC-ovima, uključujući pojednostavnjene zahtjeve za tehničku dokumentaciju;

- zahtijevati od Komisije i država članica da promiču pismenost u području umjetne inteligencije i osiguraju stalnu potporu poduzećima na temelju postojećih napora (kao što je nedavno revidiran repozitorij praksi pismenosti u području umjetne inteligencije Ureda za umjetnu inteligenciju), uz zadržavanje obveza osposobljavanja za visokorizične subjekte koji uvode sustav;

- proširiti mjere za potporu usklađenosti kako bi više inovatora moglo imati koristi od regulatornih izoliranih okruženja koja će se uspostaviti od 2028. i proširenjem mogućnosti za testiranje u stvarnim uvjetima;

- Prilagoditi postupke Akta o umjetnoj inteligenciji kako bi se pojasnilo njegovo međudjelovanje s drugim zakonima i poboljšala njegova cjelokupna provedba i rad.

Sve to nadopunjuje mjere koje Komisija i njezin Ured za umjetnu inteligenciju već poduzimaju kako bi poduzećima i nacionalnim tijelima pružili jasnoću, primjerice smjernicama, kodeksima prakse i Službom za usluge Akta o umjetnoj inteligenciji.

Zakonodavni prijedlog donesen je 19. studenoga. Europski parlament i Vijeće EU-a sada raspravljaju i pregovaraju o Digitalnoj skupnoj uredbi o umjetnoj inteligenciji.

Najnovije vijesti

Izvješće/studija

- 07-04-2026Umjetna inteligencija u kardiovaskularnoj skrbi: od obećanja do prakse

- 17-03-2026Study on Artificial Intelligence in healthcare dissects digital health technologies in Europe

- 01-12-2025Studija – sljedeća granica podataka: generativna umjetna inteligencija, usklađenost s propisima i međunarodne dimenzije

Informativni članak / infografika

Povezani sadržaj

Šira slika

Dublji pogled

-

Europski ured za umjetnu inteligenciju i nacionalna tijela za nadzor tržišta odgovorni su za...

-

Komisija nastoji povećati broj stručnjaka za umjetnu inteligenciju osposobljavanjem i privlačenjem...

-

Usklađenim normama pružit će se pravna sigurnost na temelju Akta o umjetnoj inteligenciji...

-

Alat za zviždače iz Akta o umjetnoj inteligenciji omogućuje pojedincima da sigurno podnesu izvješće...