De AI-verordening is het allereerste rechtskader inzake AI, dat de risico’s van AI aanpakt en Europa in staat stelt wereldwijd een leidende rol te spelen.

De AI-verordening (Verordening (EU) 2024/1689 tot vaststelling van geharmoniseerde regels inzake artificiële intelligentie) is het allereerste alomvattende rechtskader inzake AI wereldwijd. Het doel van de regels is om betrouwbare AI in Europa te bevorderen. Voor vragen over de AI-verordening kunt u terecht op het Single Information-platform van de AI-verordening.

De AI-verordening bevat risicogebaseerde regels voor AI-ontwikkelaars en -exploitanten met betrekking tot specifieke toepassingen van AI. De AI-verordening maakt deel uit van een breder pakket beleidsmaatregelen ter ondersteuning van de ontwikkeling van betrouwbare AI, dat ook het AI-continentactieplan, het AI-innovatiepakket en de lancering van AI-fabrieken omvat. Samen garanderen deze maatregelen veiligheid, grondrechten en mensgerichte AI, en versterken zij de invoering, investeringen en innovatie in AI in de hele EU.

Om de overgang naar het nieuwe regelgevingskader te vergemakkelijken, heeft de Commissie het AI-pact gelanceerd, een vrijwillig initiatief dat tot doel heeft de toekomstige uitvoering te ondersteunen, samen te werken met belanghebbenden en aanbieders en exploitanten van AI uit Europa en daarbuiten uit te nodigen om van tevoren aan de belangrijkste verplichtingen van de AI-verordening te voldoen. Tegelijkertijd verstrekt de AI Act Service Desk ook informatie en ondersteuning voor een vlotte en doeltreffende uitvoering van de AI-verordening in de hele EU.

Waarom zijn er regels nodig voor AI?

De AI-verordening zorgt ervoor dat Europeanen kunnen vertrouwen op wat AI te bieden heeft. Hoewel de meeste AI-systemen beperkt zijn tot geen risico en kunnen bijdragen tot het oplossen van veel maatschappelijke uitdagingen, creëren bepaalde AI-systemen risico’s die we moeten aanpakken om ongewenste resultaten te voorkomen.

Het is bijvoorbeeld vaak niet mogelijk om erachter te komen waarom een AI-systeem een beslissing of voorspelling heeft genomen en een bepaalde actie heeft ondernomen. Het kan dus moeilijk worden om te beoordelen of iemand oneerlijk is benadeeld, zoals in een aanwervingsbesluit of in een aanvraag voor een regeling voor algemeen nut.

Hoewel de bestaande wetgeving enige bescherming biedt, is zij ontoereikend om de specifieke uitdagingen aan te pakken die AI-systemen met zich mee kunnen brengen.

Een risicogebaseerde aanpak

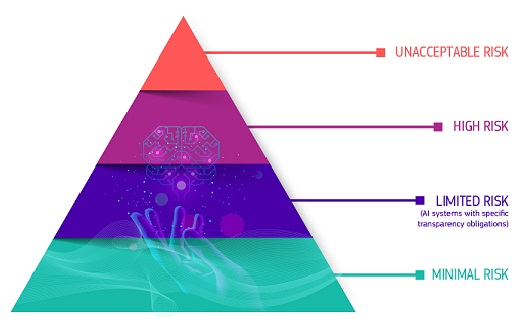

De AI-verordening definieert vier risiconiveaus voor AI-systemen:

Onaanvaardbaar risico

Alle AI-systemen die als een duidelijke bedreiging voor de veiligheid, het levensonderhoud en de rechten van mensen worden beschouwd, zijn verboden. De AI-verordening verbiedt acht praktijken, namelijk:

- schadelijke op AI gebaseerde manipulatie en misleiding

- schadelijke AI-gebaseerde exploitatie van kwetsbaarheden

- sociaal scoren

- Risicobeoordeling of voorspelling van individuele strafbare feiten

- ongericht schrapen van internet- of CCTV-materiaal om gezichtsherkenningsdatabases te maken of uit te breiden

- emotieherkenning op de werkplek en in onderwijsinstellingen

- biometrische categorisering om bepaalde beschermde kenmerken af te leiden

- biometrische identificatie op afstand in real time voor rechtshandhavingsdoeleinden in openbare ruimten

De verbodsbepalingen zijn in februari 2025 in werking getreden. De Commissie heeft twee belangrijke documenten gepubliceerd ter ondersteuning van de praktische toepassing van de verboden praktijken:

- De richtsnoeren inzake verboden AI-praktijken in het kader van de AI-verordening, die juridische uitleg en praktische voorbeelden bieden om belanghebbenden te helpen de verbodsbepalingen te begrijpen en na te leven.

- De richtsnoeren voor de definitie van AI-systemen van de AI-verordening, om belanghebbenden te helpen bij het bepalen van het toepassingsgebied van de AI-verordening

Hoog risico

AI-gebruiksgevallen die ernstige risico’s voor de gezondheid, de veiligheid of de grondrechten kunnen inhouden, worden geclassificeerd als gevallen met een hoog risico. Deze risicovolle use-cases omvatten:

- AI-veiligheidscomponenten in kritieke infrastructuur (bv. vervoer), waarvan het falen het leven en de gezondheid van burgers in gevaar zou kunnen brengen

- AI-oplossingen die in onderwijsinstellingen worden gebruikt en die de toegang tot onderwijs en het verloop van iemands beroepsleven kunnen bepalen (bv. scoren van examens)

- AI-gebaseerde veiligheidscomponenten van producten (bv. AI-toepassing bij robotchirurgie)

- AI-instrumenten voor werkgelegenheid, werknemersbeheer en toegang tot zelfstandige arbeid (bv. software voor het sorteren van cv’s voor aanwerving)

- Bepaalde AI-usecases die worden gebruikt om toegang te geven tot essentiële particuliere en openbare diensten (bv. kredietscores die burgers de mogelijkheid ontzeggen om een lening te verkrijgen)

- AI-systemen die worden gebruikt voor biometrische identificatie op afstand, emotieherkenning en biometrische categorisering (bv. AI-systeem om een winkeldief met terugwerkende kracht te identificeren)

- AI-gebruiksgevallen bij rechtshandhaving die de grondrechten van mensen kunnen aantasten (bv. evaluatie van de betrouwbaarheid van bewijsmateriaal)

- AI-gebruiksgevallen bij migratie-, asiel- en grenscontrolebeheer (bv. geautomatiseerde behandeling van visumaanvragen)

- AI-oplossingen die worden gebruikt bij de rechtsbedeling en democratische processen (bv. AI-oplossingen ter voorbereiding van rechterlijke uitspraken)

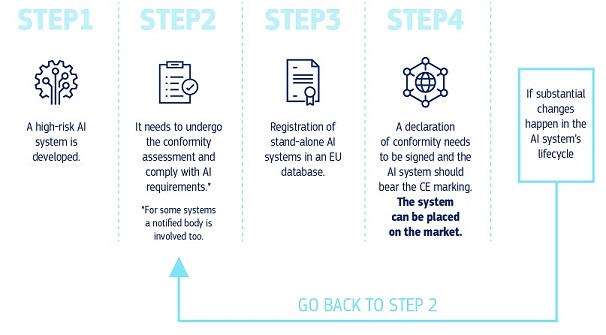

AI-systemen met een hoog risico zijn onderworpen aan strikte verplichtingen voordat zij in de handel kunnen worden gebracht:

- adequate systemen voor risicobeoordeling en -beperking

- hoge kwaliteit van de datasets die het systeem voeden om het risico op discriminerende uitkomsten tot een minimum te beperken

- registratie van activiteiten om de traceerbaarheid van de resultaten te waarborgen

- gedetailleerde documentatie met alle informatie die nodig is over het systeem en het doel ervan voor de autoriteiten om de conformiteit ervan te beoordelen

- duidelijke en adequate informatie voor de exploitant

- passende maatregelen voor menselijk toezicht

- hoge mate van robuustheid, cyberbeveiliging en nauwkeurigheid

De regels voor AI met een hoog risico worden van kracht in augustus 2026 en augustus 2027.

Transparantierisico

Dit verwijst naar de risico’s in verband met de behoefte aan transparantie rond het gebruik van AI. De AI-verordening voert specifieke openbaarmakingsverplichtingen in om ervoor te zorgen dat mensen worden geïnformeerd wanneer dat nodig is om het vertrouwen te behouden. Bij het gebruik van AI-systemen zoals chatbots moeten mensen er bijvoorbeeld op worden gewezen dat ze interactie hebben met een machine, zodat ze een weloverwogen beslissing kunnen nemen.

Bovendien moeten aanbieders van generatieve AI ervoor zorgen dat door AI gegenereerde inhoud identificeerbaar is. Bovendien moet bepaalde door AI gegenereerde inhoud duidelijk en zichtbaar worden geëtiketteerd, namelijk deepfakes en tekst die wordt gepubliceerd om het publiek te informeren over aangelegenheden van algemeen belang.

De transparantieregels van de AI-wet treden in augustus 2026 in werking.

Minimaal of geen risico

De AI-verordening bevat geen regels voor AI die als minimaal of geen risico worden beschouwd. De overgrote meerderheid van de AI-systemen die momenteel in de EU worden gebruikt, vallen in deze categorie. Dit omvat toepassingen zoals AI-compatibele videogames of spamfilters.

Hoe werkt het allemaal in de praktijk voor aanbieders van AI-systemen met een hoog risico?

Zodra een AI-systeem op de markt is, zijn de autoriteiten belast met markttoezicht, zorgen exploitanten voor menselijk toezicht en monitoring en beschikken aanbieders over een monitoringsysteem na het in de handel brengen. Aanbieders en exploitanten zullen ook ernstige incidenten en storingen melden.

Wat zijn de regels voor AI-modellen met een algemeen doel?

AI-modellen voor algemene doeleinden (GPAI) kunnen een breed scala aan taken uitvoeren en worden de basis voor veel AI-systemen in de EU. Sommige van deze modellen kunnen systeemrisico's met zich meebrengen als ze zeer capabel zijn of op grote schaal worden gebruikt. Om veilige en betrouwbare AI te waarborgen, bevat de AI-verordening regels voor aanbieders van dergelijke modellen. Dit omvat transparantie en regels met betrekking tot auteursrechten. Voor modellen die systeemrisico’s met zich mee kunnen brengen, moeten aanbieders deze risico’s beoordelen en beperken. De regels van de AI-verordening inzake GPAI zijn in augustus 2025 in werking getreden.

Ondersteunen van compliance

In juli 2025 publiceerde de Commissie drie belangrijke instrumenten ter ondersteuning van de verantwoorde ontwikkeling en uitrol van GPAI-modellen:

- De richtsnoeren over het toepassingsgebied van de verplichtingen voor aanbieders van GPAI-modellen verduidelijken het toepassingsgebied van de GPAI-verplichtingen uit hoofde van de AI-verordening en helpen actoren in de AI-waardeketen te begrijpen wie aan deze verplichtingen moet voldoen.

- De GPAI-praktijkcode is een vrijwillig nalevingsinstrument dat door onafhankelijke deskundigen bij de Commissie wordt ingediend en dat praktische richtsnoeren biedt om aanbieders te helpen te voldoen aan hun verplichtingen uit hoofde van de AI-verordening met betrekking tot transparantie, auteursrecht en veiligheid & -beveiliging.

- De template voor de openbare samenvatting van de opleidingsinhoud van GPAI-modellen vereist dat aanbieders een overzicht geven van de gegevens die worden gebruikt om hun modellen te trainen. Dit omvat de bronnen waaruit de gegevens zijn verkregen (grote datasets en topdomeinnamen). In het sjabloon wordt ook informatie gevraagd over gegevensverwerkingsaspecten om partijen met legitieme belangen in staat te stellen hun rechten uit hoofde van het EU-recht uit te oefenen.

Deze gereedschappen zijn ontworpen om hand in hand te werken. Samen bieden zij een duidelijk en uitvoerbaar kader voor aanbieders van GPAI-modellen om aan de AI-verordening te voldoen, de administratieve lasten te verminderen en innovatie te bevorderen en tegelijkertijd de grondrechten en het vertrouwen van het publiek te waarborgen.

De Commissie ontwikkelt ook steun voor andere instrumenten die richtsnoeren bieden voor de naleving van de transparantieregels van de AI-verordening:

- De door het AI-bureau geselecteerde praktijkcode voor het markeren en etiketteren van door AI gegenereerde inhoud. De code zal een vrijwillig instrument zijn om aanbieders en exploitanten van generatieve AI-systemen te helpen aan transparantieverplichtingen te voldoen. Deze omvatten het markeren van door AI gegenereerde inhoud en het onthullen van de kunstmatige aard van afbeeldingen, audio (met inbegrip van deepfakes) en tekst.

- De richtsnoeren inzake transparante AI-systemen om het toepassingsgebied, de relevante wettelijke definities, de transparantieverplichtingen, de uitzonderingen en aanverwante horizontale kwesties te verduidelijken.

Deze steuninstrumenten zijn in voorbereiding en zullen in het tweede kwartaal van 2026 worden gepubliceerd. Meer informatie over hoe het AI-bureau de uitvoering van de AI-verordening ondersteunt.

Governance en uitvoering

Het Europees AI-bureau en de autoriteiten van de lidstaten zijn verantwoordelijk voor de uitvoering van, het toezicht op en de handhaving van de AI-verordening. De AI-raad, het wetenschappelijk panel en het adviesforum sturen en adviseren de governance van de AI-verordening. Meer informatie over de governance en handhaving van de AI-verordening.

Tijdlijn van de aanvraag

De AI-verordening is op 1 augustus 2024 in werking getreden en zal twee jaar later, op 2 augustus 2026, volledig van toepassing zijn, met enkele uitzonderingen:

- verboden AI-praktijken en verplichtingen inzake AI-geletterdheid die met ingang van 2 februari 2025 in werking zijn getreden

- de governanceregels en de verplichtingen voor GPAI-modellen zijn op 2 augustus 2025 van toepassing geworden

- de regels voor AI-systemen met een hoog risico – ingebed in gereguleerde producten – hebben een verlengde overgangsperiode tot 2 augustus 2027

Wat is het voorstel van de Commissie om de uitvoering van de AI-verordening te vereenvoudigen?

In het digitale pakket vereenvoudiging worden wijzigingen voorgesteld om de uitvoering van de AI-verordening te vereenvoudigen en ervoor te zorgen dat de regels duidelijk, eenvoudig en innovatievriendelijk blijven.

De Commissie stelt voor het tijdschema voor de toepassing van de regels met een hoog risico aan te passen aan maximaal 16 maanden. Dit zorgt ervoor dat de regels van toepassing zijn wanneer bedrijven over de juiste ondersteuningsinstrumenten beschikken om de uitvoering te vergemakkelijken, zoals normen.

De Commissie stelt ook gerichte wijzigingen van de AI-verordening voor die:

- de bevoegdheden van het AI-bureau versterken en het toezicht op AI-systemen op basis van AI-modellen voor algemene doeleinden centraliseren, waardoor de versnippering van het bestuur wordt verminderd;

- Verlenging van bepaalde vereenvoudigingen die aan kmo’s en SMC’s worden verleend, met inbegrip van vereenvoudigde vereisten inzake technische documentatie;

- de Commissie en de lidstaten te verplichten AI-geletterdheid te bevorderen en te zorgen voor voortdurende ondersteuning van bedrijven door voort te bouwen op bestaande inspanningen (zoals het onlangs vernieuwde register van AI-geletterdheidspraktijken van het AI-bureau), en tegelijkertijd de opleidingsverplichtingen voor exploitanten met een hoog risico te handhaven;

- verbreding van de maatregelen ter ondersteuning van de naleving, zodat meer innovatoren kunnen profiteren van testomgevingen voor regelgeving die vanaf 2028 zullen worden opgezet en door de mogelijkheden voor tests in de praktijk uit te breiden;

- De procedures van de AI-verordening aanpassen om de wisselwerking met andere wetten te verduidelijken en de algemene uitvoering en werking ervan te verbeteren.

Dit alles vormt een aanvulling op de maatregelen die de Commissie en haar AI-bureau reeds nemen om bedrijven en nationale autoriteiten duidelijkheid te verschaffen, bijvoorbeeld door middel van richtsnoeren, gedragscodes en de AI Act Service Desk.

Het wetgevingsvoorstel is op 19 november goedgekeurd. Het Europees Parlement en de Raad van de EU bespreken en onderhandelen nu over de digitale omnibus inzake AI.

Laatste nieuws

Praktische informatie

Verslag/onderzoek

- 07-04-2026Kunstmatige intelligentie in cardiovasculaire zorg: van belofte naar praktijk

- 17-03-2026Studie over kunstmatige intelligentie in de gezondheidszorg ontleedt digitale gezondheidstechnologieën in Europa

- 01-12-2025Studie - de volgende gegevensgrens: generatieve AI, naleving van regelgeving en internationale dimensies

Factsheet/infografiek

Gerelateerde inhoud

Grote afbeelding

Zoek verder

-

Het Europees AI-bureau en de nationale markttoezichtautoriteiten zijn verantwoordelijk voor de...

-

De Commissie wil het aantal AI-deskundigen vergroten door meer onderzoekers en professionals op te...

-

Geharmoniseerde normen zullen rechtszekerheid bieden in het kader van de AI-verordening, innovatie...

-

Het Klokkenluidersinstrument van de AI-verordening stelt personen in staat om veilig een verslag in...