Akt o umělé inteligenci je vůbec prvním právním rámcem pro umělou inteligenci, který se zabývá riziky umělé inteligence a staví Evropu do vedoucí úlohy v celosvětovém měřítku.

Akt o umělé inteligenci (nařízení (EU) 2024/1689, kterým se stanoví harmonizovaná pravidla pro umělou inteligenci) je vůbec prvním komplexním právním rámcem pro umělou inteligenci na světě. Cílem pravidel je podpořit důvěryhodnou umělou inteligenci v Evropě. Máte-li jakékoli dotazy týkající se aktu o umělé inteligenci, podívejte se na jednotnou informační platformu aktu o umělé inteligenci.

Akt o umělé inteligenci stanoví pravidla založená na posouzení rizik pro vývojáře a provozovatele umělé inteligence, pokud jde o konkrétní použití umělé inteligence. Akt o umělé inteligenci je součástí širšího balíčku politických opatření na podporu rozvoje důvěryhodné umělé inteligence, který zahrnuje rovněž akční plán pro kontinent umělé inteligence, balíček týkající se inovací v oblasti umělé inteligence a zahájení provozu továren na umělou inteligenci. Tato opatření společně zaručují bezpečnost, základní práva a umělou inteligenci zaměřenou na člověka a posilují zavádění, investice a inovace v oblasti umělé inteligence v celé EU.

S cílem usnadnit přechod na nový regulační rámec zahájila Komise Pakt o umělé inteligenci, dobrovolnou iniciativu, jejímž cílem je podpořit budoucí provádění, spolupracovat se zúčastněnými stranami a vyzvat poskytovatele a provozovatele umělé inteligence z Evropy i mimo ni, aby s předstihem splnili klíčové povinnosti vyplývající z aktu o umělé inteligenci. Současně poskytuje informace a podporu pro hladké a účinné provádění aktu o umělé inteligenci v celé EU také asistenční služba aktu o umělé inteligenci.

Proč potřebujeme pravidla pro umělou inteligenci?

Akt o umělé inteligenci zajišťuje, že Evropané mohou důvěřovat tomu, co umělá inteligence nabízí. Zatímco většina systémů UI představuje pouze nulové riziko a může přispět k řešení mnoha společenských výzev, některé systémy UI vytvářejí rizika, která musíme řešit, abychom se vyhnuli nežádoucím výsledkům.

Často například není možné zjistit, proč se systém UI rozhodl nebo předpověděl a přijal konkrétní opatření. Proto může být obtížné posoudit, zda někdo nebyl nespravedlivě znevýhodněn, například v rozhodnutí o přijetí do zaměstnání nebo v žádosti o veřejně prospěšný systém.

Ačkoli stávající právní předpisy poskytují určitou ochranu, nepostačují k řešení konkrétních výzev, které mohou systémy UI přinést.

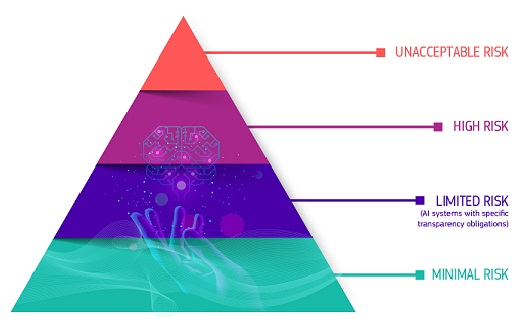

Přístup založený na posouzení rizik

Akt o umělé inteligenci definuje čtyři úrovně rizika pro systémy UI:

Nepřijatelné riziko

Všechny systémy umělé inteligence považované za jasnou hrozbu pro bezpečnost, živobytí a práva lidí jsou zakázány. Akt o umělé inteligenci zakazuje osm postupů, konkrétně:

- škodlivé manipulace a klamání založené na umělé inteligenci

- škodlivé využívání zranitelností na základě umělé inteligence

- sociální bodování

- Posouzení nebo předpověď rizik jednotlivých trestných činů

- necílené škrábání internetu nebo CCTV materiálu za účelem vytvoření nebo rozšíření databází rozpoznávání obličeje

- rozpoznávání emocí na pracovištích a ve vzdělávacích institucích

- biometrická kategorizace k odvození určitých chráněných vlastností

- biometrická identifikace na dálku v reálném čase pro účely vymáhání práva na veřejně přístupných místech

Zákazy nabyly účinnosti v únoru 2025. Komise zveřejnila dva klíčové dokumenty na podporu praktického uplatňování zakázaných praktik:

- Pokyny k zakázaným postupům v oblasti umělé inteligence podle aktu o umělé inteligenci, které nabízejí právní vysvětlení a praktické příklady, které zúčastněným stranám pomohou zákazy pochopit a dodržovat.

- Pokyny k definici systému UI v aktu o UI s cílem pomoci zúčastněným stranám při určování oblasti působnosti aktu o UI

Vysoké riziko

Případy použití UI, které mohou představovat závažná rizika pro zdraví, bezpečnost nebo základní práva, jsou klasifikovány jako vysoce rizikové. K těmto vysoce rizikovým případům použití patří:

- Bezpečnostní prvky UI v kritických infrastrukturách (např. doprava), jejichž selhání by mohlo ohrozit život a zdraví občanů

- řešení umělé inteligence používaná ve vzdělávacích institucích, která mohou určovat přístup ke vzdělávání a průběh profesního života (např. bodování zkoušek)

- Bezpečnostní komponenty výrobků založené na umělé inteligenci (např. aplikace umělé inteligence v roboticky asistované chirurgii)

- Nástroje UI pro zaměstnanost, řízení pracovníků a přístup k samostatné výdělečné činnosti (např. software pro třídění životopisů pro nábor)

- Některé případy použití umělé inteligence používané k poskytování přístupu k základním soukromým a veřejným službám (např. úvěrové hodnocení, které občanům znemožňuje získat půjčku)

- systémy UI používané pro biometrickou identifikaci na dálku, rozpoznávání emocí a biometrickou kategorizaci (např. systém UI pro zpětnou identifikaci zloděje)

- Případy použití umělé inteligence při prosazování práva, které mohou zasahovat do základních práv lidí (např. hodnocení spolehlivosti důkazů)

- Případy použití umělé inteligence při řízení migrace, azylu a ochrany hranic (např. automatizované posuzování žádostí o víza)

- Řešení umělé inteligence používaná při výkonu spravedlnosti a demokratických procesů (např. řešení umělé inteligence pro přípravu soudních rozhodnutí)

Vysoce rizikové systémy UI podléhají před uvedením na trh přísným povinnostem:

- odpovídající systémy posuzování a zmírňování rizik

- vysoce kvalitní datové soubory doplňující systém, aby se minimalizovalo riziko diskriminačních výsledků

- protokolování činnosti s cílem zajistit sledovatelnost výsledků

- podrobnou dokumentaci poskytující veškeré nezbytné informace o systému a jeho účelu, aby orgány mohly posoudit jeho soulad

- jasné a přiměřené informace pro provozovatele

- vhodná opatření v oblasti lidského dohledu

- vysoká úroveň odolnosti, kybernetické bezpečnosti a přesnosti

Riziko transparentnosti

To se týká rizik spojených s potřebou transparentnosti, pokud jde o používání umělé inteligence. Akt o umělé inteligenci zavádí zvláštní povinnosti týkající se zveřejňování informací s cílem zajistit, aby byli lidé informováni, je-li to nezbytné k zachování důvěry. Například při používání systémů umělé inteligence, jako jsou chatboti, by si lidé měli být vědomi toho, že komunikují se strojem, aby mohli učinit informované rozhodnutí.

Poskytovatelé generativní umělé inteligence musí navíc zajistit, aby byl obsah vytvořený umělou inteligencí identifikovatelný. Kromě toho by měl být určitý obsah vytvořený umělou inteligencí jasně a viditelně označen, konkrétně deep fakes a text zveřejňovaný za účelem informování veřejnosti o záležitostech veřejného zájmu.

Pravidla transparentnosti aktu o umělé inteligenci vstoupí v platnost v srpnu 2026.

Minimální nebo žádné riziko

Akt o umělé inteligenci nezavádí pravidla pro umělou inteligenci, která jsou považována za minimální nebo žádná rizika. Převážná většina systémů UI, které se v současné době používají v EU, spadá do této kategorie. To zahrnuje aplikace, jako jsou videohry s umělou inteligencí nebo spamové filtry.

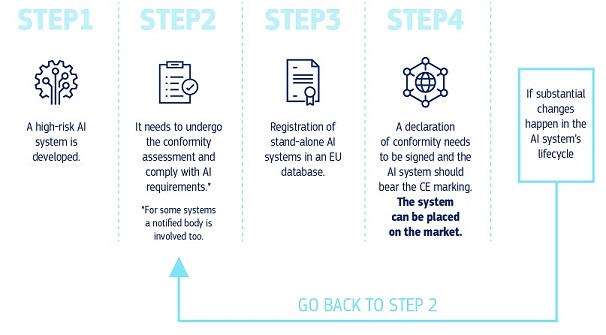

Jak to v praxi funguje pro poskytovatele vysoce rizikových systémů UI?

Jakmile je systém UI uveden na trh, jsou za dozor nad trhem odpovědné orgány, provozovatelé zajišťují lidský dohled a monitorování a poskytovatelé mají zaveden systém monitorování po uvedení na trh. Poskytovatelé a provozovatelé budou rovněž hlásit závažné incidenty a poruchy.

Jaká jsou pravidla pro obecné modely umělé inteligence?

Obecné modely umělé inteligence (GPAI) mohou plnit širokou škálu úkolů a stávají se základem mnoha systémů umělé inteligence v EU. Některé z těchto modelů by mohly nést systémová rizika, pokud jsou velmi schopné nebo široce používané. Aby byla zajištěna bezpečná a důvěryhodná umělá inteligence, zavádí akt o umělé inteligenci pravidla pro poskytovatele těchto modelů. To zahrnuje pravidla týkající se transparentnosti a autorského práva. U modelů, které mohou nést systémová rizika, by poskytovatelé měli tato rizika posoudit a zmírnit. Pravidla aktu o umělé inteligenci týkající se GPAI nabyla účinnosti v srpnu 2025.

Podpora dodržování předpisů

V červenci 2025 zveřejnila Komise tři klíčové nástroje na podporu odpovědného vývoje a zavádění modelů GPAI:

- Pokyny k oblasti působnosti povinností poskytovatelů modelů GPAI objasňují oblast působnosti povinností GPAI podle aktu o umělé inteligenci a pomáhají aktérům v hodnotovém řetězci umělé inteligence pochopit, kdo musí tyto povinnosti dodržovat.

- Kodex zásad GPAI je dobrovolný nástroj pro dodržování předpisů, který Komisi předložili nezávislí odborníci a který nabízí praktické pokyny, jež poskytovatelům pomohou plnit jejich povinnosti podle aktu o umělé inteligenci, pokud jde o transparentnost, autorské právo a bezpečnost & security.

- Šablona pro veřejné shrnutí obsahu školení modelů GPAI vyžaduje, aby poskytovatelé poskytli přehled údajů použitých pro školení svých modelů. To zahrnuje zdroje, z nichž byly údaje získány (zahrnující velké datové soubory a názvy domén nejvyšší úrovně). Šablona rovněž požaduje informace o aspektech zpracování údajů, aby strany s oprávněnými zájmy mohly vykonávat svá práva podle práva EU.

Tyto nástroje jsou navrženy tak, aby pracovaly ruku v ruce. Společně poskytují jasný a proveditelný rámec pro poskytovatele modelů GPAI, aby dodržovali akt o umělé inteligenci, snížili administrativní zátěž a podporovali inovace a zároveň chránili základní práva a důvěru veřejnosti.

Komise rovněž vyvíjí další nástroje, které nabízejí pokyny, jak dodržovat pravidla transparentnosti stanovená v aktu o umělé inteligenci:

- Kodex zásad pro označování a označování obsahu vytvořeného umělou inteligencí, který vybral úřad pro umělou inteligenci. Kodex bude dobrovolným nástrojem, který poskytovatelům a provozovatelům generativních systémů UI pomůže plnit povinnosti v oblasti transparentnosti. Patří mezi ně označování obsahu vytvořeného umělou inteligencí a zveřejňování umělé povahy obrázků a zvuku (včetně deepfakes) i textu.

- Pokyny k transparentním systémům UI s cílem vyjasnit oblast působnosti, příslušné právní definice, povinnosti týkající se transparentnosti, výjimky a související horizontální otázky.

Tyto podpůrné nástroje se připravují a budou zveřejněny ve druhém čtvrtletí roku 2026. Další informace o tom, jak úřad pro umělou inteligenci podporuje provádění aktu o umělé inteligenci.

Správa a provádění

Evropský úřad pro umělou inteligenci a orgány členských států odpovídají za provádění aktu o umělé inteligenci, dohled nad ním a jeho prosazování. Rada pro umělou inteligenci, vědecká komise a poradní fórum řídí správu aktu o umělé inteligenci a poskytují jí poradenství. Další podrobnosti o správě a prosazování aktu o umělé inteligenci.

Časová osa žádosti

Akt o umělé inteligenci vstoupil v platnost dne 1. srpna 2024 a bude plně použitelný o dva roky později, dne 2. srpna 2026, s několika výjimkami:

- zakázané postupy v oblasti UI a povinnosti týkající se gramotnosti v oblasti UI, které vstoupily v platnost dne 2. února 2025

- pravidla správy a povinnosti pro modely GPAI se staly použitelnými dne 2. srpna 2025

- pravidla pro vysoce rizikové systémy UI – zabudované do regulovaných produktů – mají prodloužené přechodné období do 2. srpna 2028 (v důsledku politické dohody o návrhu na zjednodušení aktu o UI – „souhrn UI“)

Jak Komise zjednodušuje provádění aktu o umělé inteligenci?

V digitálním balíčku o zjednodušení byly navrženy změny, které mají zjednodušit provádění aktu o umělé inteligenci a zajistit, aby pravidla zůstala jasná, jednoduchá a vstřícná k inovacím. Tento legislativní návrh (nazývaný „souhrnný návrh o umělé inteligenci“) byl přijat dne 19. listopadu 2025 a politické dohody bylo dosaženo dne 7. května 2026.

V návaznosti na politickou dohodu je stanoven jasný harmonogram provádění pravidel upravujících vysoce rizikové systémy UI:

- Pravidla pro systémy používané v některých vysoce rizikových oblastech – včetně biometrických údajů, kritické infrastruktury, vzdělávání, zaměstnanosti, migrace, azylu a ochrany hranic – se použijí ode dne 2. prosince 2027.

- Pro systémy integrované do výrobků, jako jsou výtahy nebo hračky, se pravidla použijí ode dne 2. srpna 2028.

Tím se zajistí, aby se pravidla uplatňovala v případech, kdy společnosti mají vhodné podpůrné nástroje k usnadnění provádění, jako jsou normy.

Kromě toho byly dohodnuty tyto změny aktu o umělé inteligenci:

- Zákaz systémů UI, které vytvářejí sexuálně explicitní a intimní obsah bez souhlasu nebo materiál pohlavního zneužívání dětí, jako jsou „nudifikační“ aplikace UI

- Posílit pravomoci úřadu pro umělou inteligenci a centralizovat dohled nad systémy umělé inteligence založenými na obecných modelech umělé inteligence, čímž se sníží roztříštěnost správy a řízení

- Rozšířit některé zjednodušené požadavky udělené malým a středním podnikům na malé společnosti se střední tržní kapitalizací, včetně zjednodušených požadavků na technickou dokumentaci

- Více inovátorů získá přístup k regulačním pískovištím, včetně pískoviště na úrovni EU, aby mohli testovat svá řešení v oblasti umělé inteligence v reálných podmínkách

- Je vyjasněna souhra mezi aktem o umělé inteligenci a právními předpisy EU o bezpečnosti výrobků, zejména nařízením o strojních zařízeních, aby se zabránilo zdvojování mezi odvětvovými pravidly a pravidly pro umělou inteligenci.

To vše doplňuje již zavedená opatření úřadu pro umělou inteligenci s cílem zajistit jasnost pro podniky a vnitrostátní orgány. Například prostřednictvím pokynů, kodexů správné praxe a asistenční služby aktu o umělé inteligenci.

Nejnovější zprávy

Legislativa a související opatření

- 07-05-2026Návrh pokynů k provádění povinností týkajících se transparentnosti pro některé systémy UI podle článku 50 aktu o UI

- 05-03-2026Komise zveřejnila druhý návrh kodexu zásad pro označování a označování obsahu vytvořeného umělou inteligencí

- 20-02-2026Prohlášení vedoucích představitelů na summitu o dopadu umělé inteligence v Indii

Zpráva o události

Související obsah

Souvislosti

Hlubší pohled

-

Za provádění aktu o umělé inteligenci, dohled nad ním a jeho prosazování odpovídají Evropský úřad...

-

Cílem Komise je zvýšit počet odborníků na umělou inteligenci prostřednictvím odborné přípravy a...

-

Harmonizované normy poskytnou právní jistotu podle aktu o umělé inteligenci, podpoří inovace a...

-

Nástroj pro oznamovatele aktu o umělé inteligenci umožňuje jednotlivcům bezpečně předkládat zprávy a...